更新啦!我用 Claude Skills 做的剪辑 Agent!识别效果+交互大升级

大家好,我是成峰。 剪辑 Skills 更新了。

大家好,我是成峰。

剪辑 Skills 更新了。

上一版发出去后,收到很多反馈:

最多的问题是两个:

-

下载 5GB 模型要等几十分钟,很多人直接放弃了

-

文档里一行行找口误,太累了

所以这次做了一次大改:

替换了火山引擎的音视频识别模型,提升了交互界面。

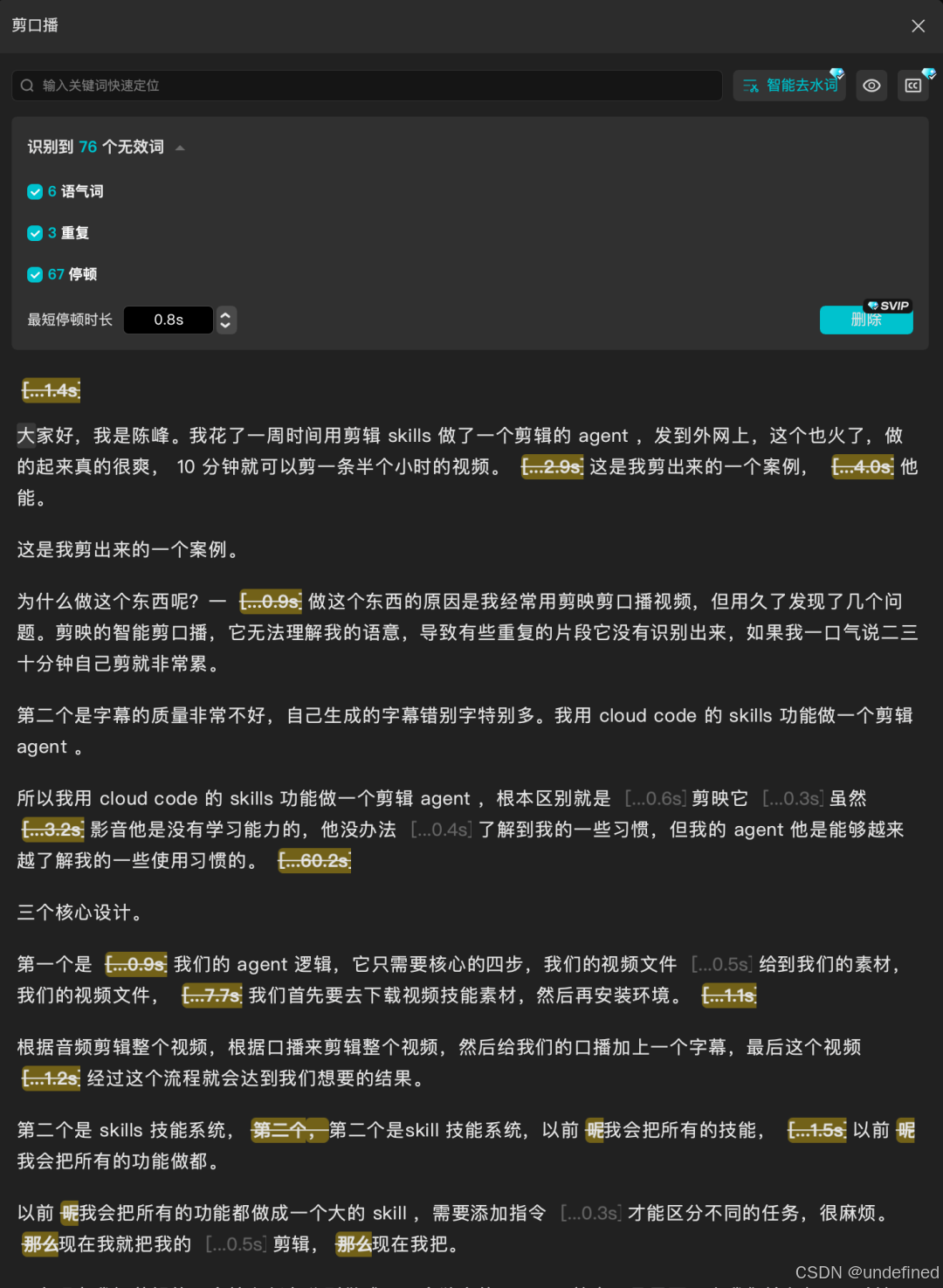

效果怎么样?直接对比剪映:

剪辑 Skills:

剪映:

同样一段视频,剪映漏掉的口误,AI全识别出来了,并且也有更好的展示效果。

三个核心改进

根据用户反馈,这次主要更新了三个方面。

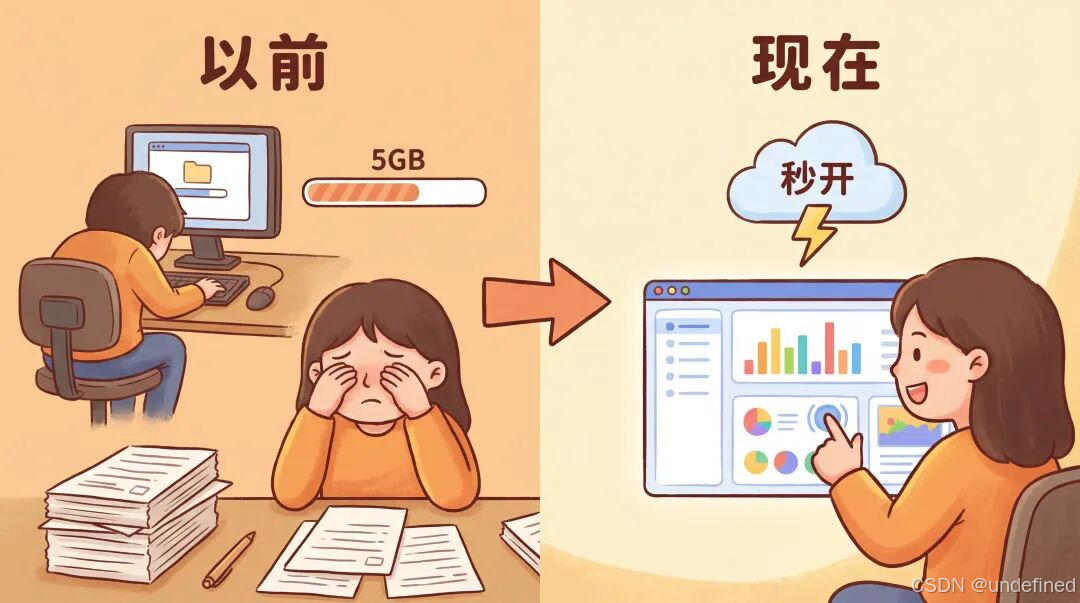

1.更快:API 替代本地模型

上一版需要下载 5GB 的本地模型,很多人反馈下载太慢。

这次直接换成 API 调用。

-

下载快:不用等几个小时下模型

-

运行快:API 服务器比你的电脑快得多

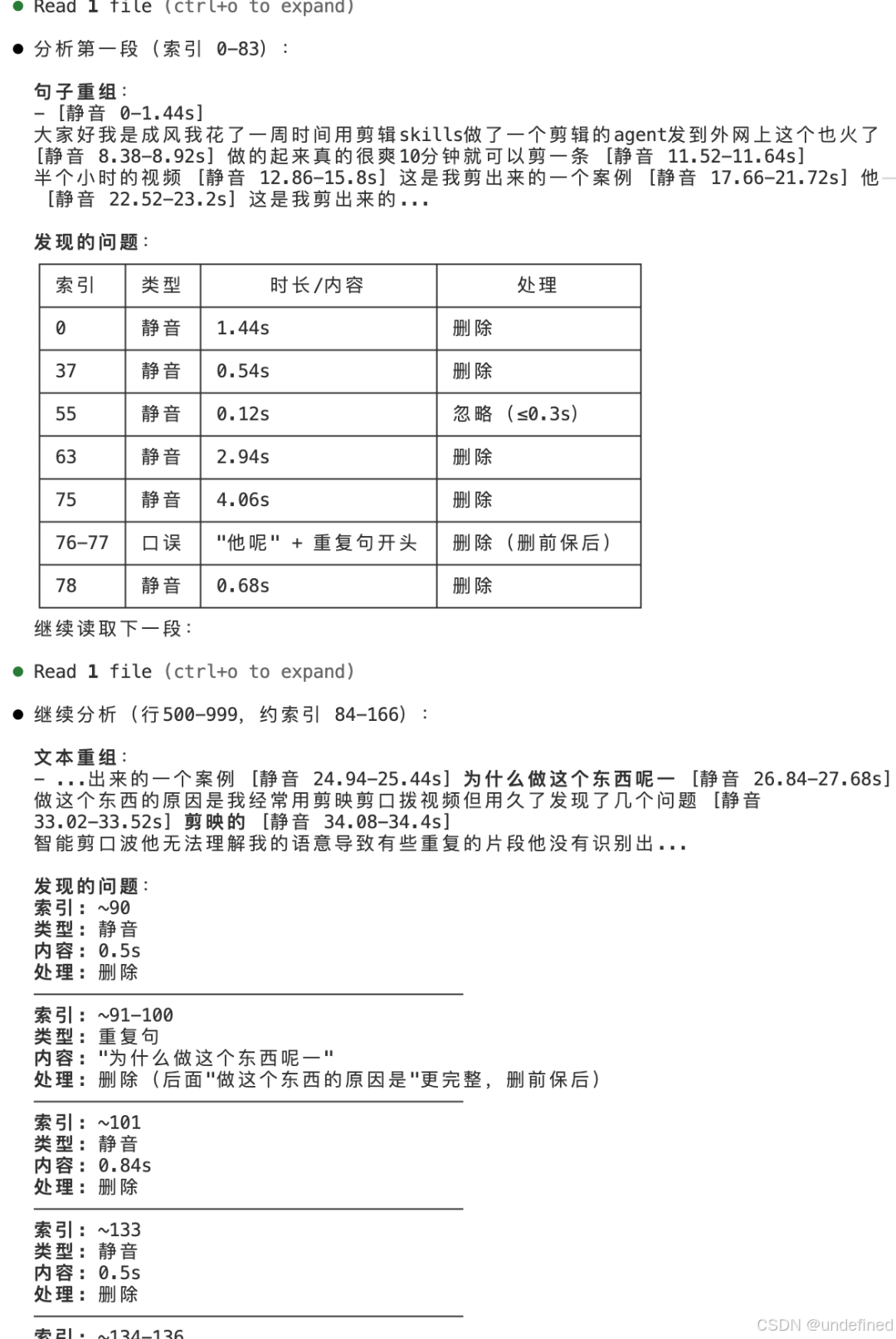

2.更准:口误识别系统重构

以前的口误识别比较粗暴,现在整个系统重构了。

模型替换

豆包的音视频字幕,是我体验下来识别最准的。

(感谢 @极客杰尼 提供情报)

AI语义理解

现在 AI 会逐段分析:

根据规则判断每一段:静音、重复句、卡顿词、语气词……

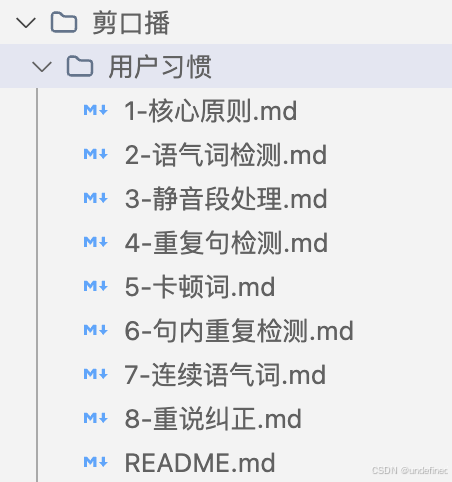

用户习惯透明化

所有的识别规则,都放在一个独立的文件夹里:

你觉得哪条规则不对,直接改文件就行。想加新规则,新建一个 md 文件就行。

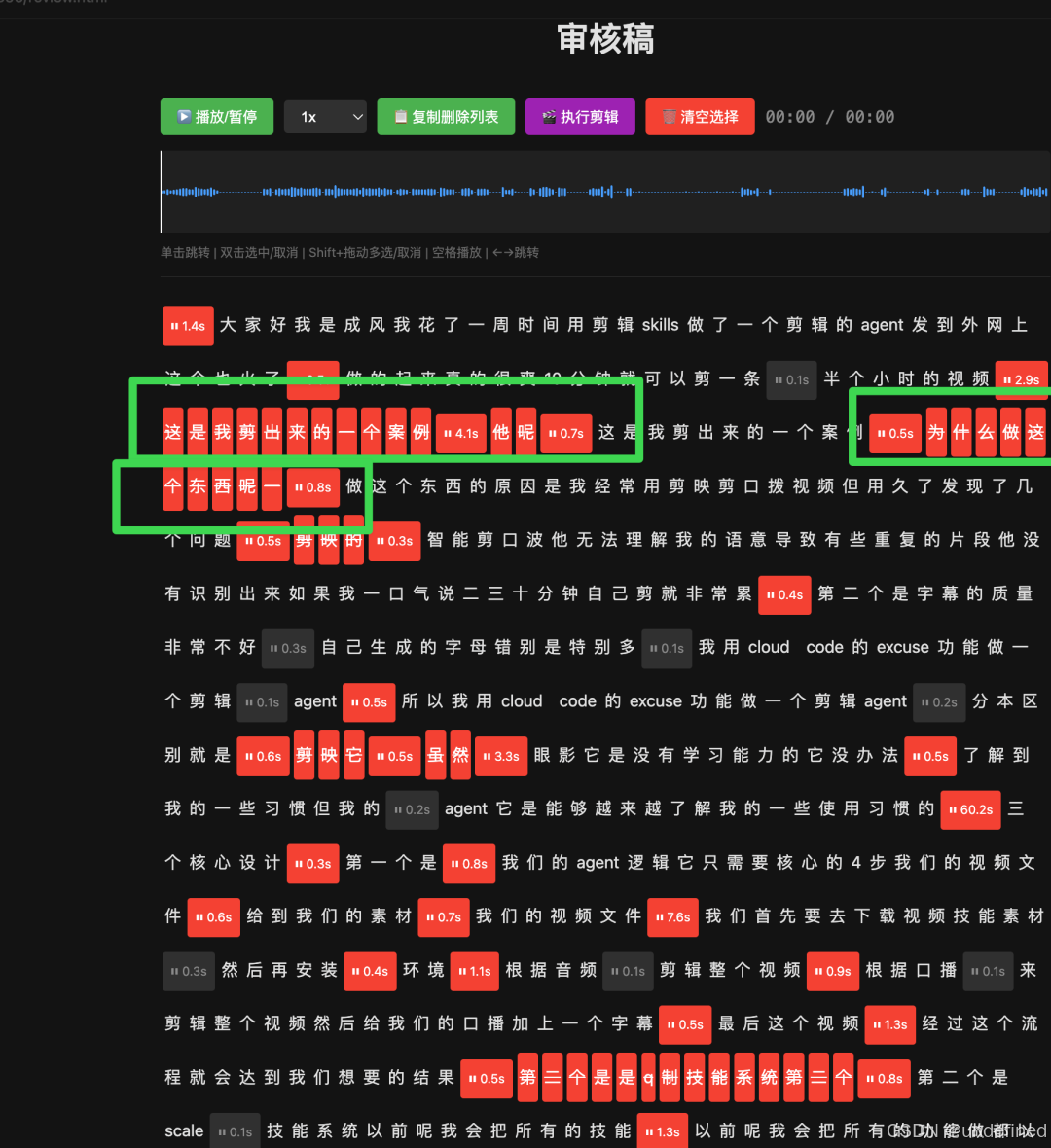

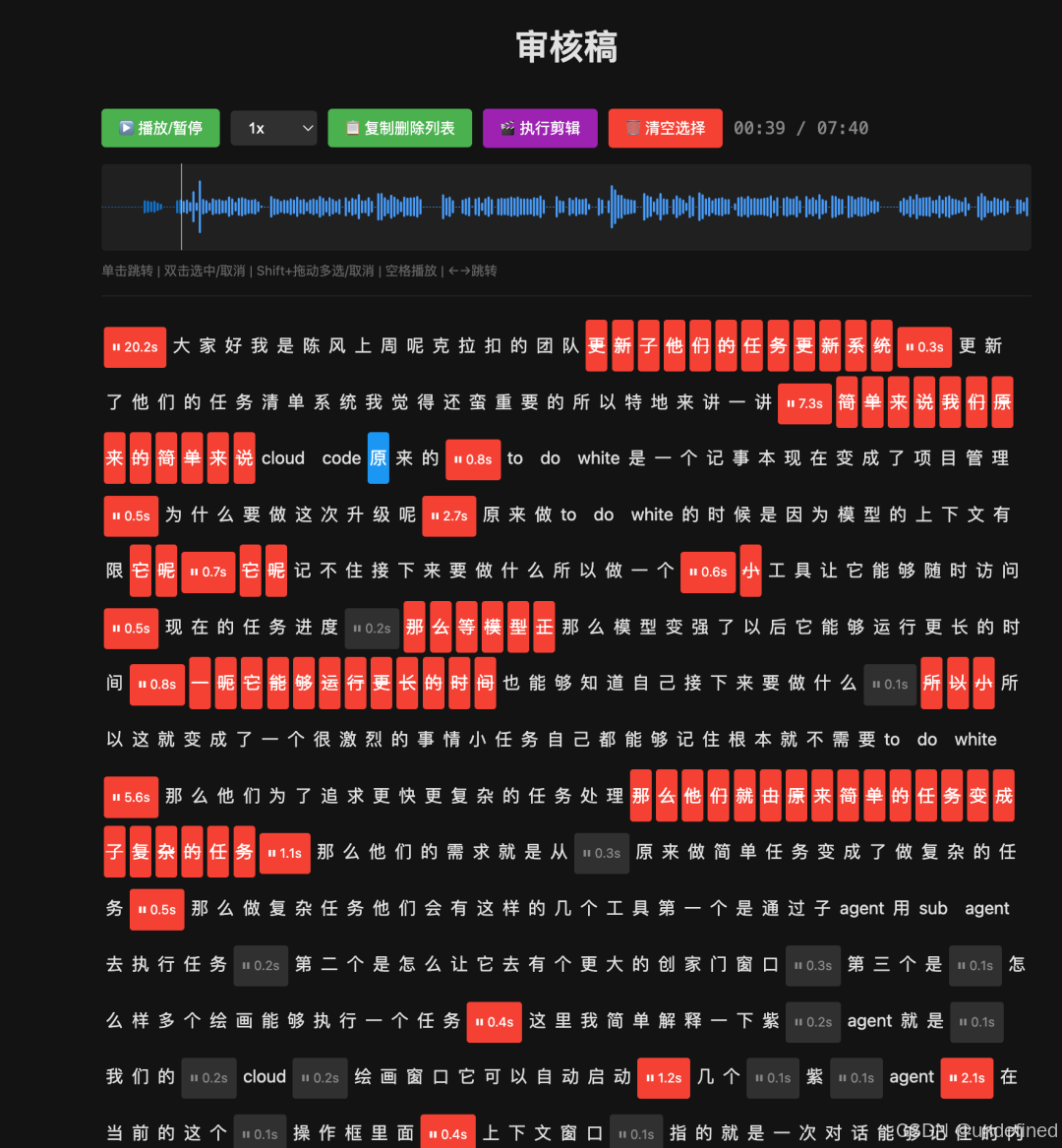

3.更直观:可视化审核界面

这是最大的改进。

以前剪辑完成后,AI 会在命令行里输出一个审查稿。你需要在文本里找问题,然后告诉 AI 要改哪里。

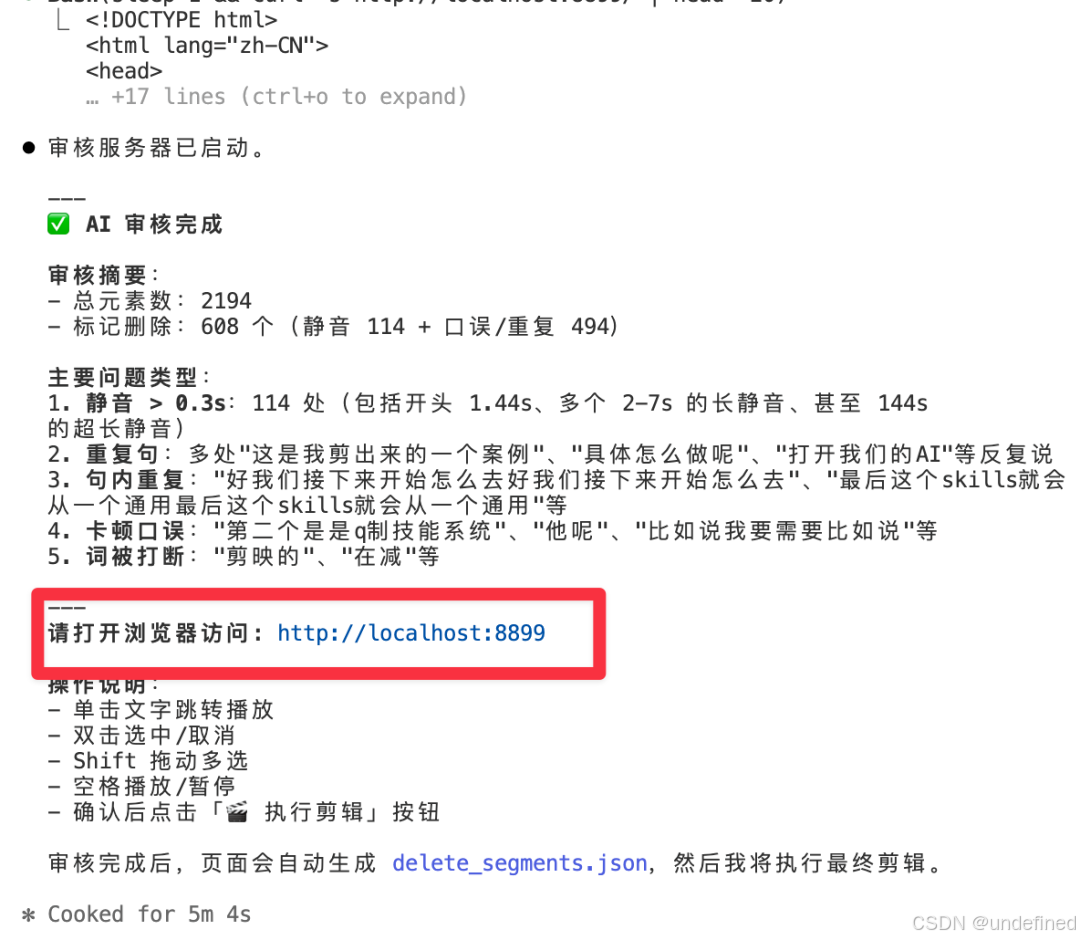

现在启动剪辑后,会自动启动一个审核服务。

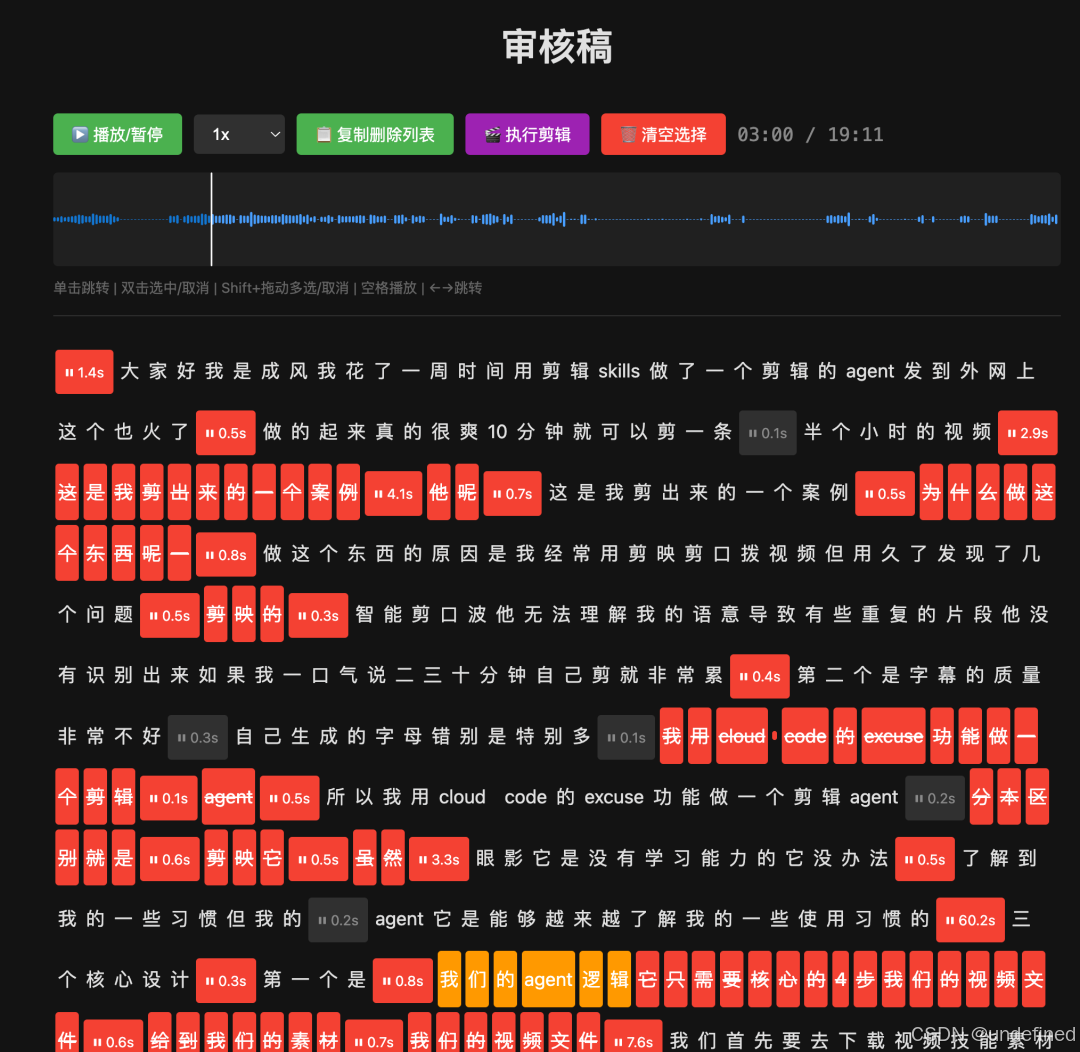

打开浏览器,你能看到一个类似剪映剪口播的界面:

额外多加了两个功能:

功能 1:加速按钮

可以倍速听完整个视频。

功能 2:复制删除列表

这个功能是给 AI 学习用的。

确认审核结果后,点击「复制删除列表」,把删除的片段信息复制出来,然后告诉 AI。AI 会分析你的表达习惯,下次剪辑时就能更准确地识别。

这就是我一直强调的自更新机制 —— 越用越懂你。

使用方法

过程更加简单了,15 分钟搞定。

第1步:下载 Skills(1分钟)

帮我下载剪辑 Skills:

- 地址:https://github.com/Ceeon/videocut-skills

- 存放路径:.claude/skills/(直接克隆到此目录,不要创建子文件夹)

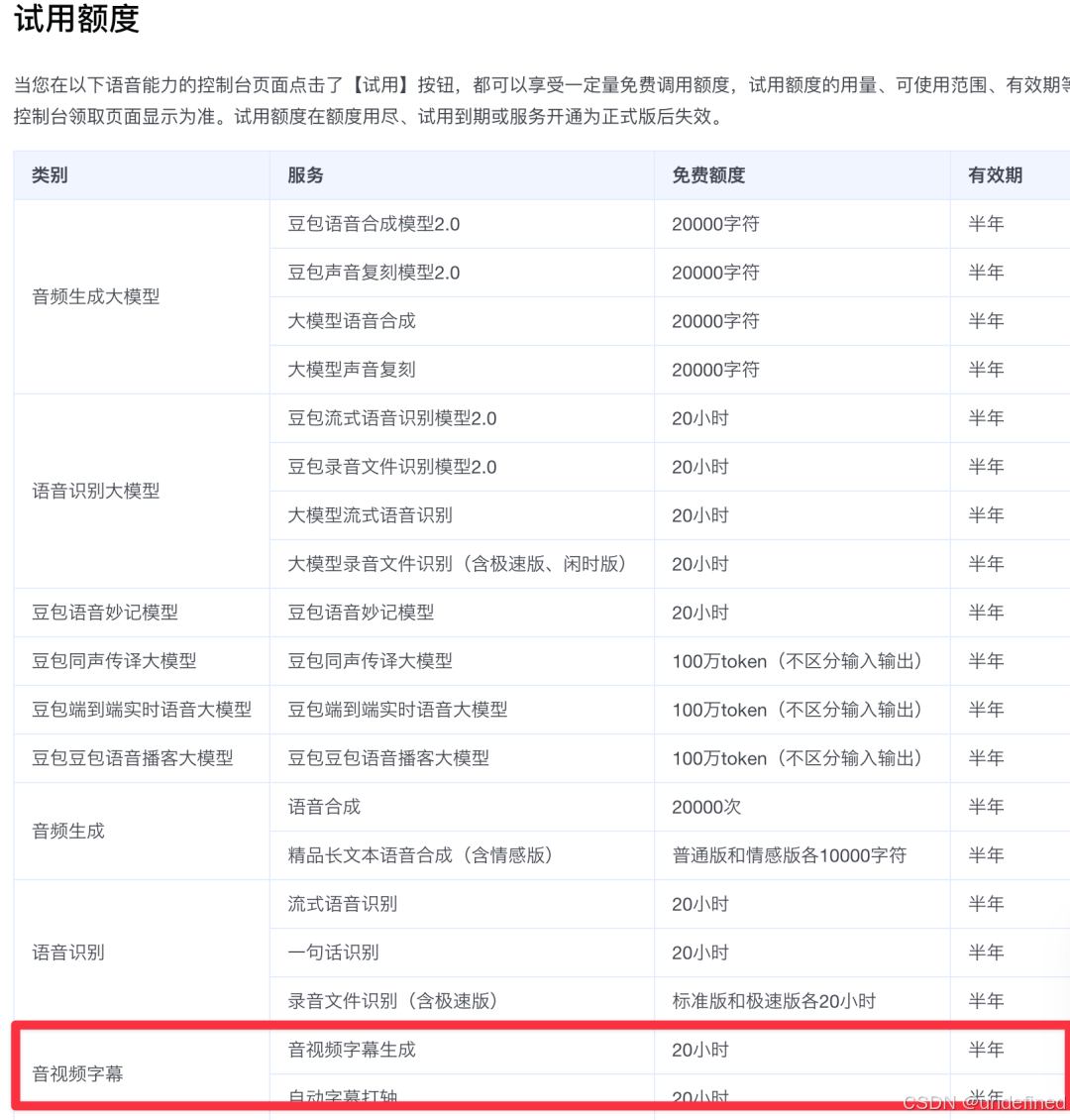

第2步:配置 API Key(3分钟)

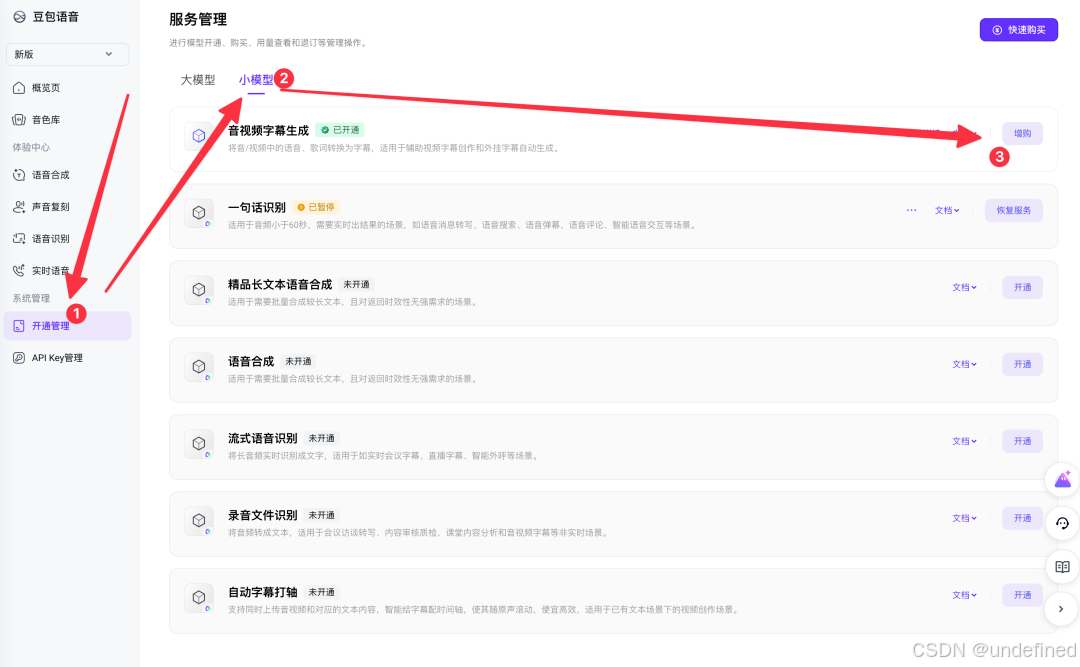

这次用的是火山的「音视频字幕生成」能力。

它有试用,免费 20 个小时:

登录火山的模型管理,开通 “音视频字幕生成”:

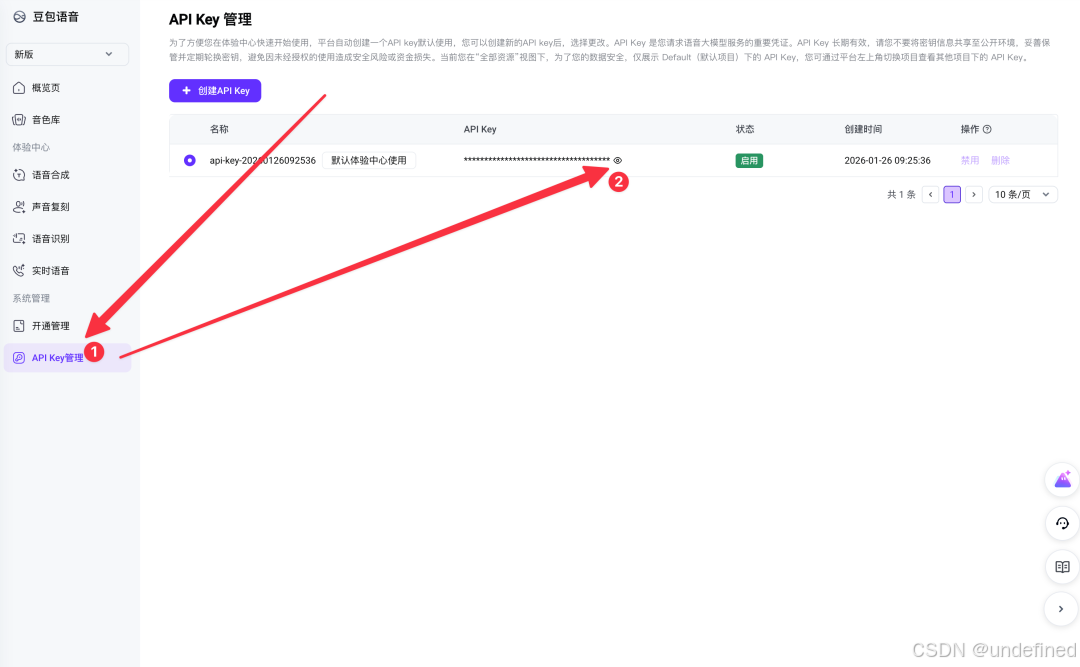

获取 API Key:

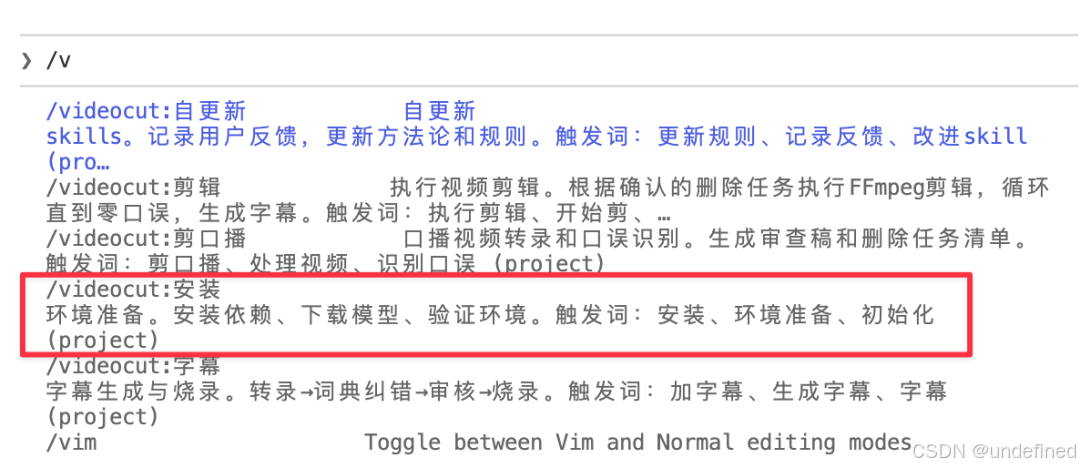

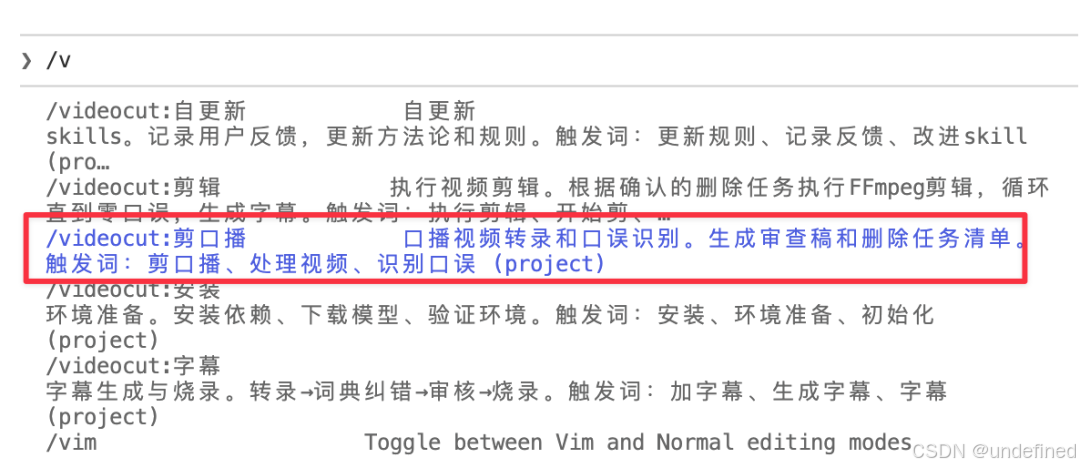

输入 /v,选择 videocut:安装,输入 API Key,完成配置。

第3步:剪口播(10分钟)

输入 /v,选择 videocut:剪口播,输入视频路径。

AI 会自动: 1.调用 API 转录 2.启动审核本地服务 3.给一个审核界面的链接

打开链接,就能看到审核界面:

我们可以在这里检查 AI 识别得准不准。

操作方式:Shift + 拖动,选中或取消选中片段。

四个功能按钮:

1.播放 — 和剪映一样,自动跳过已选中的片段 2.倍速播放 — 剪映没有的功能,说话慢的视频可以加速听 3.复制删除列表 — 如果差别特别大,可以把自己的删除结果复制给 AI 学习用,它会学习你的习惯 4.执行剪辑 — 确认无误后,点击自动完成剪辑

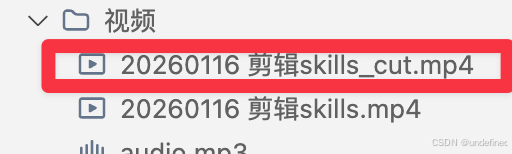

剪辑完成后,它就会多出来一个名称结尾叫cut的视频。

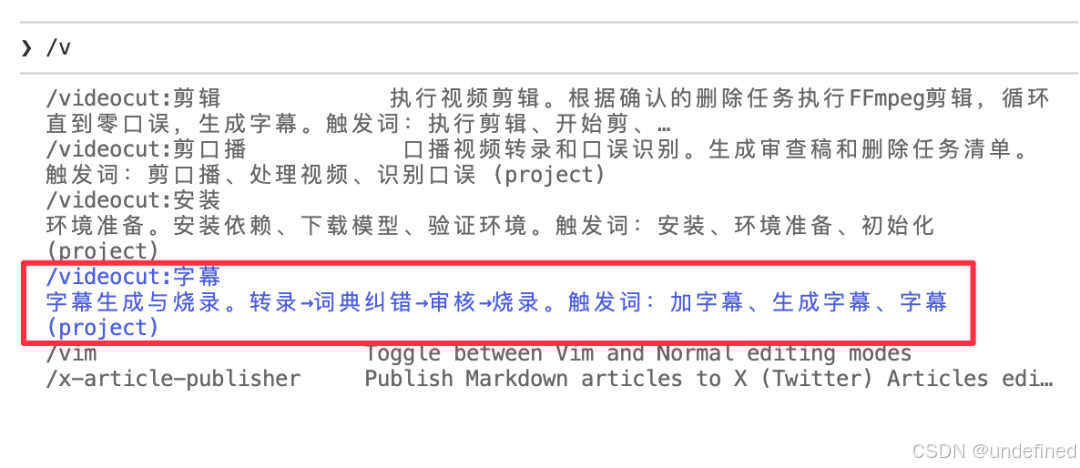

第4步:加字幕(3分钟)

和之前一样,输入 /v,选择 videocut:字幕。

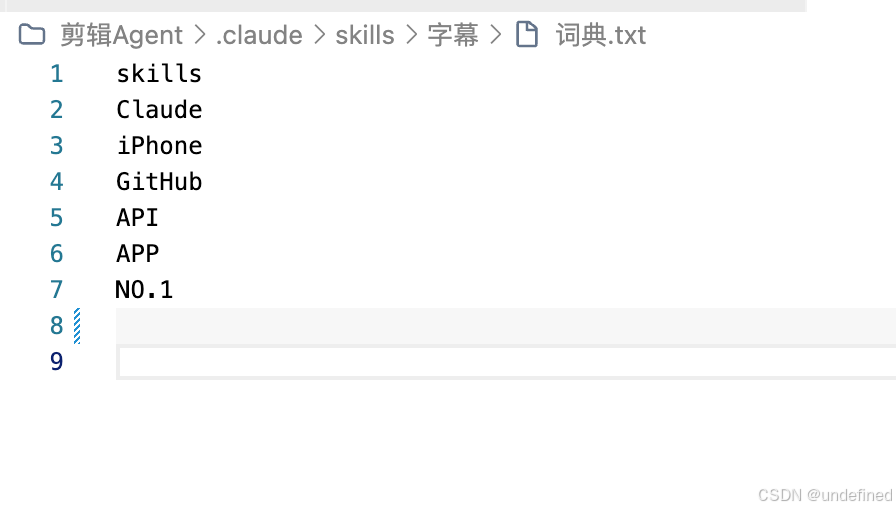

记得在词典文件里加入你的专有名词,字幕准确率会更高。

四步搞定,全程可视化。

如果你之前试过觉得麻烦,这次可以再试试。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)