DeepSeek本地部署详细教程 保姆级

本文将详细说明DeepSeek本地部署的详细步骤

·

本文将详细说明DeepSeek本地部署的详细步骤:

部署前准备:

- 电脑一台,配置不限 但内存还是得大于8G

- 如果有科学网络更好

- 下载并安装ollama开源框架,ollama是一个开源框架,专门用于在本地机器上便捷部署和运行大型语言模型

- 安装Chatbox AI(该步骤是可选项),可以使得与deepseek交互时的页面更加美观和人性化

- 完成,可在本地问deepseek问题了

- 本文所用电脑,苹果macPRO ,机器比较古董了。如果是windows系统和linux,操作步骤几乎一致,可以参照执行。

2. 安装ollama框架

下载可能会很慢,这个时候可以用科学网络,具体步骤大家可以百度。下载成功后就正常的一步步安装,直到完成后在电脑上能看到ollama的图标。

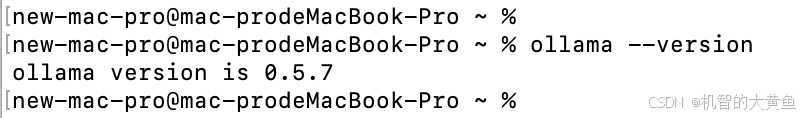

此时可以通过访问http://localhost:11434验证是否安装成功,也可以在终端输入 ollama -version验证

到这里整体进度已经完成了一小半了。

3. 下载并运行deepseek模型

刚刚提到的电脑的配置不限,是因为我们本地可以选择部署的版本,大家可以按照内存大小选择

- 入门级:1.5B版本,适合初步测试,8GB RAM:1.5B版本。

- 中端:7B或8B版本,适合大多数消费级硬件。16GB RAM:7B或8B版本。

- 高性能:14B、32B或70B版本,适合高端硬件。32GB RAM:14B或32B版本

我们刚刚安装ollma的目的,就是可以简化本地化部署的步骤,现在我们只需要一条命令即可下载并且安装deepseek的模型

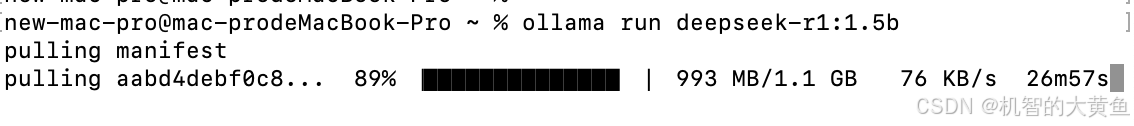

执行命令 :ollama run deepseek-r1:1.5b (特别注意:这一行命令很重要,第一次执行会去下载并安装大模型,安装成功以后如果关闭了命令窗口或者是电脑关机后想要重新打开,也是使用这行命令)

如果需要下载其他版本将1.5b换成其他版本即可。

这个命令下载的时间可能会根据网络原因会比较长,此时可以去做一下其他的事情等一等。

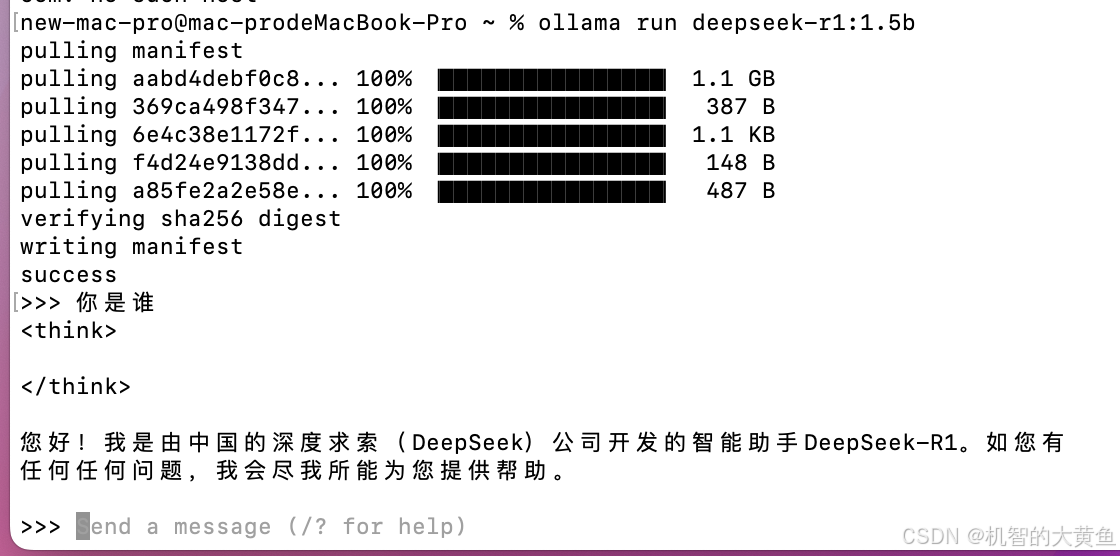

完成后会看到一个success,此时表示已经完成本地部署了,可以开始使用了。

在命令行中直接输入问题,即可看到思考过程以及答案。

到这里就已经能用了,但是交互界面是在终端,不是很直观,此时可以下载安装Chatbox AI

使用 Chatbox AI 进行交互,会更加流畅

下载地址 https://chatboxai.app/zh 需要在设置里面填上自己本地的api地址和模型选择,

大家就可以开始使用啦。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)