Win10 IDEA连接虚拟机中的Hadoop集群(进来保你成)

至此idea连接Hadoop集群配置完成,更多的操作可以通过Hadoop提供configuration类filesystem类、FSDataInputStream类和FSDataOutputStream类实现。有问题的朋友可以留言,我会及时回复我所能解决的问题,一些我安装时遇到的问题放在后面,大家可以浏览查看。

目录

引言:

分布式课程要求使用IDE(IDEA、Eclipse)来编写程序直接对Hadoop集群进行文件操作,目前关于IDEA连接Hadoop集群的教程,良莠不齐,根据多个教程完成了IDEA连接Hadoop集群。现在将完整的流程陈列如下。

如果觉得文章组织形式不好,或者有看不懂的地方请给我留言。

环境:

windows10 (IDEA 2021.1.3)

VMware 16 workstation pro(安装可以搜教程,比较容易)

Linux Server(Hadoop-2.7.7集群 1 master 3 slaves)

集群搭建可以看Hadoop集群搭建(超级详细)_阮哈哈哈哈哈的博客-CSDN博客

idea连接Hadoop集群可以看idea连接本地虚拟机Hadoop集群运行wordcount - 徐春晖 - 博客园 (cnblogs.com)

前提:

1.通过虚拟机完成了完全分布式Hadoop集群的搭建,在master节点中使用start-all.sh启动Hadoop集群,并使用jps得到下面的输出,表示Hadoop集群搭建成功。

当然也可以通过Hadoop提供的web界面查看,一般来说我们在浏览器中输入http://192.168.xx.101:50070访问。(注意:有的时候我们确实能够跳转到该界面,但是我们还需要查看datanode是否正常运行,因为存在这样的情况,datanode配置失败,但是Hadoop集群也能成功启动,但是后面的文件操作是无法正常运行的)

点击Datanodes出现上面的界面表示配置好了Hadoop集群。

2.安装好了IDEA开发工具

实现:

在window上配置好Hadoop

1.下载hadoop-2.7.7.tar.gz文件到window。各版本Hadoop,我选择的是2.7.7

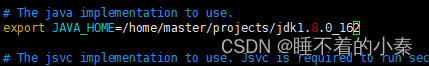

Hadoop是跨平台的,不用担心Linux与windows不兼容,但是需要注意的是在hadoop-2.7.7/etc/hadoop/hadoop-env.sh中JAVA_HOME需要修改为window下jdk的路径。

2. 选择一个空目录将hadoop-2.7.7.tar.gz解压

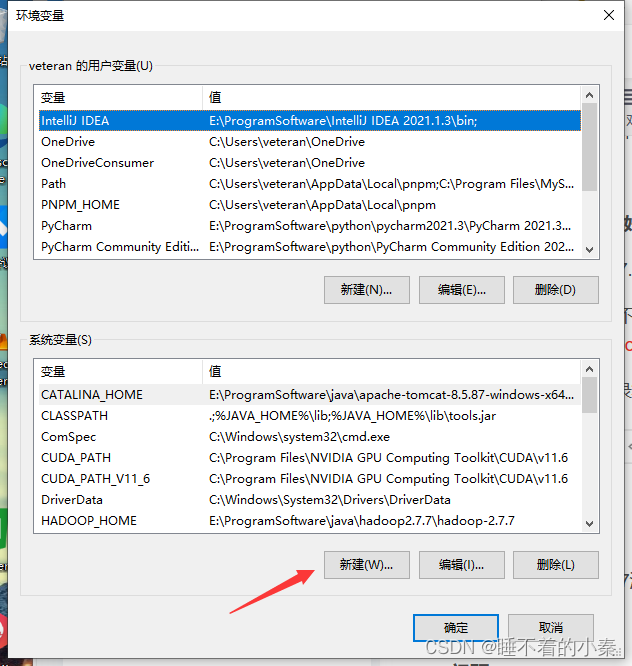

3. 将hadoop-2.7.7添加到环境变量中

变量名:HADOOP_HOME

变量值:E:\xx\xx\xx\hadoop-2.7.7 (先看下面的图再复制)

%JAVA_HOME%\bin

%JAVA_HOME%\jre\bin(先看下面的图再复制)

4.使用命令行查看环境变量是否配置成功

hadoop version

5.安装jdk(JDK 8 所有版本)

解压到目录中,添加环境变量(和Hadoop配置相似,可以上去再看一下)

变量名:JAVA_HOME

变量值:E:\ProgramSoftware\java\JAVAHOME\jdk1.8.0_162

变量值:%JAVA_HOME%\bin

变量值:%JAVA_HOME%\jre\bin

使用java -version、javac验证(注意上面bin以及\jre\bin都要配置,不然会出现hadoop找不到JAVA_HOME的问题)

6. 将winutil.exe放置到hadoop-2.7.7\bin\目录下面。(wintil.ext下载,GitHub中选一个比自己hadoop版本相同或者说高一点的版本)

7. 将winutil.exe以及hadoop-2.7.7\bin\hadoop.dll放置到C:\Windows\System32中

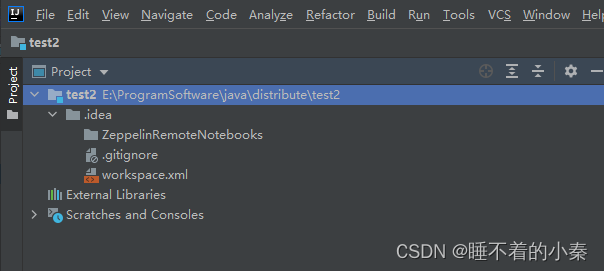

8. 使用idea打开一个空的目录

9. 添加maven,点击Add Framwork Support

添加maven

添加成功后会出现main与test

10.配置maven,将Linux虚拟机中hadoop-2.7.7\etc\core-site.xml与hadoop-2.7.7\etc\hdfs-site.xml复制到resource下(可以通过log4j.properties配置控制台日志的输出等级,可以自己上网查询其他的输出等级策略)

log4j.rootLogger=debug,stdout,R log4j.appender.stdout=org.apache.log4j.ConsoleAppender log4j.appender.stdout.layout=org.apache.log4j.PatternLayout log4j.appender.stdout.layout.ConversionPattern=%5p - %m%n log4j.appender.R=org.apache.log4j.RollingFileAppender log4j.appender.R.File=mapreduce_test.log log4j.appender.R.MaxFileSize=1MB log4j.appender.R.MaxBackupIndex=1 log4j.appender.R.layout=org.apache.log4j.PatternLayout log4j.appender.R.layout.ConversionPattern=%p %t %c - %m%n log4j.logger.com.codefutures=DEBUG

11. 配置pom.xml

初始状态

添加下方的内容到pom.xml中,添加后idea会开始猛烈地加载需要的资源文件,下载完成后原先的红色pom.xml会变成蓝色(注意:hadoop的版本要和自己的版本一样)

<properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

<maven.compiler.source>1.8</maven.compiler.source>

<maven.compiler.target>1.8</maven.compiler.target>

<hadoop.version>2.7.7</hadoop.version>

</properties>

<dependencies>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>${hadoop.version}</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>${hadoop.version}</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-core</artifactId>

<version>${hadoop.version}</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-jobclient</artifactId>

<version>${hadoop.version}</version>

</dependency>

<dependency>

<groupId>commons-cli</groupId>

<artifactId>commons-cli</artifactId>

<version>1.3.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>${hadoop.version}</version>

</dependency>

</dependencies>

测试

通过上面的操作,idea连接Hadoop集群基本实现了,现在测试

1. 在java中创建一个java文件

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.log4j.BasicConfigurator;import java.io.IOException;

public class HdfsTest {public static void main(String[] args) {

//自动快速地使用缺省Log4j环境。

BasicConfigurator.configure();

try {// 改成你自己的ip以及对应的文件所在的路径

String filename = "hdfs://192.168.47.131:9000/words.txt";

Configuration conf = new Configuration();

FileSystem fs = null;

fs = FileSystem.get(conf);

if (fs.exists(new Path(filename))){// 在控制台搜索the file is exist 或者not exist 根据你的情况,该文件如果存在就会打

// the file is exist 不存在就会打印 the file is not exist

System.out.println("the file is exist");

}else{

System.out.println("the file is not exist");

}

} catch (IOException e) {

e.printStackTrace();

}

}}

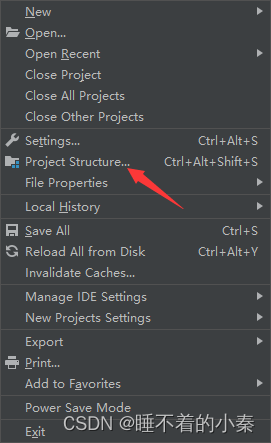

此时大概率是没有配置jdk的,按照下图进行配置

2. 配置成功我们运行程序,在控制台中查看是否存在该word.txt,我的该目录下存在所有打印了the file is exist

3. 实现一个词频统计程序

import java.io.IOException;

import java.util.Iterator;

import java.util.StringTokenizer;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapred.FileInputFormat;

import org.apache.hadoop.mapred.FileOutputFormat;

import org.apache.hadoop.mapred.JobClient;

import org.apache.hadoop.mapred.JobConf;

import org.apache.hadoop.mapred.MapReduceBase;

import org.apache.hadoop.mapred.Mapper;

import org.apache.hadoop.mapred.OutputCollector;

import org.apache.hadoop.mapred.Reducer;

import org.apache.hadoop.mapred.Reporter;

import org.apache.hadoop.mapred.TextInputFormat;

import org.apache.hadoop.mapred.TextOutputFormat;

import org.apache.log4j.BasicConfigurator;

/**

* 单词统计MapReduce

*/

public class WordCount {

/**

* Mapper类

*/

public static class WordCountMapper extends MapReduceBase implements Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

/**

* map方法完成工作就是读取文件

* 将文件中每个单词作为key键,值设置为1,

* 然后将此键值对设置为map的输出,即reduce的输入

*/

@Override

public void map(Object key, Text value, OutputCollector<Text, IntWritable> output, Reporter reporter) throws IOException {

/**

* StringTokenizer:字符串分隔解析类型

* 之前没有发现竟然有这么好用的工具类

* java.util.StringTokenizer

* 1. StringTokenizer(String str) :

* 构造一个用来解析str的StringTokenizer对象。

* java默认的分隔符是“空格”、“制表符(‘\t’)”、“换行符(‘\n’)”、“回车符(‘\r’)”。

* 2. StringTokenizer(String str, String delim) :

* 构造一个用来解析str的StringTokenizer对象,并提供一个指定的分隔符。

* 3. StringTokenizer(String str, String delim, boolean returnDelims) :

* 构造一个用来解析str的StringTokenizer对象,并提供一个指定的分隔符,同时,指定是否返回分隔符。

*

* 默认情况下,java默认的分隔符是“空格”、“制表符(‘\t’)”、“换行符(‘\n’)”、“回车符(‘\r’)”。

*/

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

output.collect(word, one);

}

}

}

/**

* reduce的输入即是map的输出,将相同键的单词的值进行统计累加

* 即可得出单词的统计个数,最后把单词作为键,单词的个数作为值,

* 输出到设置的输出文件中保存

*/

public static class WordCountReducer extends MapReduceBase implements Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

@Override

public void reduce(Text key, Iterator<IntWritable> values, OutputCollector<Text, IntWritable> output, Reporter reporter) throws IOException {

int sum = 0;

while (values.hasNext()) {

sum += values.next().get();

}

result.set(sum);

output.collect(key, result);

}

}

public static void main(String[] args) throws Exception {

//快速使用log4j日志功能

BasicConfigurator.configure();

//数据输入路径 这里的路径需要换成自己的hadoop所在地址

String input = "hdfs://192.168.139.100:9000/test/input/word.txt";

/**

* 输出路径设置为HDFS的根目录下的out文件夹下

* 注意:该文件夹不应该存在,否则出错

*/

String output = "hdfs://192.168.139.100:9000/test/output1";

JobConf conf = new JobConf(WordCount.class);

//设置是谁提交

conf.setUser("master");

/**

* 因为map-reduce过程需要我们自定以的map-reduce类,

* 因此,我们需要将项目导出为jar包

* setjar中跟本地hadoop中的词频统计jar包

*/

conf.setJar("E:\\ProgramSoftware\\java\\hadoop2.7.7\\hadoop-2.7.7\\share\\hadoop\\mapreduce\\hadoop-mapreduce-examples-2.7.7.jar");

//设置作业名称

conf.setJobName("wordcount");

/**

* 声明跨平台提交作业

*/

conf.set("mapreduce.app-submission.cross-platform","true");

//很重要的声明

conf.setJarByClass(WordCount.class);

//对应单词字符串

conf.setOutputKeyClass(Text.class);

//对应单词的统计个数 int类型

conf.setOutputValueClass(IntWritable.class);

//设置mapper类

conf.setMapperClass(WordCountMapper.class);

/**

* 设置合并函数,合并函数的输出作为Reducer的输入,

* 提高性能,能有效的降低map和reduce之间数据传输量。

* 但是合并函数不能滥用。需要结合具体的业务。

* 由于本次应用是统计单词个数,所以使用合并函数不会对结果或者说

* 业务逻辑结果产生影响。

* 当对于结果产生影响的时候,是不能使用合并函数的。

* 例如:我们统计单词出现的平均值的业务逻辑时,就不能使用合并

* 函数。此时如果使用,会影响最终的结果。

*/

conf.setCombinerClass(WordCountReducer.class);

//设置reduce类

conf.setReducerClass(WordCountReducer.class);

/**

* 设置输入格式,TextInputFormat是默认的输入格式

* 这里可以不写这句代码。

* 它产生的键类型是LongWritable类型(代表文件中每行中开始的偏移量值)

* 它的值类型是Text类型(文本类型)

*/

conf.setInputFormat(TextInputFormat.class);

/**

* 设置输出格式,TextOutpuTFormat是默认的输出格式

* 每条记录写为文本行,它的键和值可以是任意类型,输出回调用toString()

* 输出字符串写入文本中。默认键和值使用制表符进行分割。

*/

conf.setOutputFormat(TextOutputFormat.class);

//设置输入数据文件路径

FileInputFormat.setInputPaths(conf, new Path(input));

//设置输出数据文件路径(该路径不能存在,否则异常)

FileOutputFormat.setOutputPath(conf, new Path(output));

//启动mapreduce

JobClient.runJob(conf);

System.exit(0);

}

}

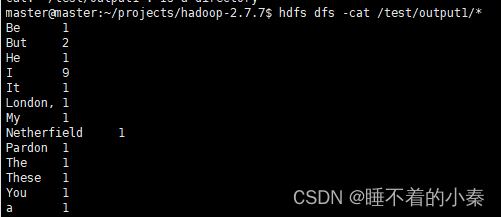

最后在Linux虚拟机中的maser节点输入

hdfs dfs -ls /test/output/*

结语:

至此idea连接Hadoop集群配置完成,更多的操作可以通过Hadoop提供configuration类filesystem类、FSDataInputStream类和FSDataOutputStream类实现。

有问题的朋友可以留言,我会及时回复我所能解决的问题,一些我安装时遇到的问题放在后面,大家可以浏览查看。

问题:

1. Hadoop文件放在windows环境下,按要求添加Hadoop环境变量,出现:

JAVA_HOME is incorrectly set.Please update C:\hadoop-3.1.2\etc\hadoop\hadoop-env.cmd

第一次尝试,Hadoop压缩文件是从linux上传会windows的,出现上面的报错,查阅资料发现在hadoo-env.sh文件下JAVA_HOME确实被设置为了linux的路径,尝试使用notepad++修改,主要有两种修改方式:

(1)set JAVA_HOME=${JAVA_HOME}

(2)set JAVA_HOME=xxxx\jdk1.8.0_162

修改之后还是出现了问题,便开始查看是不是jdk配置有问题,在命令行中输入java -version能够正常运行,但是输入javac却没有反应,刚开始没有重视这个问题,便再次查看是不是Hadoop配置有问题,仔细查看配置文件基于环境变量,确认无误后。再次将矛头指向javac,于是查看javac启动不成功的原因,看到了jdk正确的配置方式。

![]()

自己windows配置jdk并没有配置第二条,于是加上后,再次运行Hadoop -version便成功了。

2.按照ubantu server ip配置教程进行配置后,发现ping不了www.baidu.com。ip地址配置需要遵循的原则是与虚拟机的ip、网关、子网掩码一样。通过检查发现教程中给的网关最后一位是1但是虚拟机中的网关最后一位是2,更改后正常上网。

3.hadoop集群五大文件配置时,发现大部分教程没有修改etc/hadoop目录下的hadoop-env.xml文件,如果就使用原来的set JAVA_HOME={JAVA_HOME} 会出现找不到jdk的情况,需要将其设置为自己本地的jdk路径

4.在配置pom.xml的时候发现jdk.tool依赖项,会因为版本原因导致无法正常编译,正确的解决方式是将systempath改为本地的JAVA_HOME(虽然爆红了,但是不要紧)

5.当完成全部后如果出现无法连接,大概率是本地的hdfs-site.xml和core-site.xml中使用了别名(master、s1),应该替换成master主机的ip

core-site.xml

hdfs-site.xml

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)