使用SAM为医学图像定制分割模型(2023+Customized Segment Anything Model forMedical Image Segmentation,微调)

提出了基于SAM医学图像分割的通用解决方案SAMed,探索针对医学图像分割的定制化大规模模型的研究新范式。SAMed将低秩调优策略应用于SAM图像编码器,并在标记医学图像分割数据集上与提示编码器和掩码解码器一起进行调优。预微调策略和AdamW优化器使SAMed成功收敛并降低了损失。与SAM不同的是,SAMed可以对医学图像进行语义分割。由于SAMed只更新SAM参数的一小部分,部署成本和存储成本非

问题总结:

1.医学图像数据不像自然图像一样容易通过互联网获取。

2.自然图像分割更关注于边界,但解剖或病理结构的分析在医学图像分割中同样起着至关重要的作用。

3.SAM无法再医学图像做到语义分割。

贡献点:

1.首先对SAM进行扩展,探索其在医学图像语义标签分割上的能力。

2.考虑到性能、部署和存储开销,提出了图像编码器的自适应和一系列调优策略。

通过冻结图像编码器,采用基于低秩的微调策略(low-rank-based fine - tuning strategy, LoRA)近似图像编码器中参数的低秩更新,对SAM的轻量级提示编码器和掩码解码器进行微调。

LoRA认为变压器块中参数的更新是渐进的,并设计了低秩近似来微调大规模语言模型。

3.SAMed,在DSC和HD数据集(腹部多器官分割数据集)中,与之前设计良好的医学图像分割方法相比,取得了极具竞争力的结果。

模型:

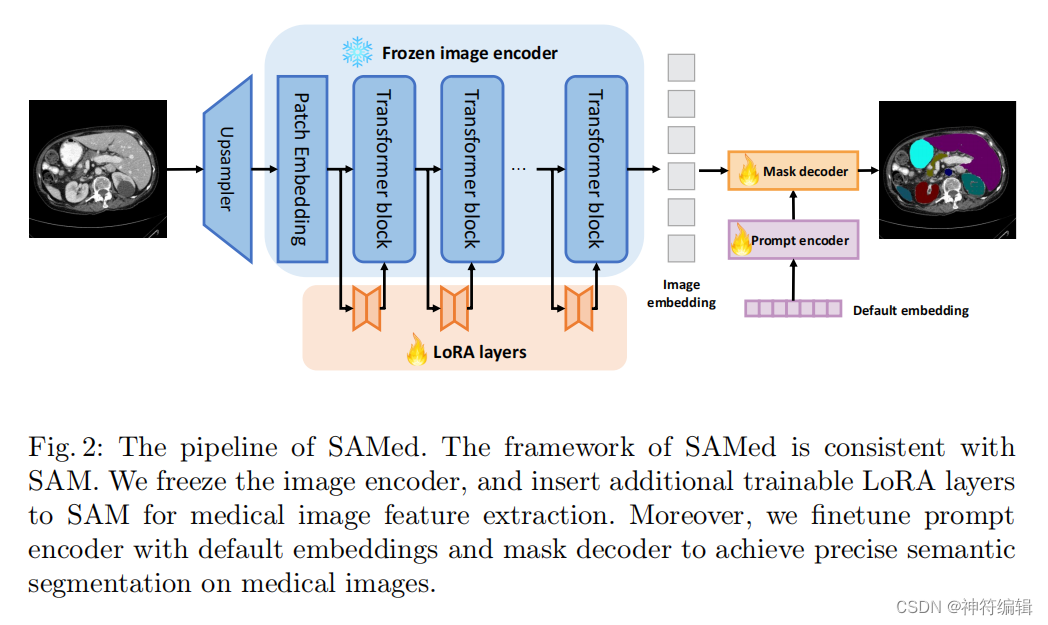

SAMed的框架与SAM一致。首先冻结图像编码器,并在SAM中插入额外的可训练的LoRA层,用于医学图像的特征提取。此外,还用默认嵌入和掩码解码器对提示编码器进行微调,以实现对医学图像的精确语义分割。另外,采用以下方式进行微调。

损失函数:使用交叉熵损失函数和dice损失函数。

warmup:SAMed采用warmup来稳定训练过程,并在训练前期熟悉医疗数据。然后,SAMed利用指数学习率衰减使训练过程逐渐收敛。

优化器:adamW。

图像编码器中的LoRA:LoRA允许SAM在医学图像的训练过程中更新一小部分参数,不仅节省了计算开销,而且在保证分割性能的同时降低了调优模型的部署和存储难度。

提示:了追求快速和自动的医疗诊断,SAMed在推理过程中不需要任何提示。由于SAM中的提示编码器在没有提供提示时使用默认嵌入,因此SAMed保留此默认嵌入并使其在调优过程中可训练。

实验结果:如下表

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)