报错:If reserved memory is >> allocated memory

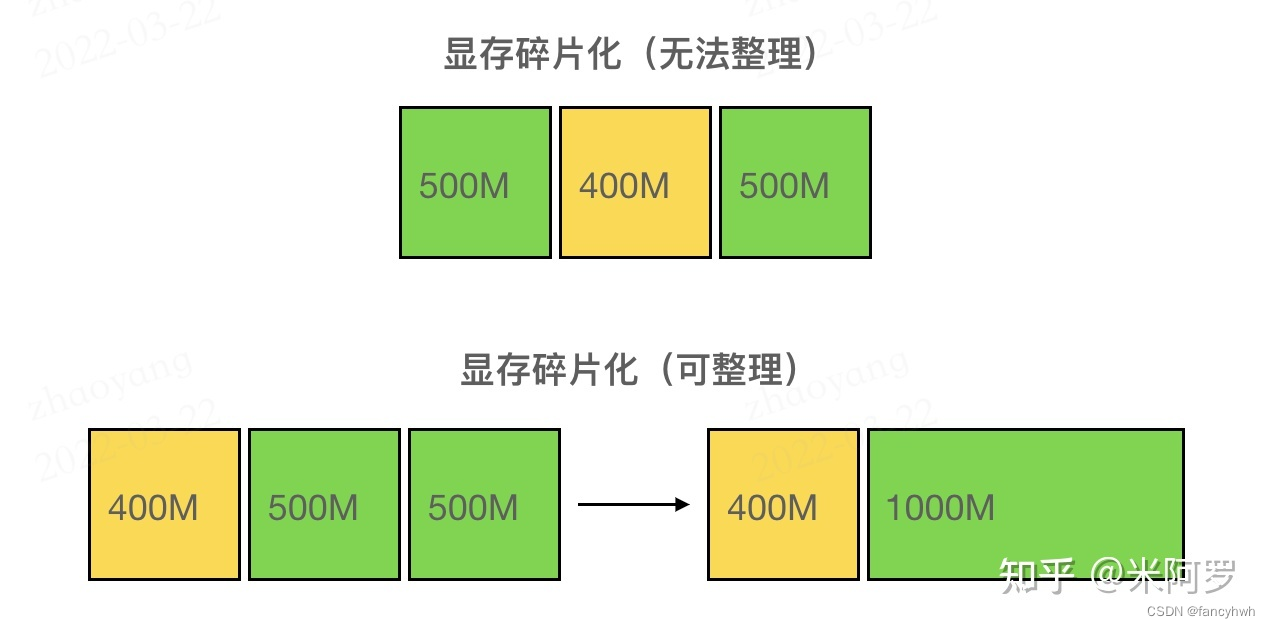

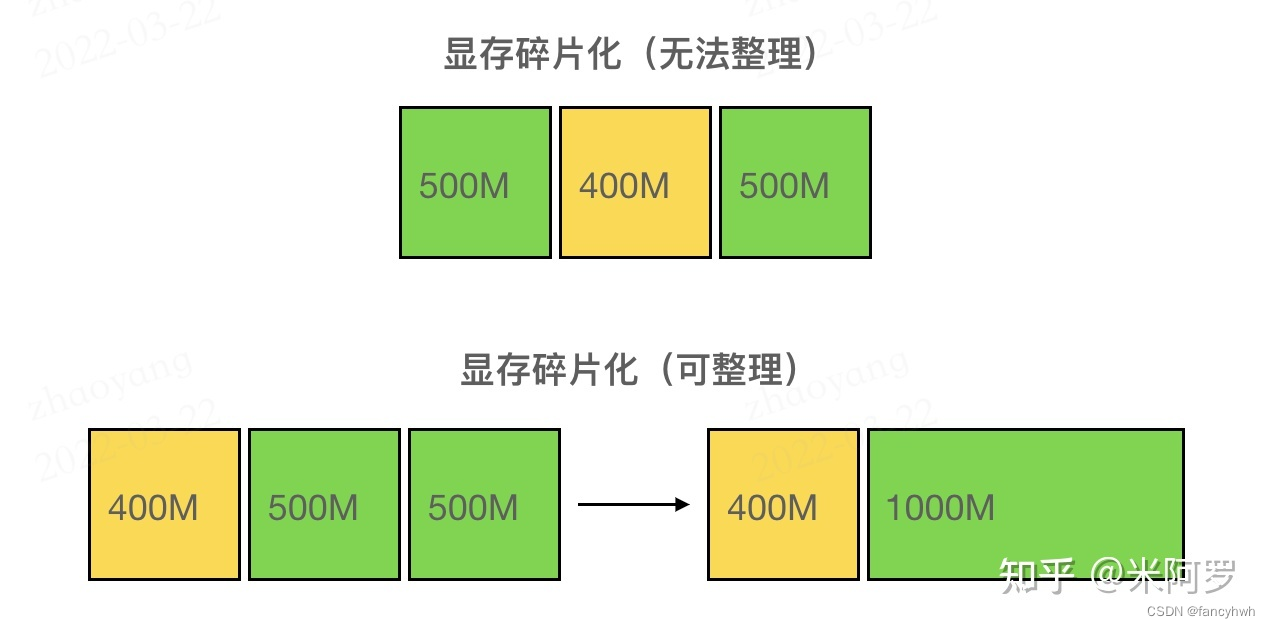

代表目前可分配的显存足够,但是因为碎片化无法分配,需要整理碎片化显存,释放出能够用于运行的容量。将小于128Mb大小的空闲显存block重新分配。

一键AI生成摘要,助你高效阅读

问答

·

If reserved memory is >> allocated memory try setting max_split_size_mb to avoid fragmentation. See documentation for Memory Management and PYTORCH_CUDA_ALLOC_CONF

代表目前可分配的显存足够,但是因为碎片化无法分配,需要整理碎片化显存,释放出能够用于运行的容量。

显存管理机制:RuntimeError: CUDA out of memory.一些调bug路程 - 知乎 一文读懂 PyTorch 显存管理机制 - 知乎

解决方法:

1.运行模型前添加下面两行代码,将小于128Mb大小的空闲显存block重新分配:

import os

os.environ["PYTORCH_CUDA_ALLOC_CONF"] = "max_split_size_mb:128"2.如果还是报错,可以在训练前添加下面两行代码,清理缓存:

if hasattr(torch.cuda, 'empty_cache'):

torch.cuda.empty_cache()更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)