简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

很多企业在 AI 出现事故之后,才开始讨论 AI 治理。但如果治理是在问题发生后才启动,其实已经太晚。真正有效的 AI Governance 必须在系统运行之前和运行过程中实现,而不是事故之后的解释机制。

因为当 AI 进入业务核心流程后,企业需要的已经不是一套“看上去很完整”的治理框架,而是一套能落到运行层、证据层、控制层和复盘层的真实机制。而这,也许才是 AI 治理从“政策话术”走向“生产现实”的分界线。

很多企业在谈 AI 治理 时,首先想到的是制度、审批、权限、流程、合规文件。这些都重要,但如果 AI 已经进入真实生产环境,只靠静态规则和事后审计,通常是不够的。因为 AI 系统的风险,不是只发生在上线前,也不是只发生在季度审查里。

很多企业在谈 AI 治理 时,首先想到的是制度、审批、权限、流程、合规文件。这些都重要,但如果 AI 已经进入真实生产环境,只靠静态规则和事后审计,通常是不够的。因为 AI 系统的风险,不是只发生在上线前,也不是只发生在季度审查里。

AI治理真正缺的,不只是规则,而是运行时行为控制机制。Behavior Control 的核心,不是事后解释模型为什么这样做,而是在高风险节点对系统行为进行识别、约束、中断、降级、回退与审计。尤其在 Agent 和可执行型 AI 场景下,只有能真正控制行为的治理层,才算进入了可执行、可验证、可落地的生产级治理。

本文聚焦AI治理层中的策略执行引擎(Policy Engine)设计,分析其在运行时控制、风险约束、权限边界、审计留痕与策略落地中的核心作用。文章将从架构定位、核心能力、执行机制与生产设计原则出发,说明企业如何通过Policy Engine把治理规则真正转化为可执行、可审计、可回滚的系统控制能力。

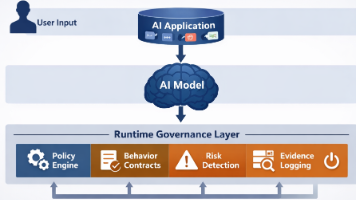

本文探讨了AI治理层(AIGovernance Layer)作为AI系统核心基础设施的关键作用。文章指出,有效的AI治理需要在系统层面建立技术化的治理能力,而非仅依赖政策文件。AI治理层位于应用系统与AI模型之间,通过策略引擎、运行时防护、可观测系统、审计系统和执行控制层等模块,实现行为控制、实时监控、风险管理和决策追溯等功能。设计原则强调运行时执行、策略代码化、默认可观测性、模块化架构和低延迟要

随着AI系统从实验阶段走向生产环境,传统的AI系统架构开始暴露出一个关键缺口:缺少对AI行为的实时控制与治理能力。大多数系统只关注模型能力,却忽视了对AI行为的约束、审计与风险管理。本文提出,在AI应用层与模型层之间,需要增加一层新的系统组件——AI Governance Layer(AI治理层)。这一层负责策略控制、风险检测、决策审计和运行时干预,使AI系统具备可控、可审计、可治理的能力。随着A

在许多企业的 AI 架构中,系统通常是这样的:用户请求 → 应用系统 → AI模型 → 输出结果这种架构忽略了一个关键层:AI Governance Layer(AI治理层)