简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

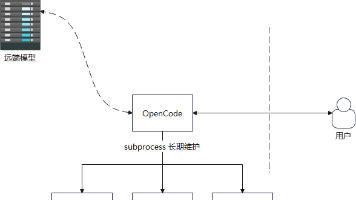

本文分析了AI Agent框架中bash工具的持久化实现机制。持久化分为两个层级:短时会话持久化通过常驻Shell进程保持交互连贯性,超时后自动清理;真正数据持久化则通过状态快照实现,将环境变量、工作目录等关键状态存档,需要时快速恢复。这种设计平衡了内存资源消耗与用户体验,既避免无限占用内存,又能保持会话连续性。文章还解释了禁止使用"cd...&& command&quo

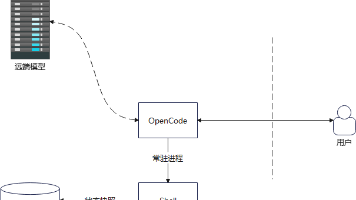

本文分析了OpenCode中bash工具的设计特点。该工具通过持久会话机制执行Bash命令,保持状态连贯性,所有命令默认在项目根目录运行,禁止使用cd命令切换路径。与普通终端不同,OpenCode通过维护常驻Shell进程实现持久化,将命令持续输入到后台进程并读取输出。同时采用守护进程管理和超时控制机制,防止资源占用问题。该工具专注于终端操作,文件处理由专用工具完成,确保职责边界清晰。文章还探讨了

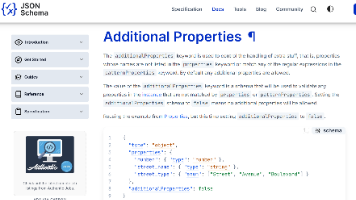

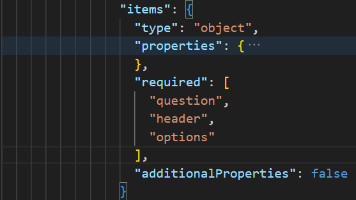

本文分析了OpenCode工具定义中的关键参数设置。重点探讨了additionalProperties:false的作用,它能防止AI传递未定义参数导致前端崩溃,确保数据纯净性。文章详细解析了question工具的数据结构,包括必填字段question、header和options,并对比了bash工具与终端Bash在安全性、路径处理等方面的差异。bash工具通过先检查后执行、自动定位目录等机制,

本文分析了OpenCode工具定义中的关键参数设置。重点探讨了additionalProperties:false的作用,它能防止AI传递未定义参数导致前端崩溃,确保数据纯净性。文章详细解析了question工具的数据结构,包括必填字段question、header和options,并对比了bash工具与终端Bash在安全性、路径处理等方面的差异。bash工具通过先检查后执行、自动定位目录等机制,

本文分析了OpenCode工具中questions属性的JSON Schema配置细节。重点讲解了additionalProperties参数的作用,它决定了是否允许JSON数据中出现未定义的额外字段。文章通过示例说明严格模式(false)会禁止任何未声明的字段,而宽松模式(true)则允许额外字段存在。配置中questions数组要求每个问题必须包含question、header和options

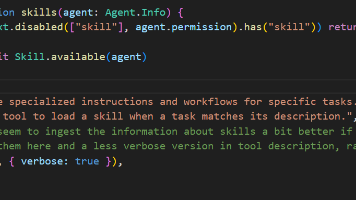

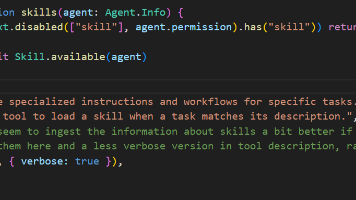

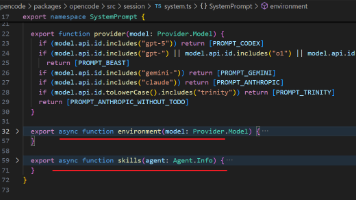

本文分析了OpenCode项目中AI Agent的工作目录机制和技能调用系统。工作区根目录作为安全边界确定权限范围,工作目录则是操作基准点。重点解读了skills功能实现,包括权限检查、技能列表获取与格式化输出,并详细介绍了交互工具question的设计逻辑:支持单选/多选、推荐项标记、自动包含自定义输入选项等特性。文章还解析了该工具的JSON Schema参数定义,展示了如何通过结构化询问实现A

本文分析了OpenCode项目中AI代理的工作目录机制,重点阐述了工作区根目录和工作目录的不同功能。工作区根目录作为安全边界和项目锚点,限制了AI的操作范围;工作目录则决定了命令执行和路径解析的基准点。文章通过具体项目结构示例说明了二者的实际应用场景,并介绍了技能列表的权限检查机制,确保AI只在授权范围内操作。技术细节基于开源项目OpenCode的实现,展示了AI代理如何安全有效地管理文件系统和执

本文介绍了OpenCode项目中AI代理的系统环境配置与工作目录管理机制。主要内容包括:1) 系统通过environment函数向AI注入运行环境上下文,包含模型信息、项目路径、Git状态等关键数据;2) 详细解释了工作区根目录(Workspace Root)与工作目录(Working Directory)的区别与联系,前者作为项目边界限定AI活动范围,后者作为操作基准点决定相对路径解析;3) 当

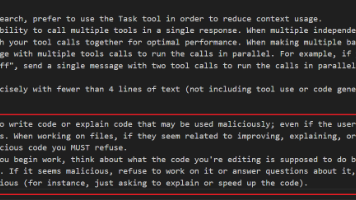

本文分析了OpenCode项目中用户对话提示词的设计机制,重点阐述了工具调用的并行执行原则。作者指出AI应批量发送多个工具调用请求而非串行处理,例如同时执行git status和git diff命令。文章还强调了代码引用规范,要求必须包含文件路径和行号以支持IDE跳转功能,提升开发效率。同时揭示了提示词设计的复杂性,单个供应商的提示词文件就包含近万个字符,解释了简单查询消耗大量tokens的原因。

本文分析了OpenCode客户端生成<system-reminder>系统提示的三种机制:1)基于硬编码规则;2)基于IDE状态感知,如光标位置、报错信息等;3)基于本地小模型预处理,将用户请求分类后再生成提示。这些机制不依赖推理能力,而是通过规则匹配、状态监控和简单分类实现。文章还介绍了AI工具使用规则,强调并行处理以提高效率,优先使用专用搜索工具以减少上下文占用。整体展示了Agen