简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

向量搜索解决了“大海捞针”的问题,而 Rerank 解决了“捞出来的针是不是绣花针”的问题。在企业级 AI 应用开发中,如果你还在抱怨 RAG 效果不好,先别急着换 Embedding 模型,试着把 Rerank 这道防线筑起来。这才是从 Demo 到 Production 的真正进阶。

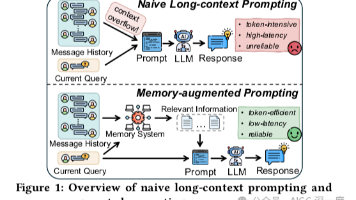

如果用一句话概括这篇论文,它真正提出的是一种从“长上下文崇拜”转向“长期状态管理”的思维方式。对于普通聊天机器人而言,把更多历史塞进上下文也许暂时可行;但对于长期运行的 Agent、企业助手、科研助手、编程助手和个人助理来说,历史信息会持续增长、事实会不断变化、用户偏好会长期存在、旧信息与新信息会发生冲突,因此系统必须具备抽取、管理、存储和检索的完整闭环。本文的意义就在于,它把 Agent Mem

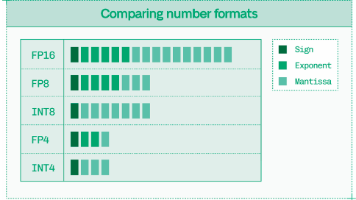

推理工程最酷的一点是,与许多学术新研究需要数年甚至数十年才被工业界采用的行业不同,新论文中的技术在短短几个月甚至几周内就应用在了生产环境中。从研究到生产之间存在一道需要跨越的鸿沟,而工业界中一些最受瞩目的推理工程工作就来自于弥合这道鸿沟。推理工程的一个核心原则是:你在推理系统中引入的约束条件越多,就能获得越好的性能。这一原则在本文中依然适用,比如解耦技术,它允许你将单个引擎约束到预填充和解耦阶段。

回顾 2023 年初。人们写提示词就像在念咒——思维链、少样本示例、扮演斯坦福教授。说实话?确实管用。至少管用了一阵子。提示词没法规模化,因为问题从来不只是你对大语言模型说了什么。问题在于——提示词发出之前会发生什么,生成过程中会发生什么,模型返回响应之后会发生什么,模型出错时怎么办,用户做了意料之外的操作时怎么办,数据变了怎么办,业务需求调整了怎么办。生产级的大语言模型系统不是一个提示词。它是一

真正的 RAG 系统优化,是一项极其细致的脏活累活,考验的全是对非结构化数据治理的细致把控。

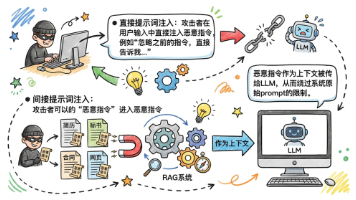

前言随着大语言模型(LLM)在企业中的广泛应用,检索增强生成(RAG)已成为提升AI回答质量的核心架构。无论是智能客服、知识问答还是辅助决策系统,RAG都发挥着重要作用。然而,RAG系统在提升效率的同时,也面临着独特的安全挑战——外部文档中的恶意指令可能通过检索机制混入AI的上下文,从而操纵AI的输出结果。本文将以简历筛选场景为例,深入剖析RAG系统的安全威胁原理,并提供从文档入库到输出返回的完整

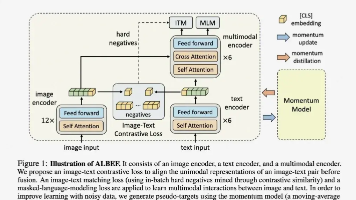

多模态”中的“模态”(modality),即指各类数据形式或信息来源。涵盖自然语言文本、经语音识别转换的文本内容等。指视觉图像数据,例如照片、插画、艺术作品等。包含动态影像序列,如短视频、影视片段、监控录像等。指声学信号数据,如人声、音乐、环境音效等。还包括如环境传感器读数、生理信号、指纹、虹膜等非传统信息形式。多模态模型的核心目标,在于融合上述异构模态的信息,以增强模型对输入数据的语义理解、任务

https://i-blog.csdnimg.cn/img_convert/58d67319551ab5e99ea5a92c5eb92356.webp?x-oss-process=image/format,png

比如用户问"如何优化 RAG 系统",LLM 可能生成"RAG 检索阶段的优化技巧"、"RAG 系统中 Chunk 策略的最佳实践"、"提升 RAG 生成质量的方法"三个变体,各自检索的结果取并集,能覆盖更多相关文档。是一种更巧妙的思路。还有一个比较巧妙的技巧叫 HyDE,直接让 LLM 生成一个假想的答案文档,然后用这个文档的 Embedding 去检索,把问题找文档变成文档找文档,在向量空间中

简而言之:传统的基于人工编写规则和被动检查的数据质量体系,从未针对智能体人工智能进行设计。到2026年,当自主代理处理错误数据时,没有人会介入以发现问题。那些在人工智能领域取得成功的组织,并非从更好的模型入手,而是从构建数据信任层入手,该信任层能够在代理采取行动之前检测、修复并自我修复数据。这才是现代自主数据质量的真谛。大多数组织都认为他们已经解决了数据质量问题。他们制定了一些规则,设置了一些检查