简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

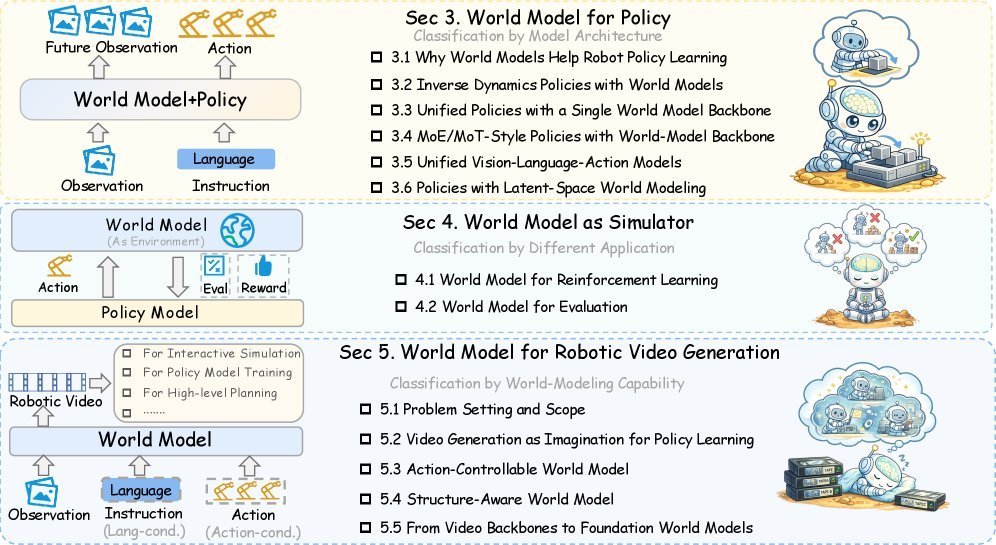

01 VLA策略的瓶颈,世界模型的机会 ArXiv URL:http://arxiv.org/abs/2605.00080v1 当前机器人学习的主流范式——Vision Language Action(VLA)策略,试图将感知、语言理解和控制统一到一个端到端模型中。 但一个核心矛盾越来越明显:纯反应式的VLA策略在长时间序列推理、误差累积和物理环境鲁棒性上表现不佳。 问题不仅仅出在动作预测能力不足

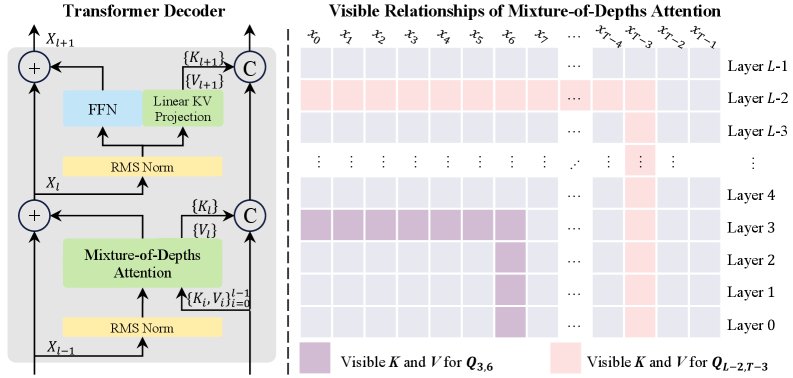

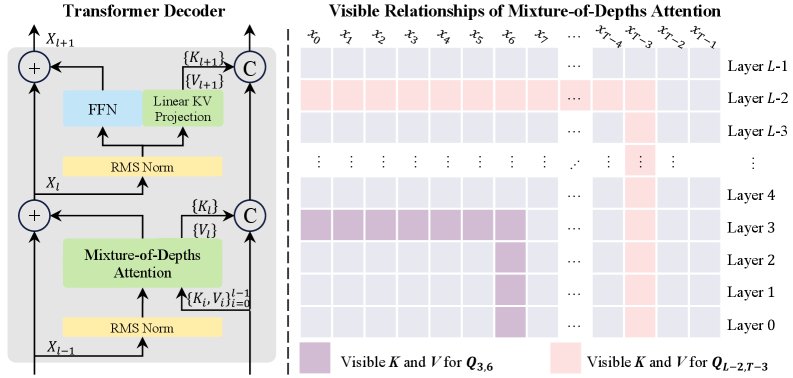

大模型(LLM)的竞赛似乎很简单:堆更多的层,模型就会更强大。但现实却给了我们一记重拳——模型越深,反而越容易“忘记”浅层学到的关键信息。这种现象被称为 信号衰减 (signal degradation)。 ArXiv URL:http://arxiv.org/abs/2603.15619v1 每一层网络都在努力学习,但随着层层堆叠,有价值的特征信号在反复的残差更新中被稀释,导致深层网络难以有效利

大模型(LLM)的竞赛似乎很简单:堆更多的层,模型就会更强大。但现实却给了我们一记重拳——模型越深,反而越容易“忘记”浅层学到的关键信息。这种现象被称为 信号衰减 (signal degradation)。 ArXiv URL:http://arxiv.org/abs/2603.15619v1 每一层网络都在努力学习,但随着层层堆叠,有价值的特征信号在反复的残差更新中被稀释,导致深层网络难以有效利

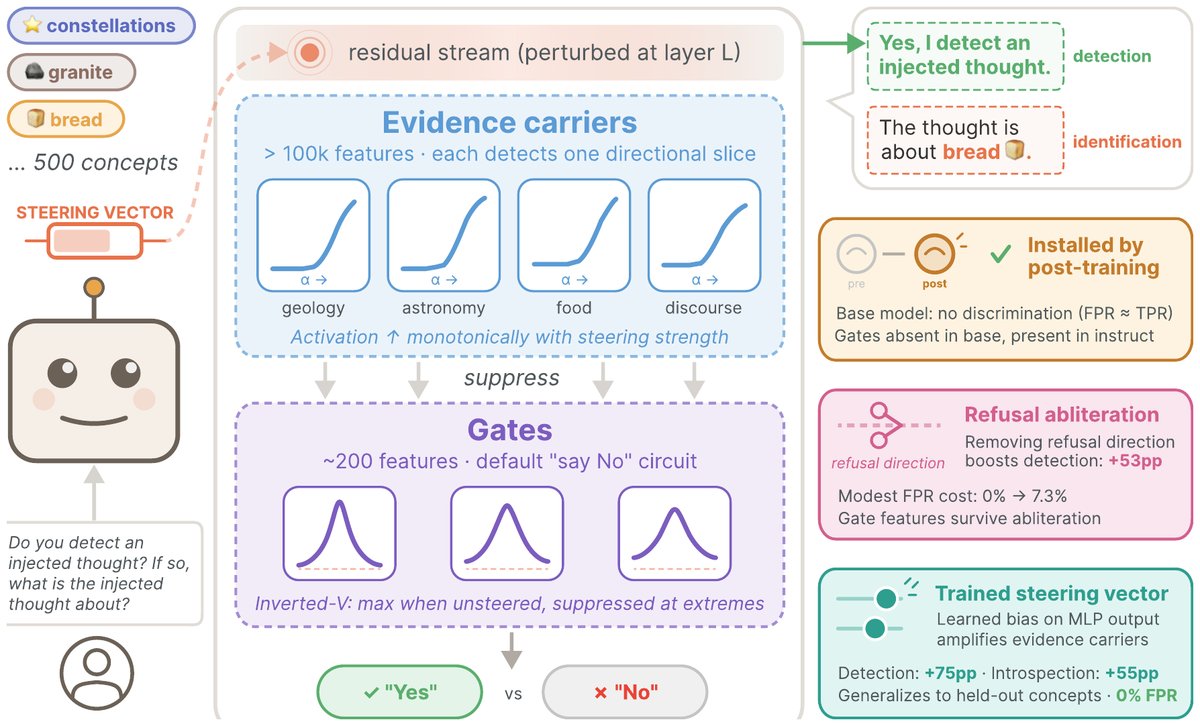

如果我们能直接向AI提问:“你刚才在想什么?”,甚至在它的“大脑”中植入一个想法,它能察觉到吗? ArXiv URL:http://arxiv.org/abs/2603.21396v1 这听起来像是科幻电影的情节,但Anthropic的最新研究表明,大型语言模型(LLM)可能真的具备这种初步的“内省意识”。 当研究人员向模型内部注入一个特定概念(如“面包”)时,模型不仅能察觉到这种“外来思想”,还

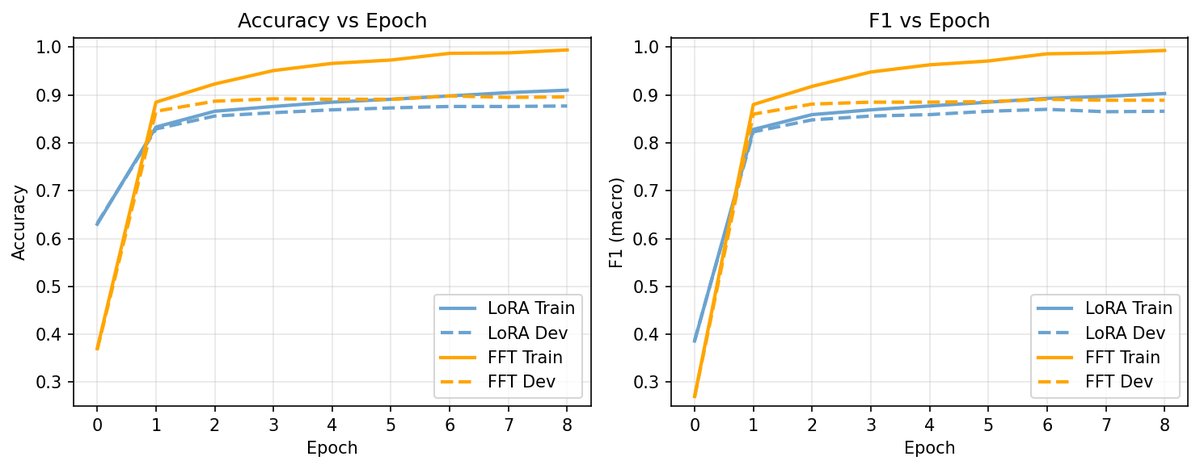

当前, 直接偏好优化 ( Direct Preference Optimization, DPO )和 低秩适配 ( Low Rank Adaptation, LoRA )几乎已成为大模型对齐与微调的“标准动作”。我们似乎默认,先用SFT做监督微调,再用DPO对齐偏好,同时用LoRA来节省资源,就是一套黄金组合拳。 ArXiv URL:http://arxiv.org/abs/2603.20100

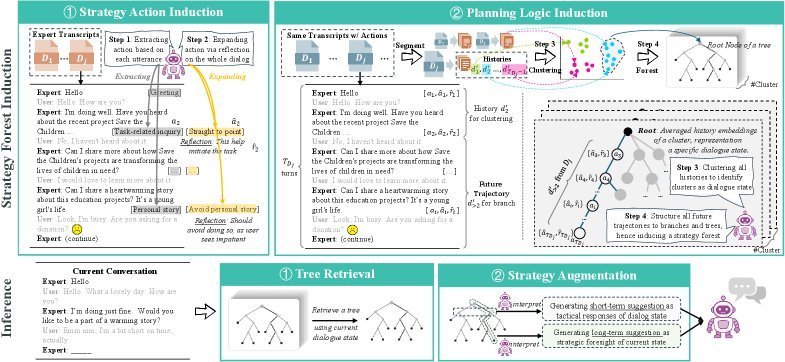

在人机对话的广阔世界里,除了我们熟悉的闲聊机器人和任务型助手,还存在一类特殊的对话智能体—— 非合作型对话代理 (non collaborative dialogue agents)。它们被设计用于处理那些双方利益存在冲突的场景,例如商业谈判、慈善募捐、债务催收等。在这些对话中,智能体需要运用精妙的策略,在多轮博弈中引导对话走向,以达成对自身有利的目标。 ArXiv URL:http://arxi

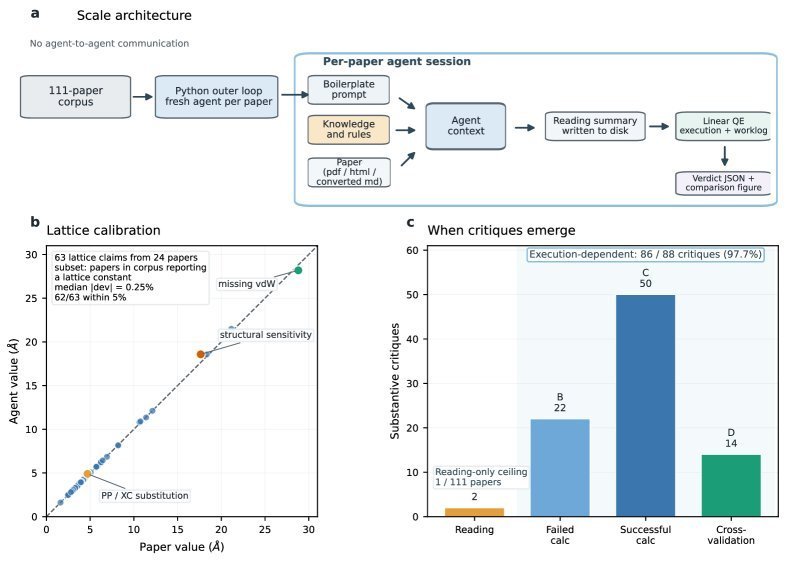

普林斯顿大学的一项新研究,让一个大模型 Agent 真正当了一回“物理学家”,其成果不仅令人印象深刻,更对科研范式本身提出了深刻的挑战。这个由 Claude Opus 4.6 驱动的 AI Agent 自主完成了一个完整的“迷你科研循环” (mini research loop):它能阅读一篇已发表的计算物理学论文,复现其核心计算,批判性地评估其结论,甚至在此基础上进行扩展,最终撰写出一篇足以发表

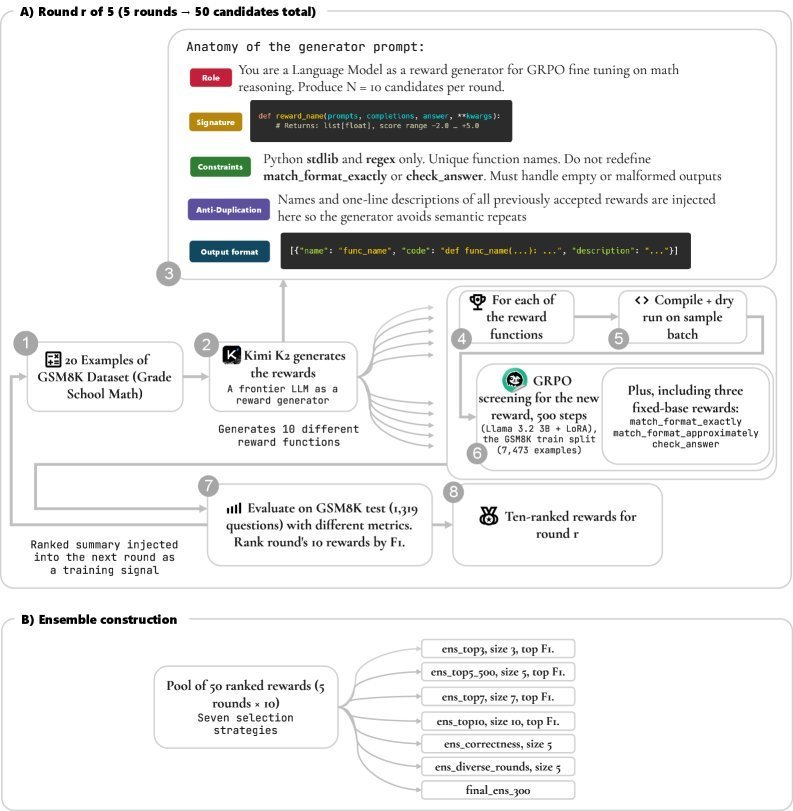

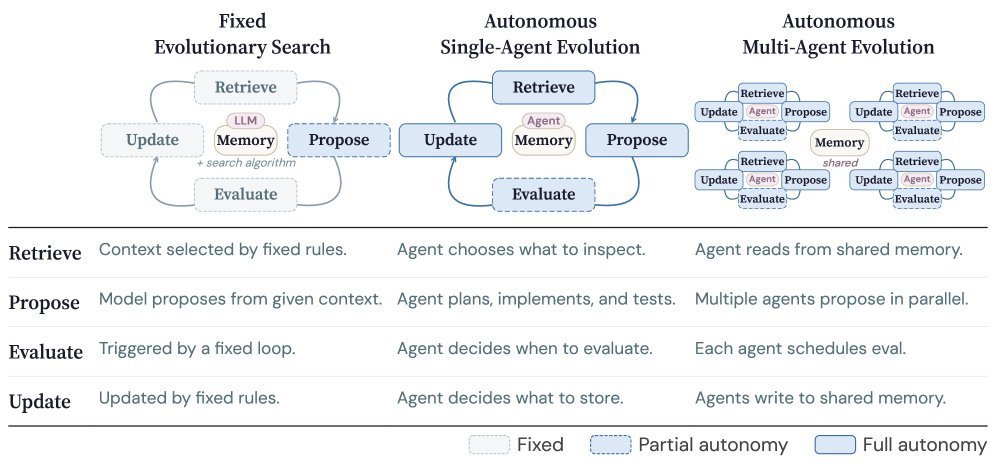

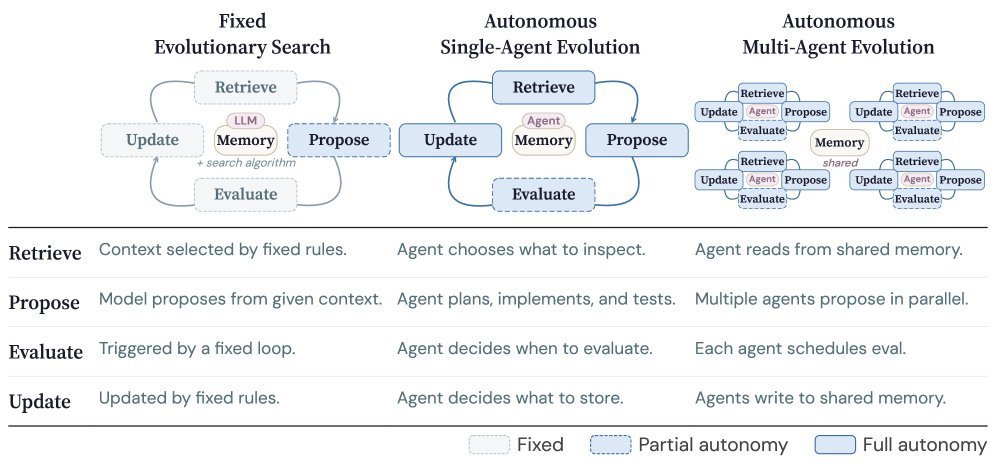

对于许多科学与工程领域的开放式问题——例如,为复杂的物流系统找到最优调度启发式算法,或为特定硬件编写最高效的计算内核——我们往往没有标准答案。唯一的路径是通过不断的提出、测试、修正,在迭代循环中探索更好的解决方案。近年来,以 FunSearch、AlphaEvolve 为代表的、基于大语言模型(LLM)的进化式搜索方法在这一领域取得了显著进展。它们将 LLM 作为“变异算子”,嵌入到一个由评估器引

对于许多科学与工程领域的开放式问题——例如,为复杂的物流系统找到最优调度启发式算法,或为特定硬件编写最高效的计算内核——我们往往没有标准答案。唯一的路径是通过不断的提出、测试、修正,在迭代循环中探索更好的解决方案。近年来,以 FunSearch、AlphaEvolve 为代表的、基于大语言模型(LLM)的进化式搜索方法在这一领域取得了显著进展。它们将 LLM 作为“变异算子”,嵌入到一个由评估器引

大型语言模型(LLM)的推理能力,尤其是在数学这类需要严谨逻辑的任务上,一直是衡量其智能水平的关键标尺。为了提升模型的推理表现,研究者们普遍采用强化学习(RL)作为一种有效的“后训练”(post training)对齐手段。然而,强化学习的成败在很大程度上依赖于一个核心要素:奖励函数(reward function)。这个函数定义了什么是“好”的行为,什么又是“坏”的行为,从而引导模型的优化方向。