简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

Homomorphic Encryption and Federated Learning based Privacy-Preserving CNN 国外文献于都

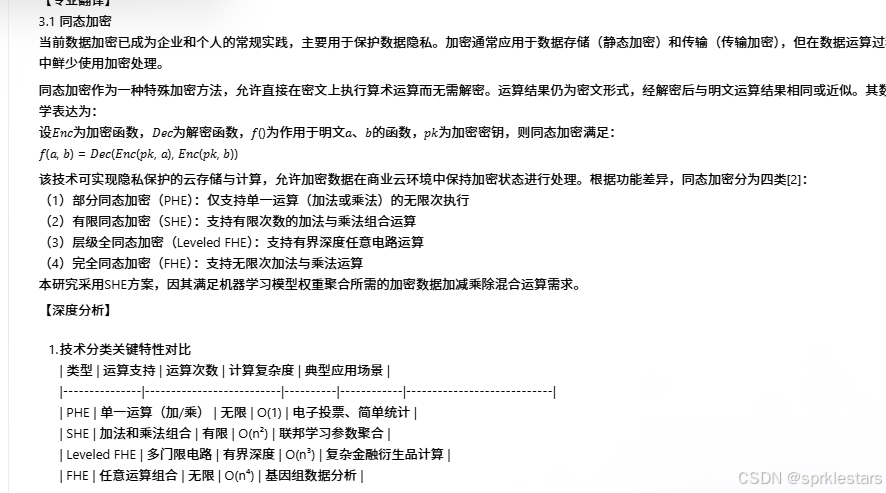

机器学习(ML)是一种广泛应用于各领域的技术,计算机系统可以通过数据学习来提升性能。该技术被广泛应用于图像识别、自然语言处理和机器翻译等领域。联邦学习[13]是一种分布式机器学习技术,训练数据分布在多个设备上,以协作方式进行学习过程。该技术可用于提升医疗数据的隐私安全性[10]。医疗数据通常高度敏感且涉及隐私安全问题[1]。例如,个人健康信息具有机密性,可能被用于身份识别。

A Verifiable Privacy-Preserving Federated Learning Framework Against Collusion Attacks阅读

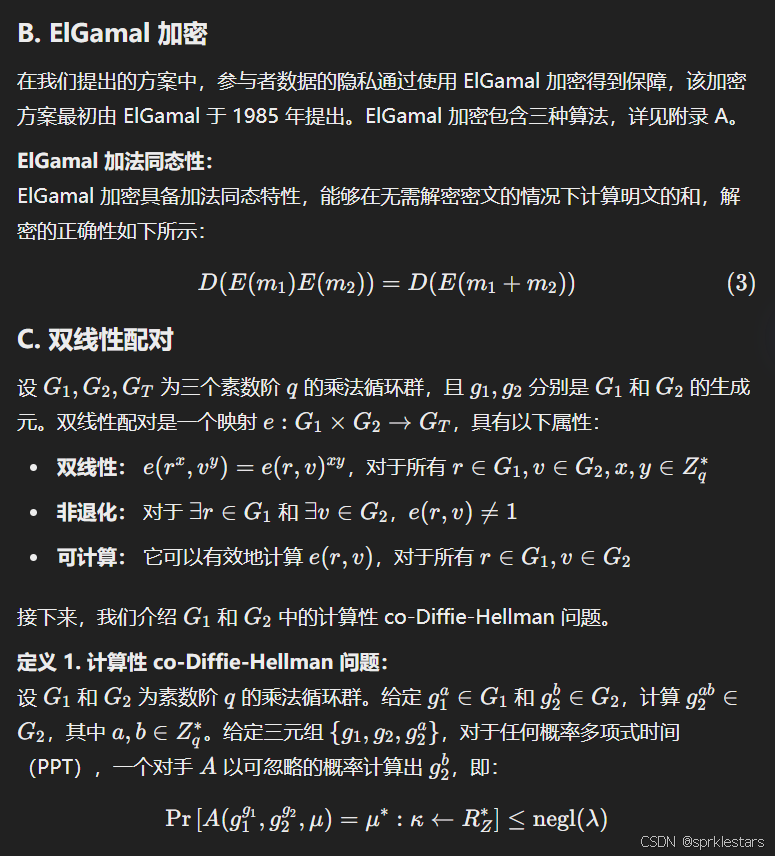

随着算法的显著进步和数据的广泛可用,深度学习在图像识别 [1]、语言翻译 [2]、医学诊断 [3] 和金融投资 [4] 等领域取得了重要里程碑,接近甚至超越了人类水平。大量的数据在促进深度学习训练和预测过程中发挥了关键作用;然而,这也带来了隐私方面的担忧。首先,将参与者的私密数据纳入数据集可能无意中暴露相关个人的敏感信息。此外,当数据上传至服务器时,数据拥有者对其私密数据的使用缺乏意识和控制。某些

TEVA: Training-Efficient and Verifiable Aggregation for Federated Learning for Consumer Electronics

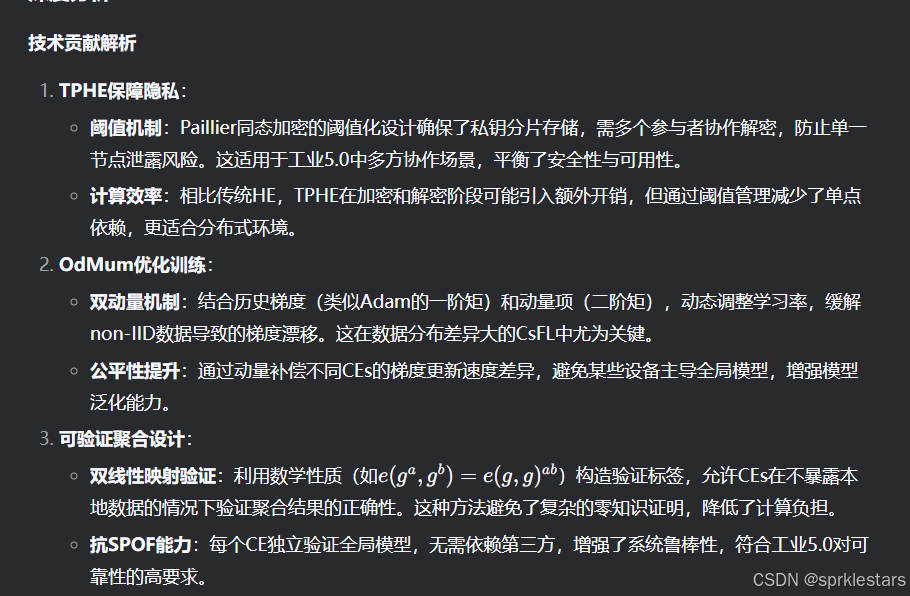

摘要-联邦学习(FL)已被广泛用于工业5.0中的隐私保护模型更新,并得到了6 G网络的支持。尽管FL具有保护隐私的优势,但它仍然容易受到攻击,对手可以从本地模型中推断出私人数据或操纵中央服务器(CS)以提供伪造的全局模型。目前的隐私保护方法,主要是基于FedAvg算法,无法优化非独立和同分布(非IID)数据的训练效率。本文提出了培训有效的和可验证的聚集(TEVA)的FL来解决这些问题。该方案结合了

到底了