AI辅助部署AI:在快马平台用AI编程助手搞定openclaw本地部署

在快马平台,我直接向AI助手描述了需求:"需要为Ubuntu 20.04系统生成openclaw的依赖安装命令,包括CUDA 11.7和Python 3.8环境"。生成的脚本不仅完成了基础功能,还增加了参数合法性检查,避免了我手动计算可能出现的错误。的AI编程助手来搞定openclaw的本地部署,整个过程就像有个懂行的伙伴在旁边随时帮忙,效率提升了不少。最近在折腾AI模型的本地部署,发现了一个特别

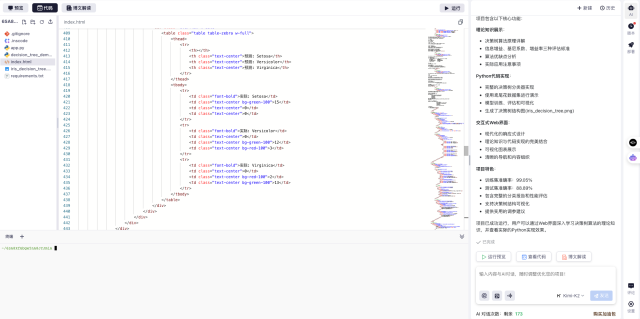

最近在折腾AI模型的本地部署,发现了一个特别有意思的玩法:用AI来辅助部署AI模型。这次我尝试用InsCode(快马)平台的AI编程助手来搞定openclaw的本地部署,整个过程就像有个懂行的伙伴在旁边随时帮忙,效率提升了不少。

-

明确部署需求 刚开始部署openclaw时,我对着官方文档有点懵。不同操作系统、硬件环境的依赖安装方式差异很大,手动处理容易出错。在快马平台,我直接向AI助手描述了需求:"需要为Ubuntu 20.04系统生成openclaw的依赖安装命令,包括CUDA 11.7和Python 3.8环境"。几秒钟后,AI就给出了完整的apt-get和pip安装指令,还贴心地标注了每个依赖项的作用。

-

自动化配置调整 openclaw的配置文件参数需要根据本地GPU显存大小调整。传统方式是反复试错修改配置文件,现在只需要告诉AI助手:"请生成一个Python脚本,自动检测当前GPU显存并计算适合openclaw模型的batch_size参数"。生成的脚本不仅完成了基础功能,还增加了参数合法性检查,避免了我手动计算可能出现的错误。

-

部署状态监控 模型部署后需要实时监控资源占用情况。我向AI提出:"设计一个能在终端显示openclaw模型CPU/GPU占用率、内存使用情况的小工具,每10秒刷新一次"。得到的脚本直接用常见命令行工具实现,不需要额外安装监控软件,特别适合本地测试环境。

-

问题排查协作 部署过程中遇到CUDA版本不兼容的问题,传统方式要花大量时间查资料。而在快马平台,直接把错误日志粘贴给AI助手,它立即分析出是cuDNN版本不匹配,并给出了降级方案和具体操作命令。这种实时排错能力让部署过程顺畅了很多。

-

文档自动化 最后,AI助手还帮我生成了完整的部署文档,包含:

- 分步骤的操作指南

- 常见问题解决方法

- 性能优化建议 这份文档可以直接分享给团队其他成员,省去了手动整理的麻烦。

整个体验下来,最大的感受是AI辅助开发确实能显著降低技术门槛。不需要记住所有命令和参数,只要会描述需求,就能获得可立即执行的解决方案。快马平台把这种协作模式做得特别自然,AI助手的理解能力很强,给出的代码基本都是开箱即用。

最惊喜的是部署环节,完成开发后直接一键就能把openclaw服务发布上线,不用操心服务器配置问题。对于想快速验证AI模型效果的人来说,这种从开发到部署的无缝体验实在太方便了。如果你也在研究AI模型部署,不妨试试用InsCode(快马)平台的AI助手来协作,真的能省下不少折腾环境的时间。

更多推荐

已为社区贡献44条内容

已为社区贡献44条内容

所有评论(0)