从安装到实战:基于快马AI生成openclaw新闻爬虫完整项目实例

我直接用快马平台生成的基础安装脚本,自动处理了所有依赖项。上开发特别高效,它的AI辅助生成功能帮我快速搭建了项目骨架,内置的代码编辑器还能实时验证语法。最惊喜的是部署功能——点击按钮就直接生成了可访问的在线版本,不用自己折腾服务器配置。对于想快速验证爬虫想法的小伙伴,这种从安装到部署的全流程支持真的很省心。特别是当需要调整爬取规则时,改完代码立即就能看到运行效果,比本地开发调试效率高多了。记录下从

最近在做一个新闻数据采集的小项目,尝试了用openclaw这个爬虫框架,发现配合InsCode(快马)平台可以快速生成可运行的项目代码,整个过程特别顺畅。记录下从安装到实战的完整流程,分享给有类似需求的朋友。

- 环境准备与安装

openclaw的安装其实很简单,但要注意它依赖Python3.6+环境。我直接用快马平台生成的基础安装脚本,自动处理了所有依赖项。关键是要确保lxml这个解析库安装成功,因为后续网页内容解析全靠它。

- 项目结构设计

整个项目分为四个核心模块:

- 配置管理:用YAML文件存储目标网站URL、爬取间隔等参数

- 爬虫核心:基于openclaw的Spider类扩展实现

- 数据存储:支持SQLite和CSV两种方式

- 交互界面:简单的命令行菜单系统

- 配置模块实现

配置模块采用了热加载设计,修改配置文件后不需要重启程序。主要配置项包括:

- 目标新闻网站的列表页URL(比如某门户的科技板块)

- 爬取频率(默认30分钟)

- 用户代理伪装头

- 是否开启调试日志

- 爬虫核心逻辑

openclaw的爬虫类需要重写三个关键方法:

- 初始请求生成:构造首个抓取请求

- 页面解析:用XPath提取新闻标题和链接

- 数据清洗:过滤广告等无效内容

特别要注意设置合理的请求间隔,避免被封IP。我加了个随机延时功能,在配置的基准时间上浮动±5秒。

- 数据存储方案

考虑到项目规模不大,优先选择了轻量级的SQLite。数据库表设计很简单:

- 新闻标题(主键)

- 原文链接

- 抓取时间戳

同时也提供了CSV导出功能,方便非技术人员查看数据。

- 命令行交互

通过argparse库实现了三个基础命令:

- install:一键安装依赖环境

- run:启动爬虫任务

- export:导出数据到CSV

- 实际运行效果

测试爬取了某科技媒体的最新文章列表,平均每秒能处理2-3个页面。存储到数据库后,可以用任意SQL客户端查看结果。

- 遇到的坑与解决

-

问题1:某些网站返回403错误 解决:添加了随机User-Agent轮换机制

-

问题2:XPath路径失效 解决:改用更宽松的相对路径选择器

-

问题3:数据库写入冲突 解决:添加了ON CONFLICT REPLACE处理

- 优化方向

后续可以增加:

- 自动翻页抓取

- 内容去重检测

- 邮件报警功能

- 可视化数据看板

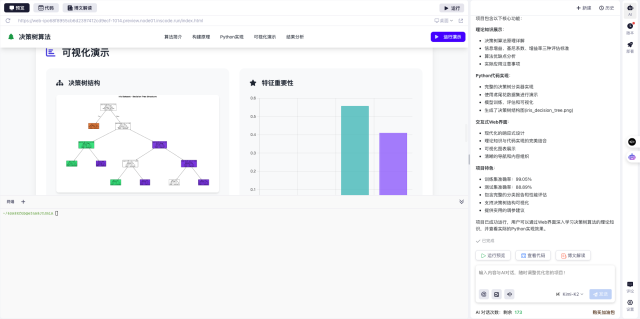

整个项目在InsCode(快马)平台上开发特别高效,它的AI辅助生成功能帮我快速搭建了项目骨架,内置的代码编辑器还能实时验证语法。最惊喜的是部署功能——点击按钮就直接生成了可访问的在线版本,不用自己折腾服务器配置。

对于想快速验证爬虫想法的小伙伴,这种从安装到部署的全流程支持真的很省心。特别是当需要调整爬取规则时,改完代码立即就能看到运行效果,比本地开发调试效率高多了。

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)