利用快马平台与clawhub框架,十分钟搭建你的第一个网络爬虫原型

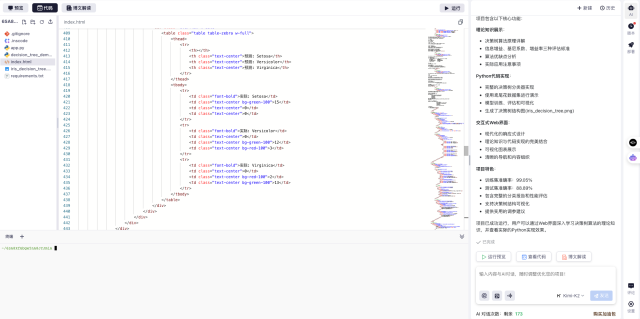

登录后新建Python项目,在AI对话框输入"基于clawhub的新浪科技新闻爬虫",系统就自动生成了项目骨架代码,连import语句都帮忙写好了。点击右上角部署按钮,这个爬虫就直接生成可访问的API端点,能通过POST请求触发抓取任务并返回JSON结果。相比传统开发方式,省去了环境配置、服务器搭建等繁琐步骤,特别适合做技术预研和原型验证。这个工具特别适合做技术验证。整个过程比我预想的要顺畅很多,

最近在尝试用clawhub框架快速搭建网络爬虫原型时,发现InsCode(快马)平台这个工具特别适合做技术验证。整个过程比我预想的要顺畅很多,记录下这个十分钟搞定的爬虫demo经验。

-

环境准备零成本 传统方式需要先配Python环境、装依赖库,而快马平台直接内置了Python3和常用库。登录后新建Python项目,在AI对话框输入"基于clawhub的新浪科技新闻爬虫",系统就自动生成了项目骨架代码,连import语句都帮忙写好了。

-

智能补全核心逻辑 框架生成的基础代码包含:

- 爬虫类继承clawhub的BaseSpider

- 初始URL设置为新浪科技频道

- 基础的headers模拟浏览器访问

- 异常处理模块和日志配置

我只需要在parse方法里补充XPath提取规则,平台还会根据网页结构推荐选择器写法。比如获取新闻标题的路径,AI会提示可以用

//div[@class='news-title']/a/text()这样的表达式。 -

实时验证抓取效果 最实用的功能是内置的实时预览窗口,写完解析逻辑马上能看到抓取结果。我遇到两个典型问题:

- 部分标题带多余的空格和换行符

- 有些条目包含特殊字符

通过平台右侧的AI对话区,直接询问"如何清洗爬取的新闻文本",立即得到回复建议:

- 用strip()去除首尾空白

- 正则表达式替换连续空格

- html.unescape处理转义字符

-

数据持久化优化 原始方案直接用json.dump保存,AI建议增加:

- 按日期分文件存储

- 添加抓取时间戳

- 使用utf-8编码避免乱码 这些改进让输出文件更规范:

{ "source": "sina_tech", "crawl_time": "2023-08-20 14:30", "data": [ {"title": "AI大模型最新进展", "url": "..."}, ... ] } -

异常处理完善 通过平台模板自动生成的异常捕获模块已经包含:

- 网络请求超时重试

- 页面解析失败记录

- 反爬虫状态码处理 我额外添加了代理IP切换的备选方案,这些在真实爬虫场景都很关键。

整个流程体验下来,最惊喜的是部署环节。点击右上角部署按钮,这个爬虫就直接生成可访问的API端点,能通过POST请求触发抓取任务并返回JSON结果。对于需要快速验证爬虫可行性的场景,比本地跑脚本方便太多。

建议尝试这种开发模式:

- 在平台创建clawhub爬虫项目

- 修改目标网站和解析规则

- 实时调试数据清洗逻辑

- 一键部署为在线服务

相比传统开发方式,省去了环境配置、服务器搭建等繁琐步骤,特别适合做技术预研和原型验证。下次准备试试用这个方案快速验证不同网站的反爬机制。

更多推荐

已为社区贡献46条内容

已为社区贡献46条内容

所有评论(0)