无需令牌调用AI:在快马平台快速构建openclaw-zero-token技术原型

最近在研究如何降低AI应用开发门槛时,发现openclaw-zero-token这个技术很有意思。它最大的特点就是不需要传统API令牌就能调用开源模型,特别适合快速验证想法。这种无门槛的体验特别适合技术验证阶段,不用操心运维问题就能获得真实可用的演示地址。对于想快速尝试AI应用开发的同行,推荐先用这个方案跑通核心流程,后续再考虑更复杂的企业级部署。这里有个实用技巧:在转发请求时添加了模型参数,可以

最近在研究如何降低AI应用开发门槛时,发现openclaw-zero-token这个技术很有意思。它最大的特点就是不需要传统API令牌就能调用开源模型,特别适合快速验证想法。刚好在InsCode(快马)平台上尝试做了一个原型,整个过程比想象中简单很多。

-

技术选型思路

这个原型需要解决两个核心问题:前端交互界面和模型调用。考虑到验证速度,我选择了最轻量级的方案:

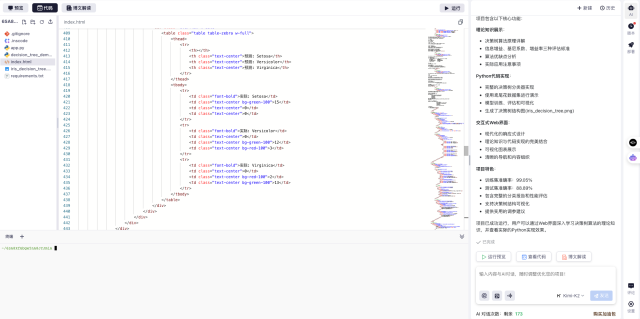

- 前端用纯HTML+CSS+JavaScript三件套

- 后端用Python的Flask框架做简单路由

- 模型调用直接对接Hugging Face的公共API端点

-

前端实现要点

界面设计遵循极简原则,主要包含三个功能区块:

- 标题区:用大字标明这是无令牌AI演示

- 输入区:文本域+提交按钮

- 输出区:带加载动画的结果展示框

交互逻辑特别注意了错误处理:

- 禁用按钮防止重复提交

- 网络请求超时设置为15秒

- 对空输入进行前端校验

-

后端关键逻辑

Flask服务主要做三件事:

- 接收前端POST请求

- 将用户输入转发到Hugging Face的API

- 把模型响应返回给前端

这里有个实用技巧:在转发请求时添加了模型参数,可以指定使用哪些开源模型(如GPT-2、Bloom等),方便对比不同模型的效果。

-

无令牌调用方案

openclaw-zero-token的核心在于利用公共服务:

- 直接调用Hugging Face提供的inference端点

- 通过模型仓库的公开API路径访问

- 完全省去了申请令牌、配置鉴权的步骤

虽然这类公共服务可能有速率限制,但对于原型验证完全够用。

-

实际开发中的经验

在快马平台实现时发现几个便利点:

- 内置的代码编辑器可以直接调试前后端

- 环境依赖自动配置,不用折腾Python包管理

- 实时预览功能随时查看界面效果

遇到的主要问题是网络延迟,解决方案是:

- 在前端添加请求超时提示

- 后端设置合理的HTTP超时参数

- 对长文本自动拆分分批处理

-

效果优化方向

目前基础版本跑通后,可以进一步扩展:

- 添加模型选择下拉框

- 增加历史记录功能

- 支持Markdown格式输出

- 加入简单的对话上下文

整个开发过程最惊喜的是部署环节。在InsCode(快马)平台上写完代码后,只需要点击一个按钮,系统就自动完成了:

- 服务器环境配置

- 依赖安装

- 服务启动

- 生成可访问的URL

这种无门槛的体验特别适合技术验证阶段,不用操心运维问题就能获得真实可用的演示地址。对于想快速尝试AI应用开发的同行,推荐先用这个方案跑通核心流程,后续再考虑更复杂的企业级部署。

更多推荐

已为社区贡献44条内容

已为社区贡献44条内容

所有评论(0)