OpenClaw+百川2-13B自动化写作:从资料收集到Markdown生成全流程

本文介绍了如何在星图GPU平台上自动化部署百川2-13B-对话模型-4bits量化版 WebUI v1.0镜像,实现从资料收集到Markdown生成的全流程自动化写作。该方案特别适合技术内容创作者,能快速整理技术文档并生成结构完整的文章草稿,显著提升写作效率。

OpenClaw+百川2-13B自动化写作:从资料收集到Markdown生成全流程

1. 为什么需要自动化写作助手

作为一个技术内容创作者,我经常面临这样的困境:明明有大量技术观点想要表达,却总被繁琐的资料收集、格式调整和排版工作消耗精力。直到发现OpenClaw可以搭配本地部署的百川2-13B模型实现全流程自动化,我的写作效率才真正发生了质变。

这个组合最吸引我的特点是闭环处理能力——从打开浏览器检索最新技术文档,到整理关键信息,再到生成结构完整的Markdown草稿,整个过程无需人工干预。上周我测试用这个方案完成一篇关于微服务架构的文章,传统方式需要3小时的工作量,最终只用了47分钟就完成了初稿。

2. 环境准备与模型对接

2.1 基础环境搭建

我选择在MacBook Pro(M1芯片,16GB内存)上部署整套方案。OpenClaw的安装出乎意料地简单:

curl -fsSL https://openclaw.ai/install.sh | bash

openclaw onboard --install-daemon

配置向导中选择Advanced模式,在模型提供商处填写本地部署的百川2-13B服务地址。我的模型通过星图平台部署在本地服务器,地址是http://192.168.1.100:5000/v1,这里有个小技巧:如果模型服务启用了API密钥验证,需要在~/.openclaw/openclaw.json中补充:

{

"models": {

"providers": {

"baichuan-local": {

"baseUrl": "http://192.168.1.100:5000/v1",

"apiKey": "your-api-key",

"api": "openai-completions",

"models": [

{

"id": "baichuan2-13b-chat",

"name": "Baichuan2-13B-Chat",

"contextWindow": 4096

}

]

}

}

}

}

2.2 模型特性适配

百川2-13B-4bits量化版在消费级GPU上表现优异,但需要注意两个特性:

- 响应速度:相比云端API,本地推理的首次响应时间较长(约15-20秒)

- 上下文限制:4096的上下文窗口需要合理控制输入信息量

我通过调整OpenClaw的chunk_size参数来解决这个问题,将长文档自动拆分为多个片段处理:

openclaw config set tasks.document.chunk_size 2000

3. 自动化写作全流程实现

3.1 任务拆解与技能组合

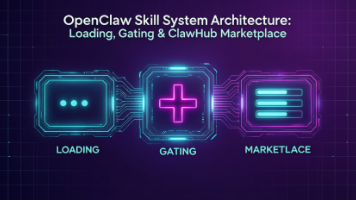

整个写作流程被设计为四个阶段,每个阶段对应不同的OpenClaw技能:

- 信息采集阶段:使用

web-researcher技能控制浏览器 - 内容提炼阶段:调用

text-summarizer处理网页内容 - 草稿生成阶段:通过

markdown-generator组织文章结构 - 成果保存阶段:利用

file-manager输出最终文件

安装这些技能只需要一条命令:

clawhub install web-researcher text-summarizer markdown-generator file-manager

3.2 实操案例:生成技术文章

当我需要写一篇关于"Rust并发编程"的文章时,只需向OpenClaw发送自然语言指令:

"请收集最近三个月Rust并发编程的最佳实践,整理出5个核心观点,生成包含代码示例的Markdown文章,保存到~/Documents/Rust-Concurrency.md"

系统会自动执行以下操作:

- 打开Chrome浏览器,搜索"Rust concurrency best practices 2024 site:github.com"

- 提取前5个相关页面的正文内容

- 调用百川模型总结关键知识点

- 生成包含目录、章节和示例代码的完整Markdown

- 在指定路径创建文件

3.3 异常处理机制

在实际运行中,我遇到过几种典型问题及解决方案:

问题1:网页结构识别错误

- 现象:技能误将页面广告识别为正文

- 解决:在

web-researcher配置中添加CSS选择器白名单

{

"skills": {

"web-researcher": {

"content_selectors": [".article-body", ".markdown-body"]

}

}

}

问题2:模型生成内容偏离主题

- 现象:文章包含无关的技术术语

- 解决:在指令中添加明确的负面提示词

"请避免讨论Tokio运行时细节,聚焦标准库的std::thread和std::sync"

问题3:文件权限错误

- 现象:无法保存到指定目录

- 解决:为OpenClaw授予完全磁盘访问权限(Mac系统设置→隐私与安全性)

4. 效果评估与优化建议

经过两周的持续使用,这个方案已经帮我产出了7篇技术博客。与纯人工写作相比,自动化方案展现出三个明显优势:

- 信息时效性:能自动获取最新社区讨论和GitHub提交,避免引用过时的方案

- 格式一致性:生成的Markdown完美适配我的博客引擎,省去格式调整时间

- 灵感激发:模型有时会提出意想不到的技术观点组合

但也存在需要人工干预的环节:

- 技术准确性核查(特别是代码示例)

- 个人写作风格的强化(添加更多口语化表达)

- 引用的权威性验证

我的优化方案是在关键节点设置人工确认步骤。例如修改markdown-generator技能,在以下环节暂停执行:

- 文章大纲生成后

- 代码示例插入前

- 最终保存前

这可以通过在技能配置中添加pause_points实现:

{

"skills": {

"markdown-generator": {

"pause_points": ["outline", "code_block", "before_save"]

}

}

}

5. 个人实践心得

自动化写作最大的价值不在于完全替代人工,而是把创作者从重复劳动中解放出来。在使用OpenClaw+百川2-13B的这一个月里,我总结出三条实用建议:

保持适度参与:完全自动化生成的内容缺乏个性,最佳模式是人机协作。我会在模型生成大纲后,手动调整章节顺序并添加个人案例。

建立知识库:为OpenClaw配置专属文件夹存放常用参考资料(我的在~/OpenClaw/knowledge_base),模型在写作时会优先参考这些经过验证的内容。

分层级使用:简单资讯类文章可以90%自动化,核心技术文章则采用"模型生成→人工改写"的两段式流程。不同重要程度的内容适合不同的自动化程度。

这套方案特别适合独立开发者和技术博主,它能将写作过程中的机械性工作压缩到最低限度,让我们更专注于内容本身的价值创造。现在我的写作流程已经从"收集-写作-排版"变成了"审核-优化-发布",效率提升的同时质量反而更加稳定。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)