新手福音:依托快马平台与重启的openclaw轻松迈出网络爬虫第一步

不用配环境,打开网页就能写代码,写完直接运行看结果。最方便的是可以一键部署成长期运行的爬虫服务,自动保存抓取结果。对新手来说,这种即时反馈的学习方式效率很高,遇到问题还能随时调整代码重新运行。只需要传入目标URL,它会自动处理请求头和编码问题。比如要抓取新闻列表页,直接调用这个函数就能拿到完整的HTML。最简单的就是写入txt文件,用Python内置的open函数配合write方法就能实现。ope

最近在学Python爬虫,发现openclaw这个库重启后变得更友好了。作为一个刚入门的新手,我想分享下如何用这个库配合InsCode(快马)平台快速搭建第一个爬虫项目。

-

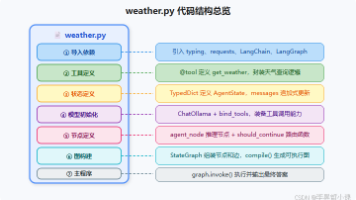

准备工作 首先需要理解爬虫的基本流程:发送请求→获取网页→解析内容→存储数据。openclaw库封装了这些常用功能,比直接使用requests+BeautifulSoup更简洁。

-

发送HTTP请求 用openclaw的fetch_page函数可以直接获取网页内容。只需要传入目标URL,它会自动处理请求头和编码问题。比如要抓取新闻列表页,直接调用这个函数就能拿到完整的HTML。

-

解析HTML内容 拿到网页后,用extract_elements函数提取特定元素。比如要获取所有文章标题,可以通过CSS选择器指定标题所在的标签(如h2.title)。这个函数会返回匹配的元素列表。

-

数据存储 处理完的数据可以保存到本地。最简单的就是写入txt文件,用Python内置的open函数配合write方法就能实现。建议每行存储一条数据,方便后续查看。

-

异常处理 新手容易忽略网络请求失败的情况。openclaw提供了自动重试机制,但最好还是用try-except捕获异常,比如连接超时或页面不存在时给出提示。

实际开发时我发现几个实用技巧:

- 先用浏览器开发者工具查看目标元素的HTML结构

- 测试时可以先打印提取的内容,确认无误再保存

- 适当添加time.sleep避免请求过于频繁

遇到的主要问题及解决方法:

- 元素选择器写错导致提取不到数据 → 先用浏览器检查元素,确保选择器路径正确

- 网站有反爬机制导致403错误 → 添加User-Agent头模拟浏览器访问

- 中文内容保存后乱码 → 指定文件编码为utf-8

整个过程在InsCode(快马)平台上特别顺畅。不用配环境,打开网页就能写代码,写完直接运行看结果。最方便的是可以一键部署成长期运行的爬虫服务,自动保存抓取结果。对新手来说,这种即时反馈的学习方式效率很高,遇到问题还能随时调整代码重新运行。

更多推荐

已为社区贡献41条内容

已为社区贡献41条内容

所有评论(0)