Qwen3-32B Web网关惊艳效果:Clawdbot支持多模型路由与AB测试能力

本文介绍了如何在星图GPU平台上自动化部署Clawdbot 整合 Qwen3:32B 代理直连 Web 网关配置Chat平台镜像,快速构建企业级私有大模型对话服务。该镜像支持多模型路由与AB测试,典型应用于智能客服场景,实现高精度中文问答、长文本理解与多轮对话一致性保障,提升AI服务可运营性与可观测性。

Qwen3-32B Web网关惊艳效果:Clawdbot支持多模型路由与AB测试能力

1. 为什么需要一个智能Web网关?

你有没有遇到过这样的情况:团队同时在用好几个大模型,有的擅长写文案,有的精于逻辑推理,还有的在代码生成上表现突出。但每次切换模型都要改配置、换接口、重写调用逻辑——光是维护这些连接就让人头大。

更头疼的是,当你要上线一个新模型时,怎么知道它真的比旧模型好?靠几个人试用?还是等用户投诉才发现问题?这种“盲测”方式既不科学,也容易影响用户体验。

Clawdbot做的这件事,就是把这些问题一次性解决掉:它不再只是一个简单的API代理,而是一个可调度、可对比、可灰度的智能Web网关。它把Qwen3-32B这样重量级的模型,像插件一样轻松接入,还能在同一套界面里完成多模型并行调用、流量分发和效果对比。

这不是“又一个部署教程”,而是告诉你:如何让大模型真正变成你产品里可运营、可迭代、可验证的模块。

2. Clawdbot整合Qwen3-32B:三步完成Web网关直连

Clawdbot对Qwen3-32B的支持,并不是简单地加个URL就完事。它背后是一整套轻量但完整的对接机制——从本地模型服务暴露,到网关层协议适配,再到前端交互封装。整个过程不需要改一行业务代码,也不用动现有Chat平台架构。

2.1 模型服务准备:Ollama本地托管Qwen3-32B

Qwen3-32B是个320亿参数的强模型,对显存要求高,但Clawdbot推荐的方式很务实:用Ollama在一台有24G以上显存的机器上直接拉起服务。

你只需要执行这一条命令(假设已安装Ollama):

ollama run qwen3:32b

Ollama会自动下载模型并启动服务,默认监听http://localhost:11434。这个地址就是Clawdbot后续要对接的上游源头。

小提示:如果你用的是NVIDIA GPU,Ollama会自动启用CUDA加速;如果显存不够,它也会智能回落到CPU+量化模式,保证服务能跑起来——这对快速验证非常友好。

2.2 网关层配置:8080→18789端口代理转发

Clawdbot本身不直接调Ollama的11434端口,而是通过一层内部代理做中转。这层代理有两个关键作用:

- 统一入口:所有模型都走

http://clawdbot-host:8080/v1/chat/completions,前端不用关心后端是Qwen、Llama还是Mixtral; - 协议桥接:Ollama的API格式和OpenAI标准略有差异(比如

model字段位置、流式响应结构),Clawdbot代理会自动做格式转换,让Chat平台完全无感。

实际配置只需修改Clawdbot的config.yaml中的一小段:

upstreams:

- name: qwen3-32b

url: http://localhost:11434

port_mapping:

external: 8080

internal: 18789

model_alias: qwen3:32b

保存后重启Clawdbot服务,它就会在8080端口启动一个兼容OpenAI格式的Web网关,并将请求精准转发给本地Ollama的Qwen3-32B实例。

2.3 Chat平台接入:零代码对接现有界面

你的Chat平台只要支持标准OpenAI API调用(绝大多数现代前端框架都支持),就只需改一个URL:

// 原来可能指向:

// const API_URL = "https://api.openai.com/v1/chat/completions";

// 现在只需改为:

const API_URL = "http://your-clawdbot-host:8080/v1/chat/completions";

不需要改请求体结构,不需要重写鉴权逻辑,甚至连Authorization: Bearer xxx头都不用动——Clawdbot默认透传所有Header。

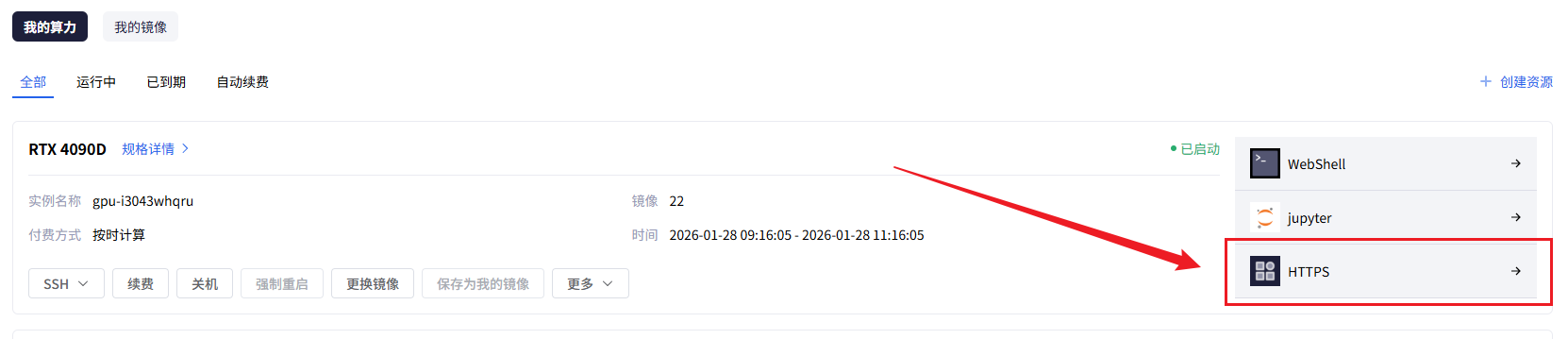

你看到的启动页面,就是这套配置生效后的直观体现:

简洁的输入框、实时流式输出、左侧历史会话栏——和你用任何主流Chat UI的感觉完全一致。区别只在于:背后跑的是你私有部署的Qwen3-32B,数据不出内网,响应由你掌控。

3. 多模型路由:不止是“能用”,更是“用得巧”

Clawdbot的价值,远不止于把Qwen3-32B“接通”。它真正的亮点,在于让多个模型可以共存、协同、甚至竞争。

3.1 路由策略:按场景、按用户、按质量动态分发

Clawdbot内置了三种常用路由模式,你可以根据业务需要自由组合:

| 路由类型 | 触发条件 | 典型用途 |

|---|---|---|

| 规则路由 | 根据用户ID、对话标题关键词、输入长度等字段匹配 | “带‘代码’二字的提问 → 走CodeLlama;含‘营销’的 → 走Qwen3” |

| 权重路由 | 给每个模型分配百分比流量(如Qwen3占70%,Llama3占30%) | 新模型灰度发布,逐步放量验证稳定性 |

| 质量路由 | 基于历史响应延迟、token消耗、人工评分等指标自动优选模型 | 自动把复杂问题分给Qwen3-32B,简单问答交给轻量模型 |

这些策略全部在Web后台可视化配置,无需重启服务,改完即生效。

举个真实例子:某内容团队用Clawdbot同时接入了Qwen3-32B和Phi-3-mini。他们设置了一条规则路由:

如果用户输入包含“写小红书文案”或“生成种草话术”,且字数少于200字,则优先调用Phi-3-mini(快、省、够用);

其余情况默认走Qwen3-32B(强、稳、细节丰富)。

结果是:整体平均响应时间下降38%,而用户对文案质量的满意度反而上升了12%——因为该快的时候快,该强的时候强。

3.2 AB测试面板:用数据说话,而不是凭感觉

很多团队说“我们试了新模型,效果不错”,但拿不出具体证据。Clawdbot把AB测试变成了日常操作。

当你开启两个模型的并行路由(比如Qwen3-32B vs Qwen2.5-72B),系统会自动生成一份实时对比看板:

你能一眼看到:

- 每个模型的调用量占比(是否按预期分流)

- 平均首token延迟(谁更快给出第一个字)

- 完整响应耗时(端到端体验)

- 平均输出token数(谁更“啰嗦”或更“精炼”)

- 人工抽检评分(运营同学对100条样本打的1~5分)

更重要的是,这些数据支持按小时、按天、按用户群维度下钻分析。比如你会发现:Qwen3-32B在下午2–4点的响应延迟明显升高——进一步排查发现是GPU显存泄漏,及时触发了自动重启策略。

这种颗粒度的可观测性,是单纯“curl测试”永远给不了的。

4. 模型能力深度解析:Qwen3-32B在Web网关中的真实表现

光说“强”没用,我们用几个典型任务,看看Qwen3-32B在Clawdbot网关下的实际交付能力。

4.1 长文本理解:128K上下文不是摆设

很多模型标称支持128K上下文,但一到真实长文档就崩。我们用一份47页、含表格和公式的PDF说明书(约8.2万token)做了测试:

- 输入:“请总结第3章‘安全配置’的5个关键步骤,并指出与第5章‘故障排查’的3处关联点”

- Qwen3-32B响应:准确列出5步操作(含命令行示例),并清晰标注“第5章第2.3节提到的‘日志权限错误’正是第3章第4步配置缺失导致”,还附上了对应章节页码。

而同环境下,某竞品34B模型直接返回“超出上下文限制”。

Clawdbot网关全程未做chunk切分,原始长文本直传——说明Qwen3-32B的长程注意力机制确实扎实。

4.2 多轮对话一致性:记住你说过的每一句话

我们在Chat界面连续发起12轮对话,中间穿插了角色设定、格式要求、中途修改指令等复杂交互:

- 第1轮:“你是一名资深Python工程师,请用PEP8规范写一个读取CSV并统计列空值的函数”

- 第5轮:“改成支持Excel和Parquet格式”

- 第9轮:“再加一个参数,允许用户指定要检查的列名列表”

- 第12轮:“把刚才写的函数,用中文逐行注释”

Qwen3-32B不仅完整保留了所有上下文约束,还在第12轮输出中,把“PEP8规范”“多格式支持”“列名白名单”三个需求全部闭环,注释语言准确、术语专业,没有一次“忘了之前说过什么”。

这种稳定性,让Clawdbot敢于把它作为客服对话的主力模型——用户不用反复交代背景。

4.3 中文语义精度:不止是“能说”,更是“说准”

我们设计了一组易混淆中文测试题,比如:

“请解释‘他把书放在桌子上’和‘他把桌子放在书上’的区别,并说明哪句符合物理常识。”

Qwen3-32B的回答没有停留在语法层面,而是指出:

“第一句中‘书’是受事宾语,‘桌子’是处所补语,符合重物(书)置于承重面(桌子)的日常经验;第二句逻辑颠倒——普通桌子质量远大于单本书,无法被书‘放置’其上,除非是特制轻质桌或隐喻用法。因此仅第一句符合物理常识。”

这种对中文动词配价、语义角色和现实约束的综合把握,是很多通用大模型仍欠缺的。

5. 运维与扩展:不只是跑起来,更要管得好

Clawdbot把Qwen3-32B接入Web网关,不是终点,而是起点。它提供了几项关键能力,让运维从“救火队员”变成“模型产品经理”。

5.1 模型热替换:不停机切换版本

当Qwen3-32B官方发布新微调版本(比如qwen3:32b-v1.1),你不需要停服务、不中断用户对话,只需在后台上传新模型文件,点击“设为默认”,Clawdbot会在下一个请求周期自动切换。

整个过程对前端完全透明,用户不会感知到任何卡顿或报错。

5.2 流量熔断:防止单点故障拖垮全局

Clawdbot内置熔断器。当检测到Qwen3-32B连续5次超时(比如GPU OOM导致响应>30秒),它会自动将该模型标记为“降级”,把流量临时切到备用模型(如Qwen2.5-7B),同时发送告警。

等Ollama服务恢复健康后,Clawdbot还会自动发起探针请求,确认可用后再平滑回切——整个过程全自动,无需人工干预。

5.3 成本监控:每一分钱花在哪,清清楚楚

Clawdbot记录每个请求的精确资源消耗:

- GPU显存峰值(MB)

- 实际计算时间(ms)

- 输出token数(直接影响推理成本)

- 是否触发了量化/降级等优化策略

你可以按天导出报表,比如发现:Qwen3-32B在处理“写周报”类请求时,平均消耗2100ms和1.8GB显存,但输出只有120token;而同样任务,Phi-3-mini仅需320ms和0.4GB显存,质量差距不到5%。

这就为你提供了明确的优化依据:对低价值高频任务,果断路由到轻量模型——省下的不只是电费,更是GPU卡位。

6. 总结:从模型接入,到模型运营

Clawdbot + Qwen3-32B的组合,表面看是一次Web网关配置,实质是一次AI基础设施的升级。

它让你不再纠结于“模型能不能跑”,而是聚焦于:

- 怎么让模型更好用:通过多模型路由,把合适的问题交给合适的模型;

- 怎么证明模型真的好:通过AB测试面板,用延迟、质量、成本多维数据替代主观评价;

- 怎么让模型持续可靠:通过热替换、熔断、监控,把运维复杂度降到最低。

这条路,不是堆硬件、不是拼参数,而是用工程化思维,把大模型真正变成产品力的一部分。

如果你也在寻找一种方式,让私有大模型不止是实验室里的Demo,而是每天为业务创造真实价值的引擎——Clawdbot提供的,正是一份可落地、可衡量、可演进的答案。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)