中小企业AI提效方案:Qwen3-VL:30B私有化部署打造专属飞书智能办公助手

本文介绍了如何在星图GPU平台上自动化部署“星图平台快速搭建 Clawdbot:私有化本地 Qwen3-VL:30B 并接入飞书(上篇)”镜像,快速构建私有化多模态AI助手。该方案支持中小企业零代码部署,实现图片内容分析、数据报表解读等智能办公场景,所有数据处理均在本地完成,保障数据安全与隐私。

中小企业AI提效方案:Qwen3-VL:30B私有化部署打造专属飞书智能办公助手

1. 项目概述:零基础搭建智能办公助手

现在很多中小企业都在寻找用AI提升办公效率的方法,但面临两个难题:一是技术门槛高,自己部署大模型太难;二是数据安全顾虑,不想把内部资料传到公有云。今天我要分享的方案,正好能解决这两个痛点。

通过CSDN星图AI云平台,我们可以用最简单的方式,私有化部署目前最强的多模态大模型Qwen3-VL:30B,再通过Clawdbot搭建一个既能"看图"又能"聊天"的飞书智能办公助手。整个过程就像搭积木一样简单,不需要深厚的技术背景。

这个方案有什么实际价值呢?想象一下:你的团队可以直接在飞书群里上传一张产品设计图,AI助手就能帮你分析设计亮点;或者发一张数据报表,它能立即解读关键指标;甚至还能处理日常的文档问答、会议纪要整理等工作。所有数据都在自己的服务器上处理,完全不用担心隐私泄露。

实验说明:本文所有的部署及测试环境均由 CSDN星图AI 云平台提供。我们使用官方预装的Qwen3-VL-30B镜像作为基础环境进行二次开发。

硬件环境概览

| GPU驱动 | CUDA版本 | 显存 | CPU | 内存 | 系统盘 | 数据盘 |

|---|---|---|---|---|---|---|

| 550.90.07 | 12.4 | 48GB | 20核心 | 240GB | 50GB | 40GB |

2. 基础环境搭建与测试

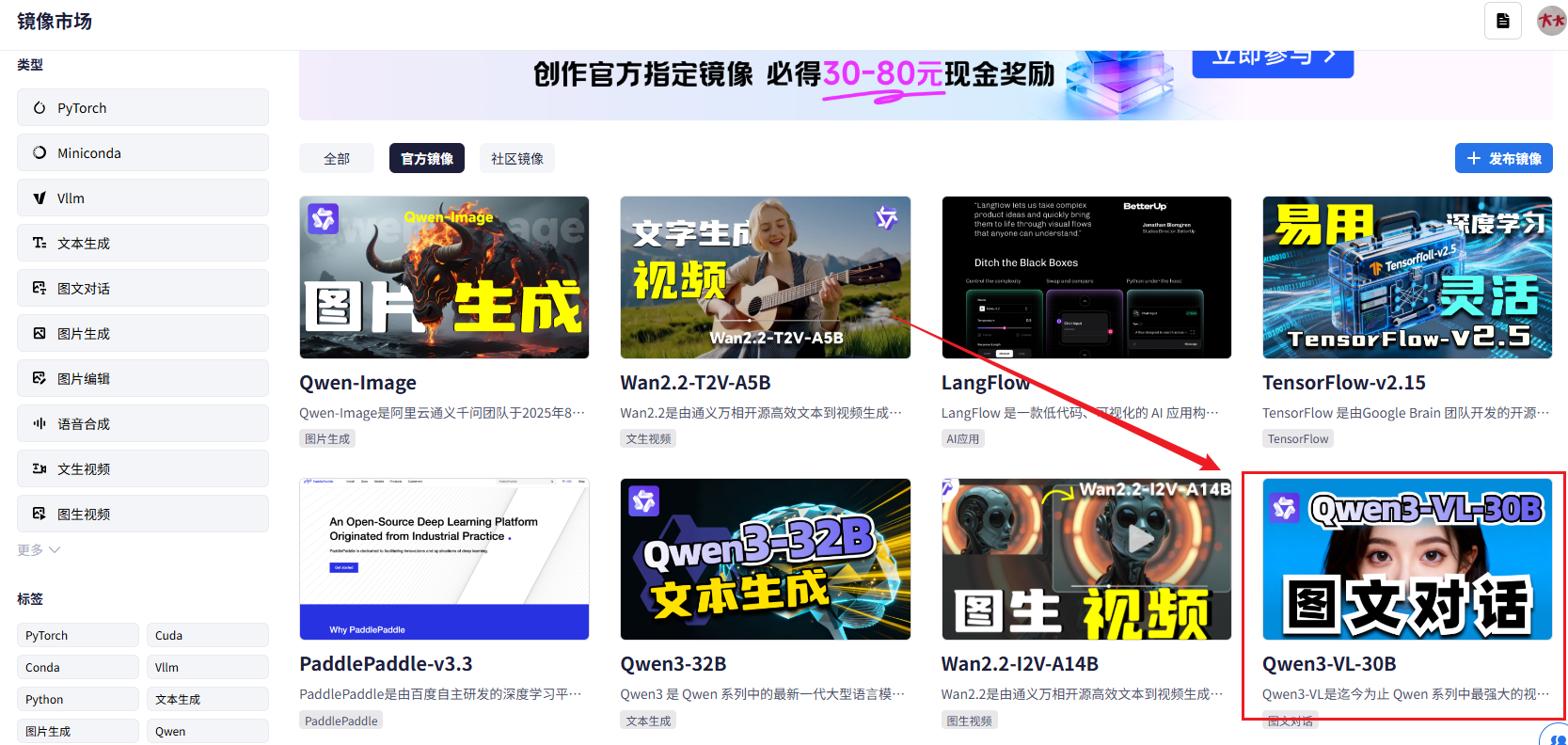

2.1 选择并部署Qwen3-VL:30B镜像

在星图平台上找到合适的镜像很简单。进入镜像市场后,直接搜索"Qwen3-vl:30b"就能快速定位到我们需要的基础镜像。

Qwen3-VL-30B是个大家伙,对硬件要求比较高。官方推荐配置是48G显存,好在星图平台已经帮我们做好了优化。创建实例时,直接使用默认推荐的配置就行,不需要自己调整参数。

2.2 验证模型可用性

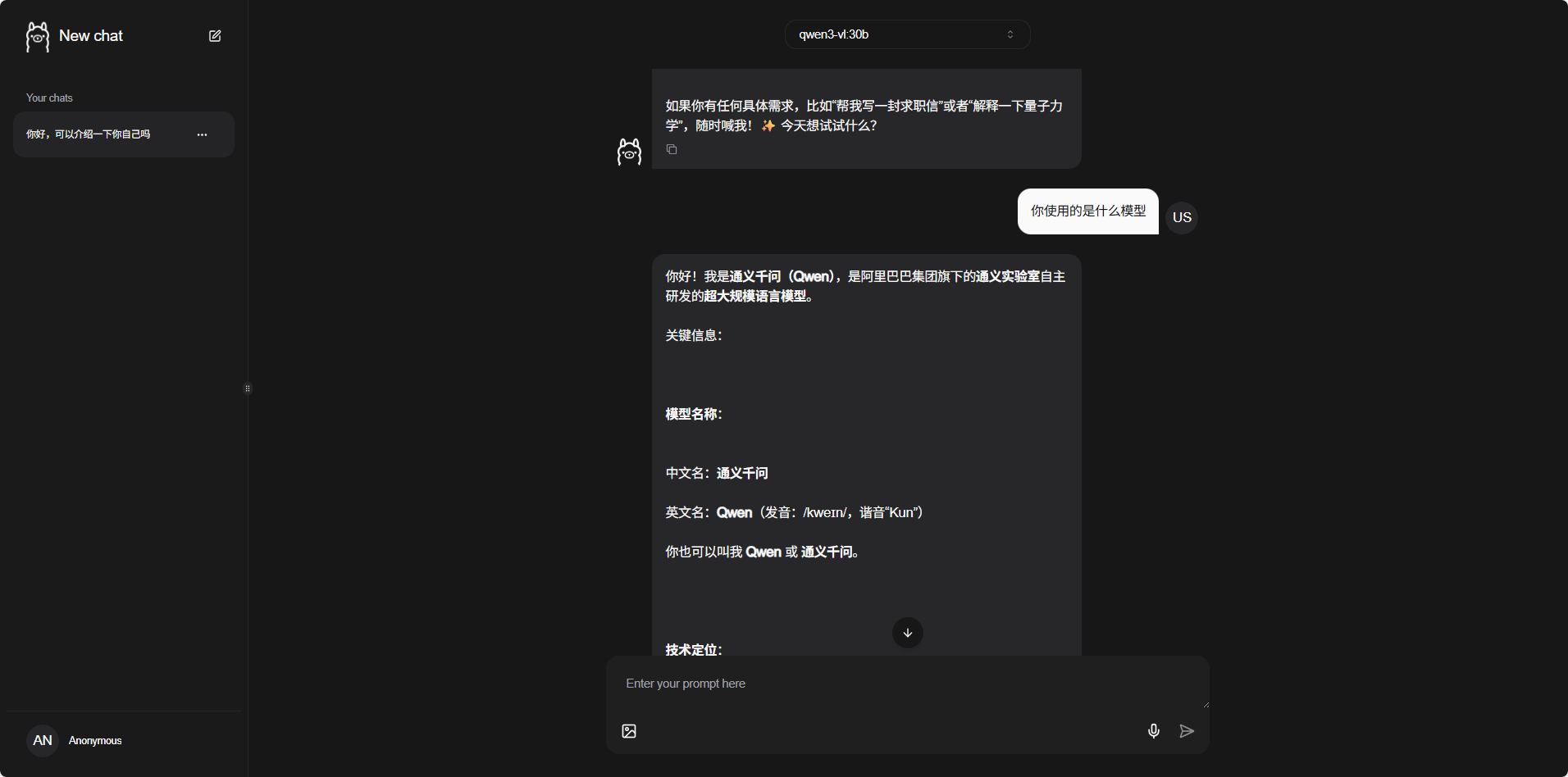

实例启动后,我们需要确认模型是否正常工作。最简单的方法是通过平台提供的Ollama控制台进行测试。

点击控制台上的"Ollama控制台"快捷方式,就能进入预装好的Web交互界面。在这里可以直接和模型对话,看看它能不能正确理解和回应。

除了网页测试,我们还需要确认API接口是否正常。星图云为每个算力实例提供了公网访问地址,我们可以用Python代码测试连接:

from openai import OpenAI

client = OpenAI(

# 替换成您实际的服务器地址

base_url="https://gpu-pod697b0f1855ba5839425df6ea-11434.web.gpu.csdn.net/v1",

api_key="ollama"

)

try:

response = client.chat.completions.create(

model="qwen3-vl:30b",

messages=[{"role": "user", "content": "你好,介绍一下你自己"}]

)

print(response.choices[0].message.content)

except Exception as e:

print(f"连接失败,请检查网络配置: {e}")

这段代码会向模型发送一个简单的问候,如果一切正常,你会收到模型的自我介绍回复。

3. Clawdbot安装与配置

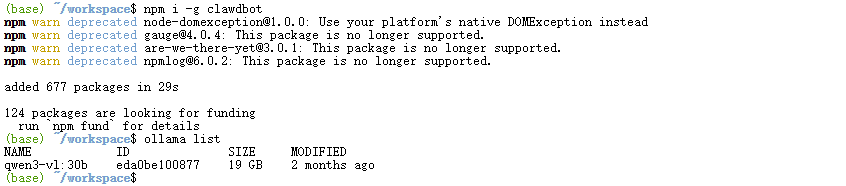

3.1 安装Clawdbot

Clawdbot是我们连接飞书和Qwen3模型的关键桥梁。好在星图环境已经预装了Node.js和必要的依赖,安装过程很简单:

npm i -g clawdbot

安装完成后,我们通过向导模式进行初始配置:

clawdbot onboard

这个向导会引导我们完成基本设置。对于大多数选项,我们可以先选择跳过,后续在Web控制面板中详细配置。

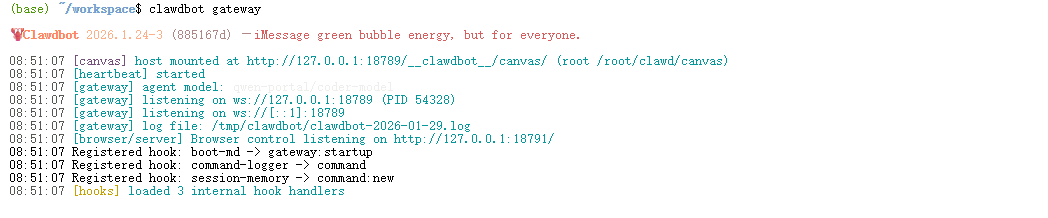

3.2 启动控制面板

Clawdbot默认使用18789端口提供管理界面。启动网关服务:

clawdbot gateway

然后通过浏览器访问控制面板,地址格式如下:

https://您的实例地址-18789.web.gpu.csdn.net/

4. 网络与安全配置

4.1 解决访问问题

刚开始可能会遇到页面空白的问题,这通常是因为Clawdbot默认只监听本地地址。我们需要修改配置文件允许外部访问:

vim ~/.clawdbot/clawdbot.json

找到gateway配置段,做如下修改:

"gateway": {

"mode": "local",

"bind": "lan", // 改为lan允许全网访问

"port": 18789,

"auth": {

"mode": "token",

"token": "csdn" // 设置访问令牌

},

"trustedProxies": ["0.0.0.0/0"], // 信任所有代理

"controlUi": {

"enabled": true,

"allowInsecureAuth": true

}

}

修改后重启服务,应该就能正常访问了。

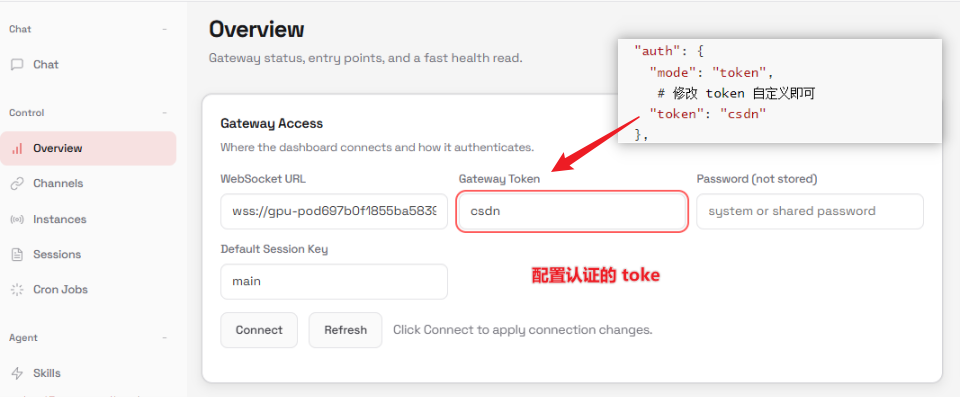

4.2 设置访问凭证

刷新页面后,系统会要求输入访问令牌。输入刚才设置的"csdn"就能进入管理界面。

5. 集成Qwen3-VL:30B模型

5.1 配置模型连接

现在来到最关键的一步:让Clawdbot使用我们部署的Qwen3模型。还是编辑刚才的配置文件:

"models": {

"providers": {

"my-ollama": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "ollama",

"api": "openai-completions",

"models": [

{

"id": "qwen3-vl:30b",

"name": "Local Qwen3 30B",

"contextWindow": 32000

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "my-ollama/qwen3-vl:30b"

}

}

}

这样配置后,Clawdbot就会使用本地的Qwen3模型来处理请求。

5.2 测试模型集成

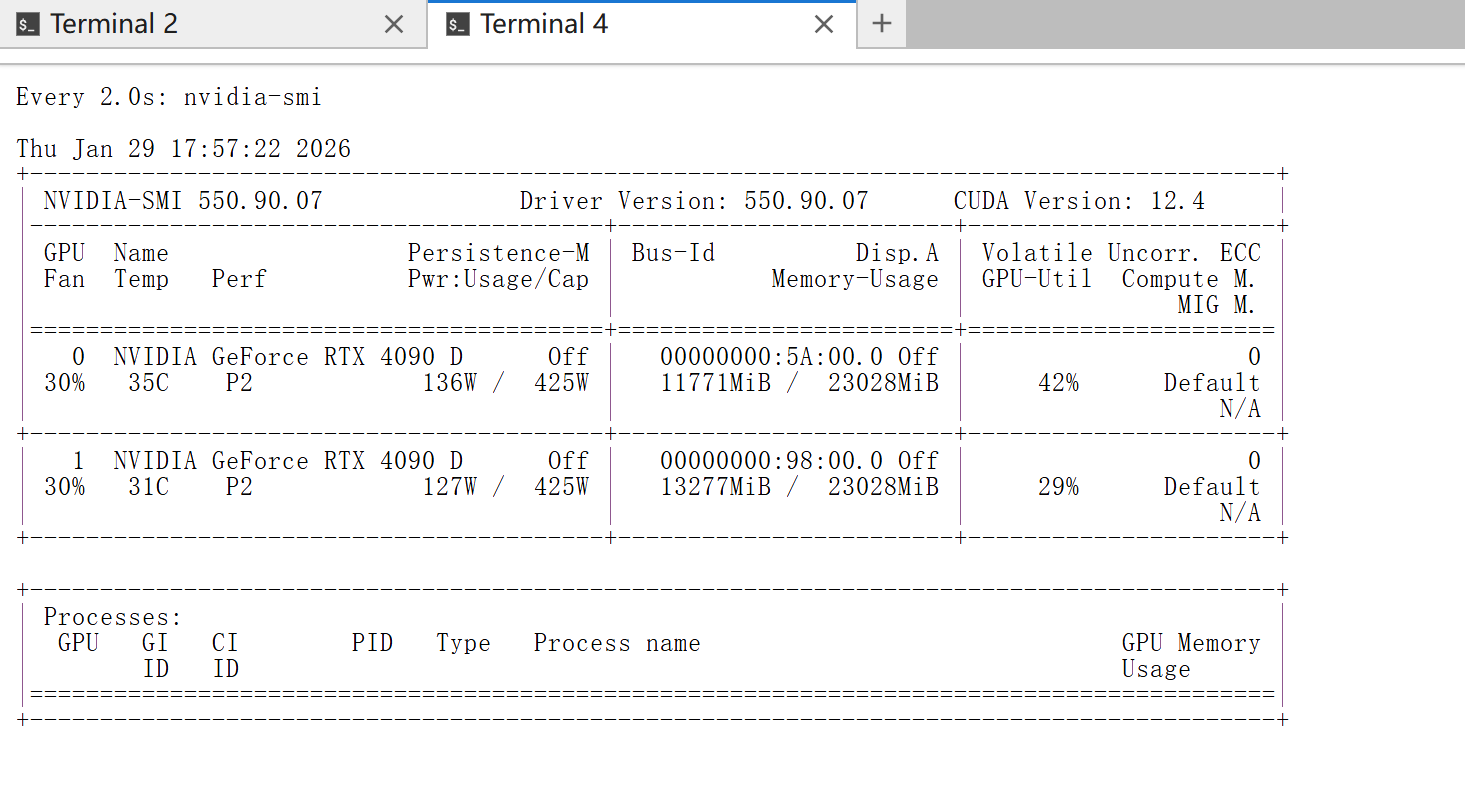

配置完成后,重启Clawdbot服务。为了确认模型真的在工作,我们可以打开一个新终端监控GPU状态:

watch nvidia-smi

然后在控制面板的Chat页面发送消息,观察GPU显存的使用变化。如果看到显存占用增加,说明模型正在正常工作。

现在你可以尝试发送一些多模态请求,比如上传图片并提问,体验Qwen3-VL:30B强大的图文理解能力。

6. 总结与下一步

到这里,我们已经成功在星图平台上完成了Qwen3-VL:30B的私有化部署,并通过Clawdbot搭建了管理网关。现在你拥有了一個强大的多模态AI助手,它能够:

- 理解图片内容并回答问题

- 处理复杂的文档分析任务

- 进行自然流畅的对话交流

- 所有数据处理都在本地完成,确保安全隐私

最重要的是,整个过程完全零基础友好,不需要深入了解深度学习或模型部署的复杂技术细节。

在下一篇文章中,我们将继续完成这个项目的最后一步:将整个环境接入飞书平台,实现真正的智能办公助手。我会详细讲解:

- 如何在飞书创建应用和配置权限

- 如何将Clawdbot与飞书进行对接

- 如何进行环境打包和持久化部署

- 实际办公场景中的使用技巧和最佳实践

期待在下一篇文章中继续与你分享如何让这个AI助手真正为你的团队创造价值。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)