Qwen3-32B部署实战:Clawdbot网关配置支持模型服务熔断与降级策略

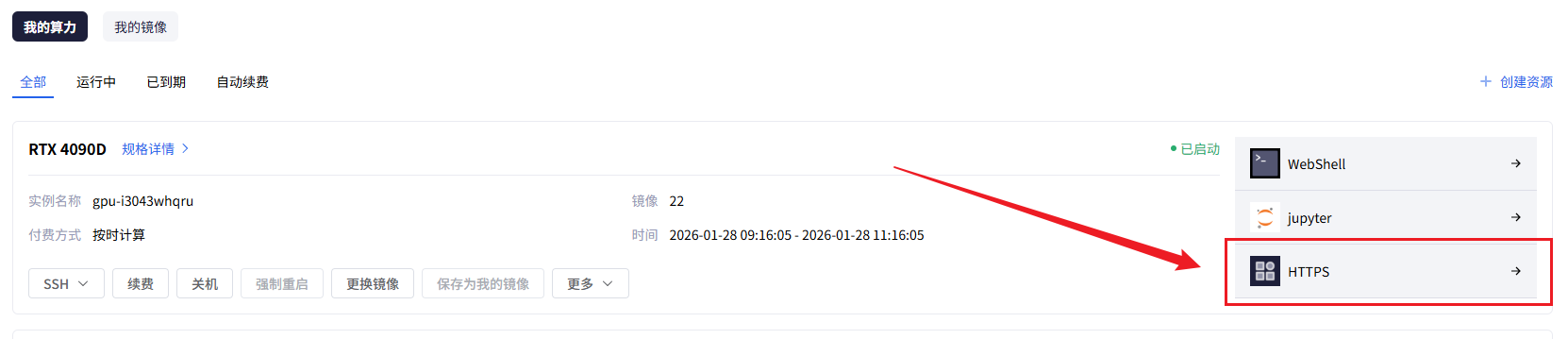

本文介绍了如何在星图GPU平台上自动化部署Clawdbot整合Qwen3:32B代理直连Web网关配置Chat平台镜像,实现大语言模型服务的高可用性。该方案通过配置熔断与降级策略,确保在企业AI助手等高并发场景下,当服务异常时能自动切换至备用方案,保障核心业务连续性。

Qwen3-32B部署实战:Clawdbot网关配置支持模型服务熔断与降级策略

本文将详细介绍如何通过Clawdbot网关整合私有部署的Qwen3-32B大模型,实现服务熔断与降级策略,确保AI服务的高可用性和稳定性。

1. 项目背景与价值

在实际企业应用中,大模型服务的稳定性和可用性至关重要。当Qwen3-32B模型服务出现异常或高负载时,如果没有适当的保护机制,可能会导致整个系统崩溃。通过Clawdbot网关配置熔断与降级策略,可以在服务异常时自动切换到备用方案或返回友好提示,保证核心业务的连续性。

这种方案特别适合:

- 企业内部AI助手平台

- 高并发场景下的模型服务

- 对服务稳定性要求较高的生产环境

2. 环境准备与组件介绍

2.1 核心组件说明

Qwen3-32B模型:阿里通义千问发布的大语言模型,32B参数规模,提供强大的自然语言处理能力。

Ollama:本地大模型部署和管理工具,提供标准化的API接口,简化模型调用。

Clawdbot网关:智能代理网关,负责请求路由、负载均衡和熔断降级策略实施。

2.2 网络架构概览

整个系统的网络流向如下:

- 用户请求通过Web界面发送到Clawdbot网关

- 网关通过内部代理将请求转发到Ollama服务(8080端口)

- Ollama调用本地部署的Qwen3-32B模型

- 响应结果按原路返回给用户

3. 详细部署步骤

3.1 Ollama服务部署

首先确保Ollama服务正常运行并加载Qwen3-32B模型:

# 拉取Qwen3-32B模型

ollama pull qwen3:32b

# 启动Ollama服务

ollama serve

验证服务是否正常:

curl http://localhost:11434/api/chat -d '{

"model": "qwen3:32b",

"messages": [

{"role": "user", "content": "你好"}

]

}'

3.2 Clawdbot网关配置

配置Clawdbot网关连接Ollama服务:

# clawdbot-config.yaml

services:

- name: "qwen3-32b-service"

url: "http://localhost:8080" # 内部代理转发的地址

timeout: 30000

circuit_breaker:

enabled: true

failure_threshold: 5

reset_timeout: 60000

fallback:

enabled: true

response: "当前服务繁忙,请稍后再试"

启动Clawdbot网关:

clawdbot start --config clawdbot-config.yaml

3.3 端口转发配置

设置内部代理,将8080端口转发到Ollama的11434端口:

# 使用socat进行端口转发

socat TCP-LISTEN:8080,fork TCP:localhost:11434 &

# 或者使用nginx反向代理

# nginx配置示例

server {

listen 8080;

location / {

proxy_pass http://localhost:11434;

proxy_set_header Host $host;

}

}

3.4 熔断降级策略配置

3.4.1 熔断策略配置

熔断器在连续失败次数达到阈值时触发,暂时停止向故障服务发送请求:

circuit_breaker:

enabled: true

failure_threshold: 5 # 连续失败5次触发熔断

reset_timeout: 60000 # 60秒后尝试恢复

half_open_attempts: 3 # 半开状态下尝试3次

3.4.2 降级策略配置

当服务熔断或超时时,返回预设的降级响应:

fallback:

enabled: true

type: "static" # 静态响应

response: "模型服务暂时不可用,请稍后重试"

status_code: 503 # 服务不可用状态码

4. 完整配置示例

以下是一个完整的Clawdbot网关配置示例:

# 完整的clawdbot配置

version: "1.0"

gateway:

port: 18789

host: "0.0.0.0"

services:

- name: "qwen3-32b-ollama"

upstream:

url: "http://localhost:8080"

timeout: 30000

retry:

attempts: 3

delay: 1000

circuit_breaker:

enabled: true

failure_threshold: 5

reset_timeout: 60000

half_open_attempts: 3

fallback:

enabled: true

type: "static"

response: |

{

"error": "服务暂时不可用",

"message": "AI模型服务正在维护中,请稍后再试",

"retry_after": 60

}

status_code: 503

metrics:

enabled: true

prometheus_port: 9090

logging:

level: "info"

file: "/var/log/clawdbot/gateway.log"

5. 测试与验证

5.1 正常流程测试

测试网关正常工作时的响应:

curl -X POST http://localhost:18789/api/chat \

-H "Content-Type: application/json" \

-d '{

"model": "qwen3:32b",

"messages": [

{"role": "user", "content": "请介绍你自己"}

]

}'

5.2 熔断触发测试

模拟服务故障,触发熔断机制:

# 停止Ollama服务来模拟故障

systemctl stop ollama

# 连续发送请求触发熔断

for i in {1..6}; do

curl -X POST http://localhost:18789/api/chat \

-H "Content-Type: application/json" \

-d '{"model": "qwen3:32b", "messages": [{"role": "user", "content": "test"}]}'

echo ""

done

观察输出,前5次请求可能超时或报错,第6次开始应该返回降级响应。

5.3 服务恢复测试

恢复服务并验证自动恢复机制:

# 重启Ollama服务

systemctl start ollama

# 等待熔断器恢复(60秒后)

sleep 60

# 测试服务是否恢复正常

curl -X POST http://localhost:18789/api/chat \

-H "Content-Type: application/json" \

-d '{

"model": "qwen3:32b",

"messages": [

{"role": "user", "content": "服务恢复测试"}

]

}'

6. 监控与维护

6.1 监控指标

通过Prometheus监控网关状态:

# prometheus配置

scrape_configs:

- job_name: 'clawdbot'

static_configs:

- targets: ['localhost:9090']

关键监控指标:

clawdbot_requests_total:总请求数clawdbot_errors_total:错误请求数clawdbot_circuit_breaker_state:熔断器状态clawdbot_response_time_ms:响应时间

6.2 日志分析

查看网关日志了解系统状态:

tail -f /var/log/clawdbot/gateway.log

# 查看熔断事件

grep "circuit_breaker" /var/log/clawdbot/gateway.log

7. 常见问题与解决方案

7.1 端口冲突问题

如果端口被占用,修改配置使用其他端口:

gateway:

port: 18790 # 改为其他可用端口

7.2 连接超时问题

增加超时时间配置:

upstream:

timeout: 60000 # 超时时间改为60秒

7.3 内存不足问题

Qwen3-32B需要大量内存,确保系统有足够资源:

# 查看内存使用情况

free -h

# 如果内存不足,考虑使用模型量化版本

ollama pull qwen3:32b-q4_0

8. 总结

通过本文的部署方案,我们成功实现了:

- 高可用架构:通过Clawdbot网关提供稳定的模型服务接入

- 熔断保护:在服务异常时自动熔断,防止故障扩散

- 优雅降级:服务不可用时返回友好提示,提升用户体验

- 监控运维:完整的监控体系,便于问题发现和解决

这种方案不仅适用于Qwen3-32B模型,也可以推广到其他大模型服务的部署中,为企业级AI应用提供可靠的基础设施支持。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献31条内容

已为社区贡献31条内容

所有评论(0)