Qwen3-32B私有部署关键路径:Clawdbot代理转发+18789网关配置一文详解

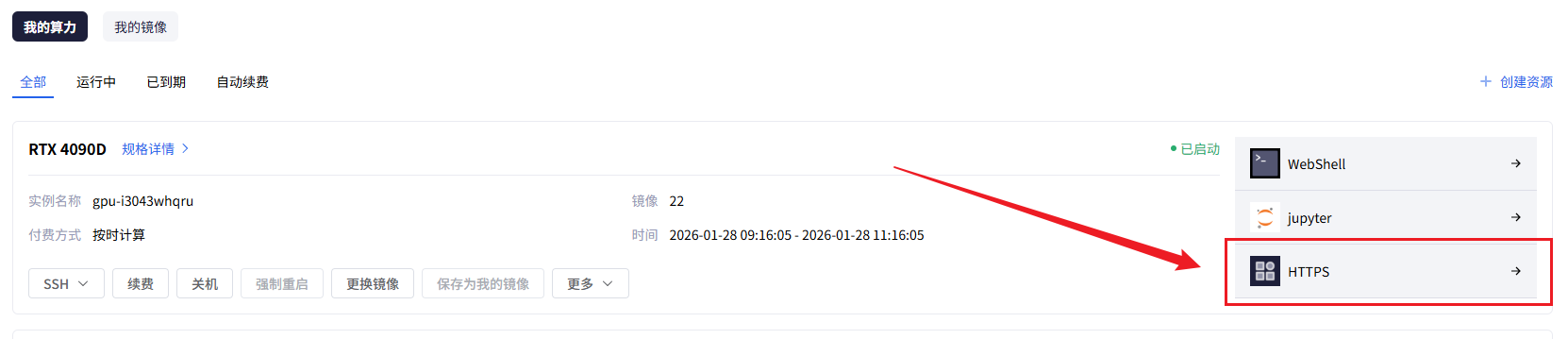

本文介绍了在星图GPU平台上自动化部署Clawdbot整合Qwen3:32B代理直连Web网关配置Chat平台镜像的完整方案。该方案通过Ollama部署大模型,并利用Clawdbot与Nginx代理,构建了一个可通过Web界面访问的私有化AI对话助手,适用于企业内部知识问答、代码辅助等场景,兼顾了数据安全与使用便捷性。

Qwen3-32B私有部署关键路径:Clawdbot代理转发+18789网关配置一文详解

想在企业内部安全、高效地部署一个强大的大语言模型,同时又能通过一个便捷的Web界面进行交互,听起来是不是有点复杂?今天,我们就来拆解一个非常实用的私有化部署方案:将Qwen3-32B模型通过Ollama部署,再使用Clawdbot作为代理,最终配置到18789端口的Web网关,打造一个专属的Chat平台。

这个方案的核心价值在于,它打通了从本地模型到Web服务的“最后一公里”。你不用再面对冰冷的命令行,团队成员可以通过一个熟悉的网页聊天界面,直接调用背后强大的Qwen3-32B模型。无论是用于内部知识问答、代码辅助还是创意讨论,都非常方便。

本文将手把手带你走通整个流程,从环境准备到最终在Web页面上成功对话,每一步都有清晰的说明和截图。即使你对网络代理、端口转发这些概念不太熟悉,也能跟着做下来。

1. 方案全景与核心价值

在开始动手之前,我们先从整体上理解一下这个方案是如何运作的,以及它能为我们带来什么。

想象一下,你有一台性能强大的服务器(或工作站),上面已经部署了Qwen3-32B模型。Ollama就像是一个高效的“模型服务管家”,它提供了标准的API接口,让其他程序可以调用这个模型。但Ollama默认的访问方式可能不够友好,也不便于团队协作。

这时,Clawdbot登场了。你可以把它理解为一个“智能接线员”或“协议转换器”。它的核心作用有两个:

- 对接模型:它能够与Ollama提供的API进行通信,发送请求并接收模型生成的结果。

- 提供Web服务:它自身可以启动一个Web服务,提供一个类似ChatGPT的聊天界面。

但是,在企业内网环境中,出于安全或网络架构的考虑,直接访问某个服务的原始端口(比如Ollama的11434端口或Clawdbot的某个端口)可能并不方便。因此,我们引入了“代理转发”这个环节。通过一个内部代理(例如Nginx、Traefik或专用的代理工具),我们将Clawdbot的Web服务端口(例如8080)的流量,转发到一个对外提供服务的网关端口(18789)。这样,用户只需要访问 http://your-server:18789 这个简单的地址,就能使用完整的聊天功能了。

这个方案带来的核心价值包括:

- 数据安全:所有数据(包括模型、对话)都在内网流转,完全私有化,满足企业对数据安全的严格要求。

- 成本可控:一次部署,团队内可无限次使用,避免了按Token调用公有云API产生的持续费用。

- 性能稳定:本地化部署,网络延迟极低,响应速度有保障,且不受外部服务波动影响。

- 使用便捷:通过Web界面访问,降低了使用门槛,方便非技术背景的团队成员使用。

- 灵活集成:该架构为未来集成其他内部系统(如知识库、CRM等)提供了可能。

下面的流程图清晰地展示了数据在整个系统中的流动路径:

graph TD

A[用户浏览器] -->|访问:18789端口| B[网络网关/代理];

B -->|转发请求至:8080端口| C[Clawdbot Web服务];

C -->|通过API调用| D[Ollama服务];

D -->|加载并推理| E[本地Qwen3-32B模型];

E -->|返回生成结果| D;

D -->|返回API响应| C;

C -->|渲染网页并返回| B;

B -->|呈现聊天界面与内容| A;

接下来,我们就进入具体的部署和配置环节。

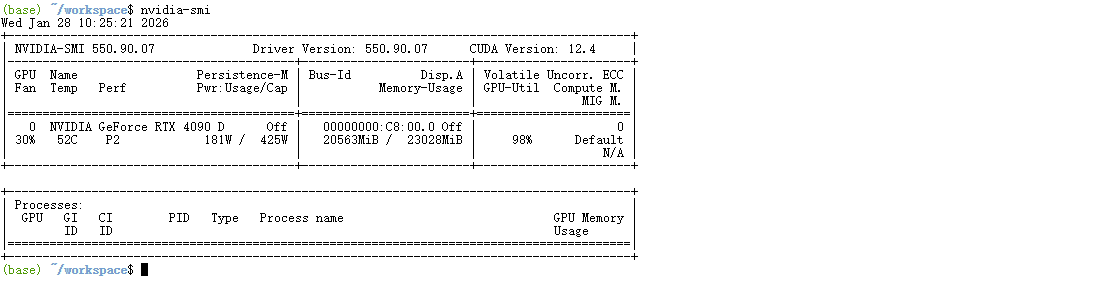

2. 基础环境准备与模型部署

万事开头难,但只要基础打好了,后面的步骤就会很顺利。这一节,我们确保Ollama和Qwen3-32B模型就位。

2.1 安装与启动Ollama

Ollama的安装非常简单。如果你的服务器是Linux系统,一条命令就能搞定:

curl -fsSL https://ollama.com/install.sh | sh

安装完成后,启动Ollama服务:

ollama serve

这个命令会启动Ollama的服务进程,默认监听 11434 端口。你可以通过 systemctl 命令将其设置为开机自启,确保服务长期稳定运行。

2.2 拉取与运行Qwen3-32B模型

Ollama服务运行起来后,我们就可以拉取强大的Qwen3-32B模型了。在终端中执行:

ollama run qwen2.5:32b

请注意:模型名称可能随版本更新而变化。如果上述命令找不到模型,你可以访问 Ollama官方模型库 搜索确认最新的准确名称,例如可能是 qwen2.5:32b 或 qwen:32b。

第一次运行这个命令时,Ollama会自动从镜像站下载模型文件。Qwen3-32B模型体积较大(约60GB),下载时间取决于你的网络带宽,请耐心等待。

下载完成后,模型会自动加载并进入一个交互式命令行聊天界面。这证明模型已经成功部署并可以正常工作。你可以输入几条消息测试一下,然后按 Ctrl+D 退出交互界面。

关键验证点:模型在后台保持运行。你可以通过以下API端点进行验证,这同时也是Clawdbot后续需要配置的地址:

- API地址:

http://localhost:11434 - 可用性检查: 在浏览器或使用

curl访问http://localhost:11434/api/tags,应该能看到包含qwen2.5:32b的JSON响应。

至此,我们的“模型服务管家”Ollama和“大脑”Qwen3-32B已经准备就绪。下一节,我们将请出“智能接线员”Clawdbot。

3. Clawdbot的配置与启动

Clawdbot是我们这个方案中的关键桥梁。我们需要获取它,并进行正确的配置,让它知道去哪里找Ollama服务。

3.1 获取Clawdbot

Clawdbot通常是一个可执行文件或需要从源码构建。请根据你的操作系统,从项目的官方发布页面(如GitHub Releases)下载最新的稳定版本。

假设你下载后得到一个名为 clawdbot 的可执行文件,将其放在一个合适的目录,例如 /opt/clawdbot/。

3.2 配置Clawdbot连接Ollama

Clawdbot需要通过配置文件来指定后端模型服务。配置文件通常是一个YAML或JSON文件,例如 config.yaml。

创建一个配置文件,内容如下:

# config.yaml 示例

model:

provider: "ollama" # 指定使用Ollama作为后端

base_url: "http://localhost:11434" # Ollama服务的地址,如果Ollama不在本机,则需替换为实际IP

model: "qwen2.5:32b" # 指定要使用的模型名称,必须与Ollama中的名称一致

server:

host: "0.0.0.0" # 监听所有网络接口

port: 8080 # Clawdbot自身Web服务将监听的端口

配置说明:

base_url: 这是最关键的一项,必须指向正在运行Ollama服务的地址和端口。如果Ollama和Clawdbot安装在同一台机器,就是http://localhost:11434。model: 这里的模型名称必须与Ollama中拉取和运行的模型名称完全一致。port: 这里我们指定Clawdbot在8080端口提供Web服务。这个端口将在下一步被代理转发。

3.3 启动Clawdbot服务

使用配置文件启动Clawdbot:

cd /opt/clawdbot

./clawdbot --config config.yaml

如果启动成功,你应该能在日志中看到类似 Server started on http://0.0.0.0:8080 的信息。

此时,可以进行初步验证:打开浏览器,访问 http://你的服务器IP:8080。如果能看到Clawdbot的Web聊天界面,但可能还无法正常对话(因为尚未通过代理配置模型),这至少证明Clawdbot的Web服务已经成功启动。

上图:Clawdbot服务成功启动后的状态示意。

上图:Clawdbot服务成功启动后的状态示意。

我们的“智能接线员”已经上线,并在8080端口待命。接下来,我们需要配置网络代理,将外部对18789端口的访问,安全地转发到这个8080端口。

4. 代理转发与18789网关配置

这是实现通过统一网关访问的关键步骤。我们假设使用Nginx作为反向代理工具,因为它广泛、稳定且配置灵活。

4.1 安装Nginx

在基于Debian/Ubuntu的系统上,安装Nginx:

sudo apt update

sudo apt install nginx -y

在基于RHEL/CentOS的系统上:

sudo yum install epel-release -y

sudo yum install nginx -y

安装完成后,启动并设置开机自启:

sudo systemctl start nginx

sudo systemctl enable nginx

4.2 配置Nginx反向代理

我们需要为Clawdbot服务创建一个独立的Nginx配置文件。创建一个新文件,例如 /etc/nginx/conf.d/clawdbot.conf。

编辑这个文件,输入以下配置:

server {

listen 18789; # 网关监听端口,用户将通过这个端口访问

server_name _; # 可以是你的域名或服务器IP,_ 表示通配

# 前端静态文件和服务代理

location / {

# 将请求转发到运行在本机8080端口的Clawdbot服务

proxy_pass http://127.0.0.1:8080;

# 以下是一些重要的代理设置,确保WebSocket等功能正常

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection "upgrade";

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

# 超时设置

proxy_connect_timeout 60s;

proxy_send_timeout 60s;

proxy_read_timeout 60s;

}

# 可选:配置API路径的直接代理,如果Clawdbot有独立API端点

# location /api/ {

# proxy_pass http://127.0.0.1:8080/api/;

# ... (同样的代理头设置)

# }

}

配置核心解读:

listen 18789;: Nginx会在服务器的18789端口上监听来自外部的HTTP请求。proxy_pass http://127.0.0.1:8080;: 这是反向代理的核心指令。所有到达18789端口的请求,都会被Nginx透明地转发到本机(127.0.0.1)的8080端口,也就是Clawdbot服务。proxy_set_header ...: 这些行确保了在转发请求时,重要的客户端信息(如真实IP、连接协议等)也能传递给后端的Clawdbot,这对于某些功能的正常运行至关重要。Upgrade和Connection头:这是为了支持WebSocket协议,聊天应用通常需要WebSocket来实现实时、全双工通信。

4.3 应用配置并测试

保存配置文件后,首先检查Nginx配置语法是否正确:

sudo nginx -t

如果显示 syntax is ok 和 test is successful,就可以重新加载Nginx使配置生效:

sudo systemctl reload nginx

现在,整个数据通路已经配置完成: 用户浏览器 -> 18789端口(Nginx) -> 8080端口(Clawdbot) -> 11434端口(Ollama) -> Qwen3-32B模型

5. 完整功能测试与使用

所有组件都已就位,是时候进行最终测试并开始使用了。

5.1 端到端测试

-

检查服务状态:

- Ollama: 确保

ollama serve进程在运行,并且ollama list能显示qwen2.5:32b模型。 - Clawdbot: 确保

./clawdbot进程在运行,监听8080端口。 - Nginx: 运行

sudo systemctl status nginx,确认其状态为active (running)。

- Ollama: 确保

-

访问Web界面:

- 打开你的浏览器。

- 在地址栏输入:

http://你的服务器IP地址:18789。 - 如果一切配置正确,你将看到Clawdbot的Web聊天界面。

上图:通过18789网关成功访问后的Clawdbot聊天界面。

上图:通过18789网关成功访问后的Clawdbot聊天界面。

- 进行对话测试:

- 在聊天框中输入一个问题,例如:“请用Python写一个快速排序函数。”

- 点击发送。如果配置全部正确,Clawdbot会将问题发送给Ollama,Ollama驱动Qwen3-32B模型生成答案,并将结果返回到Web界面。

- 观察回答的准确性、速度以及格式。如果成功收到合理且格式正确的回答,恭喜你,私有化Chat平台已部署成功!

5.2 内部架构说明

为了让你更清晰地理解整个系统内部是如何协同工作的,可以参考下面的组件关系图:

上图:展示了从用户请求到模型响应的完整内部数据流。

上图:展示了从用户请求到模型响应的完整内部数据流。

流程解读:

- 用户在浏览器访问

:18789。 - Nginx(作为网关/代理)接收请求,并将其转发到本机的

:8080端口。 - Clawdbot服务在8080端口接收到请求,解析出用户的聊天内容。

- Clawdbot根据配置,构造一个标准的API请求,发送给Ollama服务(

:11434)。 - Ollama加载指定的Qwen3-32B模型,进行推理计算,生成回答。

- 生成的回答按原路返回:Ollama -> Clawdbot -> Nginx -> 用户浏览器。

6. 总结与展望

通过本文的详细步骤,我们成功搭建了一个基于Qwen3-32B模型的私有化Chat平台。我们利用Ollama简化了模型服务的管理,通过Clawdbot提供了友好的Web交互界面,并借助Nginx反向代理实现了灵活的网关配置,将内部服务安全地暴露给用户。

回顾关键路径:

- 模型层:使用Ollama部署和运行Qwen3-32B,提供标准化API。

- 应用层:配置Clawdbot,将其后端指向Ollama,并启动Web服务。

- 接入层:配置Nginx反向代理,将Clawdbot的8080端口服务映射到对外的18789网关端口。

这个方案不仅实现了核心功能,还具备了良好的扩展性:

- 模型升级:未来可以无缝替换Ollama中的模型为更强大的版本或其他模型。

- 高可用:可以通过配置多个Ollama实例和负载均衡来提升服务能力。

- 安全加固:在Nginx层可以轻松添加SSL/TLS加密、访问认证、速率限制等安全策略。

- 功能扩展:Clawdbot或类似项目通常支持插件扩展,未来可以集成知识库检索、工具调用等高级功能。

现在,你的团队就拥有了一个完全自主可控、数据私密、性能强大的内部AI对话助手。无论是用于技术研讨、文档撰写还是创意激发,它都将成为一个得力的工具。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)