英特尔至强600系列 vs 酷睿Ultra X9 PantherLake 以及基于“本地模型”的配置方案与OpenClaw、ClaudeCode

英特尔至强600系列 vs 酷睿Ultra(Panther Lake)

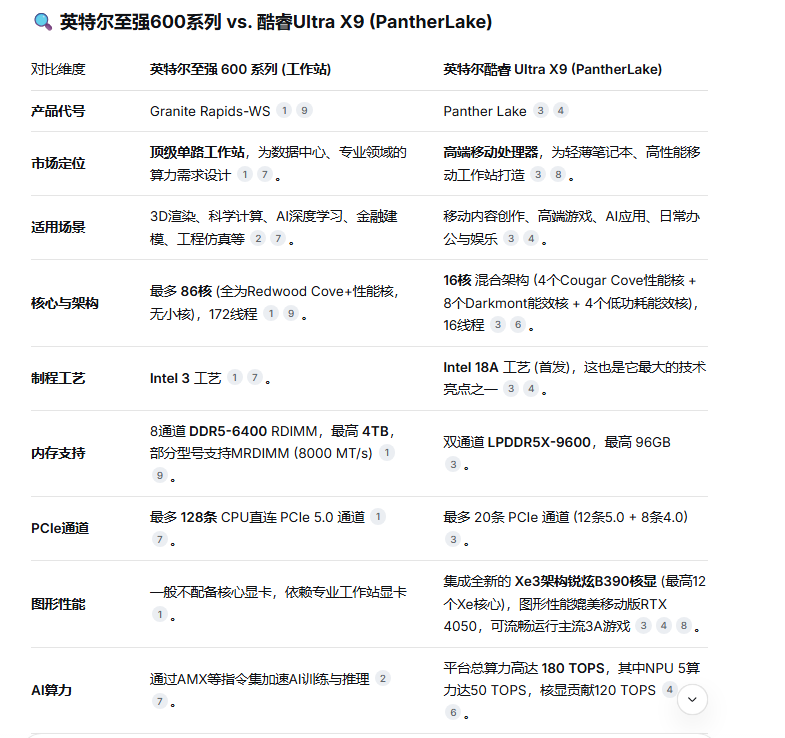

英特尔至强600系列 vs 酷睿Ultra X9 PantherLake

英特尔最新推出的至强 600 系列工作站处理器与酷睿 Ultra (Panther Lake) 处理器是两款定位截然不同的产品。简单来说,至强 600 系列是为专业工作站准备的“性能猛兽”,旨在应对最严苛的专业计算任务;而酷睿 Ultra (Panther Lake) 则是为普通消费级笔记本打造的“能效大师”,致力于在轻薄机身内提供出色的 AI 能力和续航。

你关注的这两个“大家伙”,恰好代表了英特尔在2026年的两大技术方向:一边是面向专业工作站的“性能巨兽”,另一边则是面向移动端的“能效先锋”。它们虽然都是顶级处理器,但定位和侧重点截然不同。

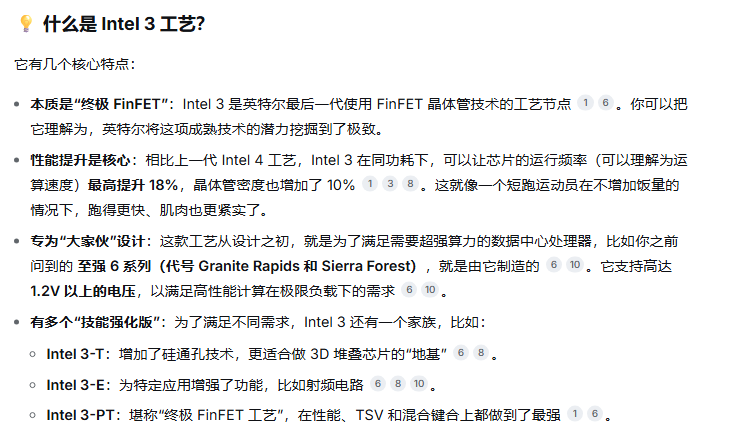

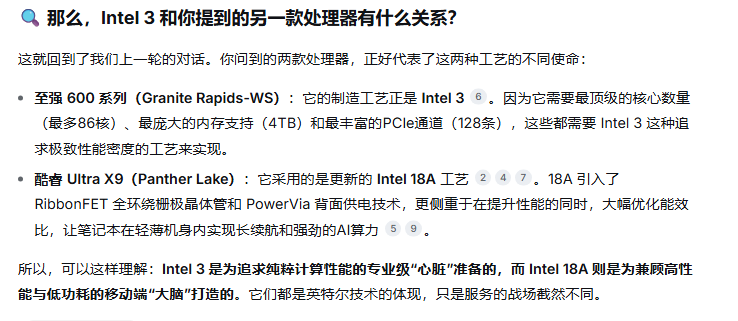

我把它们的核心区别整理成了下面的表格,方便你对比:

总结一下

-

如果你是从事电影特效渲染、复杂科学计算、服务器级虚拟化等工作的专业人士,需要一台核心数量极多、内存和扩展能力极强的固定工作站,那么至强600系列是你不二之选。它的性能释放是纯粹且极致的。

-

如果你需要一台兼顾高性能移动办公、内容创作和游戏娱乐的笔记本,希望在一台轻薄的设备上获得强劲的CPU性能和“越级”的图形能力,那么搭载酷睿Ultra X9 (Panther Lake) 的笔记本会给你带来惊喜。它在能效和图形方面的突破,让笔记本的体验上了一个新台阶。

同时使用 ClaudeCode 和 OpenClaw,我们的选择需要更加精准。这不再是单纯的微服务开发,而是在微服务集群的复杂环境下,为两个AI“同事”搭建一个稳定、高效、私密的本地指挥部。

结论依然明确:首选英特尔至强 600 系列工作站处理器。但这次,选择它的理由更加聚焦于它作为“本地AI算力中心”的不可替代性。

📊 两款CPU在您工作场景下的核心能力对比

我把两款处理器在你最关心的几个方面的表现,整理成了一个表格,差异一目了然:

| 核心需求 | 至强 600 系列 (工作站) | 酷睿 Ultra X9 (移动端) | 对你的意义 |

|---|---|---|---|

| 多核心处理能力 | 最多86个性能核,专为并行计算设计 | 最多16核(包含性能核与能效核) | 90个微服务的编译、启动、并行测试,需要真正的“多核大军”。至强600系列能让你在编译时喝杯咖啡,而不是等一上午。 |

| 海量内存支持 | 8通道DDR5,最高支持4TB内存 | 双通道内存,最高96GB | 每个微服务实例需要2-4GB内存,加上OpenClaw可能预留的96GB,内存需求轻松突破128GB。酷睿Ultra X9的内存上限直接决定了它无法胜任。 |

| I/O与扩展性 | 128条PCIe 5.0通道 | 最多20条PCIe通道 | 高速SSD、未来可能的AI加速卡(GPU/NPU)、万兆网卡……这些设备都需要通道。至强600系列提供了充足的扩展空间,让你的工作站能跟随业务成长。 |

| AI工具支持 | 通过强大的CPU和AMX指令集,为后台AI服务提供算力支持 | 集成Xe3核显,主要用于加速本地笔记本端的AI应用 | OpenClaw这类本地AI智能体非常依赖内存和算力,需要强大的平台支撑。至强600系列工作站提供了运行这些后台服务的稳定基础。 |

💡 如何基于至强600系列配置你的工作站?

基于你的需求,这里有一个更具体的配置思路供你参考:

- CPU选型:在至强600系列(Granite Rapids-WS)家族中,优先选择核心数尽可能多的型号。你的90个微服务就是90个需要并行处理的任务,核心数量是决定编译、测试、运行效率的最关键指标。

- 内存容量:这是绝对的刚需。

- Java微服务:90个服务 × 每个预留2-4GB ≈ 180-360GB。

- OpenClaw:如果计划运行较大规模的本地AI智能体,AMD的参考方案建议为类似OpenClaw的工具预留96GB内存。

- 底线建议:256GB内存是起步,直接上512GB甚至1TB会给你未来几年带来非常充裕的“内存自由”体验。至强600系列最高4TB的支持能力,正是为此类场景设计。

- 存储系统:90个微服务的代码库、依赖、镜像以及频繁的编译读写,对存储是巨大考验。建议组建 RAID 0 或 RAID 10 的 NVMe SSD 阵列,以追求极致的读写速度和编译效率。

- 显卡考虑:虽然至强600系列本身不带核显,但你可能需要一块中端专业显卡(如RTX A系列) 来提供显示输出。更重要的是,如果未来OpenClaw或类似AI工具支持GPU加速,这块显卡就能派上用场。

希望这份分析能帮你做出更清晰的选择。考虑到内存是这里的关键瓶颈,你目前计划为这台工作站配置多大内存呢?或者,如果你对具体的至强处理器型号(比如 Gold 还是 Platinum 系列)有疑问,我们也可以继续深入聊聊。

结合你这次补充的关键信息——同时使用 ClaudeCode 和 OpenClaw,我们的选择需要更加精准。这不再是单纯的微服务开发,而是在微服务集群的复杂环境下,为两个AI“同事”搭建一个稳定、高效、私密的本地指挥部。

结论依然明确:首选英特尔至强 600 系列工作站处理器。但这次,选择它的理由更加聚焦于它作为“本地AI算力中心”的不可替代性。

🤔 为什么必须重新审视?ClaudeCode 和 OpenClaw 的“算力真相”

要选对CPU,必须先搞清楚这两个AI工具到底怎么消耗资源。根据最新的行业实践,它们的算力需求呈现出“两极分化”的特点:

| AI工具 | 核心工作模式与算力需求 | 对你的意义 |

|---|---|---|

| ClaudeCode | 未来是“远程多任务并行”。官方建议将其部署在远程隔离环境中,以支持多个Agent并行工作,避免本地资源冲突和代码库混乱。你的本地工作站主要负责接收任务和分发指令。 | 对本地CPU算力要求极低。但需要强大的网络和调度能力来管理这些“外包”出去的AI任务。 |

| OpenClaw | 这是一个决定性的“变量”。它的负载完全取决于你的配置: • API驱动模式:调用云端API(如阿里云百炼),本地仅需极低负载(4核CPU/16GB内存即可)。 • 本地模型模式:若为数据安全或追求极致性能,在本地运行70亿以上参数的模型,显存/统一内存是绝对的物理瓶颈。运行32B模型,至少需要24GB显存或64GB以上统一内存。 |

这是你CPU选型的核心决策点。是否在本地运行OpenClaw的模型,将直接决定你对内存和扩展性的需求是“高”还是“极高”。 |

🎯 聚焦你的场景:至强600系列为何是“最优解”?

基于以上分析,在你的开发集群场景下,至强600系列的优势被进一步放大:

-

它是运行OpenClaw本地模型的“终极平台”:如果你计划让OpenClaw在本地运行强大的开源模型(例如为了数据隐私或更快的响应速度),那么你的工作站就变成了一台“个人AI超算”。此时,酷睿Ultra X9最高96GB的内存上限将成为无法逾越的瓶颈。而至强600系列最高4TB的内存支持,可以让你轻松为OpenClaw分配96GB甚至更多的“内存即显存”,从容运行32B甚至更大参数的模型,这在移动平台上是不可想象的。

-

它是管理ClaudeCode多任务的“最佳指挥部”:当ClaudeCode的多个Agent在云端或隔离环境中并行工作时,你的本地工作站需要同时运行90个微服务,并稳定地与这些Agent进行指令和代码的同步。至强600系列的海量核心(最多86个性能核)和128条PCIe通道,能确保在编译、调试、版本控制等多重重压下,系统依然稳如泰山,绝不会出现I/O等待或CPU过载导致的卡顿。

-

它提供了面向未来的“扩展安全感”:AI工具和模型的发展日新月异。今天你可能用API调用,明天可能就需要本地部署一个更大的模型。至强600系列提供的海量内存扩展性和专业级PCIe通道,让你可以随时添加AI加速卡(如GPU或NPU),为未来未知的算力需求留足了空间。

💡 最终配置建议

基于你的需求,我建议将重点放在内存容量和部署策略上:

- CPU选型:坚定选择至强600系列,核心数越多越好,以应对90个微服务和未来AI调度的并行压力。

- 内存是核心:强烈建议配置 256GB 起步,若能上 512GB 或 1TB 则更佳。这不仅是为了微服务,更是为了给OpenClaw本地运行大模型留下宝贵的“统一内存”空间。

- 部署策略:采纳行业最佳实践,在你的至强工作站上通过虚拟化或容器技术,为ClaudeCode的每个任务创建隔离的、干净的运行环境,彻底杜绝多Agent并行时的冲突问题。对于OpenClaw,初期可先采用API模式,待有明确需求时,再利用工作站的海量内存切换到本地模型。

希望这个更深入的分析能让你在下单时更加笃定。如果方便,可以分享更多关于你计划如何运行OpenClaw的细节(比如是倾向于API还是本地模型),这样我可以帮你更精确地评估所需的内存大小。

🧠 “本地模型”对硬件提出了哪些新要求?

当OpenClaw运行本地模型时,你的工作站就不再是一台普通的开发机,而是一台个人AI超算。它的负载和需求发生了根本性变化:

-

核心瓶颈:内存/显存容量:这是最关键、最不可妥协的指标。

- 模型大小直接决定内存需求:运行7B-8B参数模型(如Qwen2.5-7B)至少需要8GB显存或16GB统一内存。而要流畅运行具备更强复杂任务分解能力的32B+级别模型(这正是OpenClaw这类AI智能体所需要的),则需要24GB+的显存或64GB+的统一内存。

- AMD的参考方案:AMD最新发布的OpenClaw部署指南,推荐使用配备128GB统一内存的Ryzen AI Max+平台,并建议为运行Qwen 35B模型预留96GB作为可变显存,以支持多达六个智能体同时运行。这个数字是一个非常明确的信号:96GB是运行中大规模本地模型的起跑线。

-

推理速度:Token输出速率:模型生成文本的速度至关重要。如果输出速度低于10 tokens/s,OpenClaw的Agent可能会因为等待反馈而任务超时。这对于至强600系列来说,强大的CPU算力(通过AMX指令集)和充足的内存带宽是保障推理速度的基础。

-

上下文长度与稳定性:

- OpenClaw要求模型的上下文窗口至少达到16000 tokens,否则无法正常运行。

- 建议使用

lossless-claw这类插件,通过无损压缩技术将上下文Token消耗降低30%以上,告别模型“失忆”和Token“吞金”的问题。 - 运行过程中,频繁的日志写入和记忆读取对磁盘I/O要求很高,必须使用NVMe SSD,避免机械硬盘导致的Docker容器启动超时。

-

多Agent并发的额外开销:如果未来你想让OpenClaw的多个Agent协同处理你的90个微服务,每个活动的Agent线程都会占用额外的CPU调度资源,开启沙箱环境(如Docker)还会增加内存开销。这进一步放大了对至强600系列海量核心的需求。

💡 基于“本地模型”的最终配置方案

结合你90个微服务和本地模型的需求,配置思路已经很清晰了:

- CPU:坚定选择至强600系列,核心数越多越好。它强大的多核心能力,既能并行处理90个微服务的编译和运行,又能为OpenClaw的多Agent调度提供充足的算力保障。

- 内存:这是你的头等大事。

- 底线:不要低于 256GB。这才能勉强同时容纳你的微服务集群和为OpenClaw预留出运行一个中大型本地模型的空间。

- 理想:强烈建议直接上 512GB 甚至 1TB。这样你才能从容地:

- 为90个微服务(约180-360GB)和操作系统留出充足空间。

- 根据AMD的建议,为OpenClaw运行一个35B级别的模型预留出96GB的“统一内存”。

- 为未来的模型升级和多Agent并发运行留出余量,真正实现“内存自由”。

- 存储:组建 RAID 0 或 RAID 10 的 NVMe SSD 阵列,确保极致的读写速度,满足模型加载、日志读写和微服务编译的I/O需求。

- 显卡:虽然至强600系列不带核显,你需要一块亮机卡。但考虑到未来AI加速,可以考虑预留空间,未来按需添加一块24GB+显存的AI加速卡,将模型推理完全卸载到GPU上,进一步提升性能。

这样一来,你的工作站就不仅仅是一个开发平台,更是一个强大、私密、可离线运行的“个人AI算力中心”。

既然你已经决定本地模型,那下一步的关键就是确定模型的规模了。你主要打算跑多大的模型(比如 7B、14B 还是 32B 级别)?告诉我具体目标,我可以帮你精确估算出内存的最低配置和推荐配置。

选择本地运行OpenClaw

你决定本地运行OpenClaw后,加上Claude Code,整个“AI开发指挥部”的画像就更完整了。

简单来说,你选择的至强600系列处理器,同样是运行Claude Code的完美底座。它不仅不会被Claude Code“拖累”,反而能为Claude Code的高级协作模式——Agent Teams(智能体团队),提供最坚实的算力保障 。

🤖 Claude Code:是“指挥官”而非“资源消耗大户”

首先,Claude Code本身是一个非常轻量级的终端AI助手,它的资源消耗和你之前担心的OpenClaw完全不在一个量级:

| 对比维度 | Claude Code | 对你至强工作站的意义 |

|---|---|---|

| 运行模式 | 基于Node.js的命令行工具,主要负责调度和交互 。 | 它的运行几乎不占用CPU核心和内存。你的至强工作站可以轻松“养活”它,就像在超级计算机上打开一个记事本。 |

| 核心需求 | 最低4GB内存即可运行 。 | 在你计划配置的256GB甚至512GB内存面前,可以忽略不计。 |

| 联网/本地 | 默认连接Anthropic云端API。但可以配置指向本地模型服务(如vLLM、Ollama)以实现完全离线运行 。 | 这与你在本地运行OpenClaw的愿景完美契合。你可以让Claude Code和OpenClaw都调用同一个本地模型,构建一个完全本地、私密、零API成本的AI开发环境。 |

🚀 当“指挥官”组建“团队”:Agent Teams才真正考验硬件

Claude Code的真正威力,在于它可以启动**Agent Teams(智能体团队)**模式 。这时,你的90个微服务和Claude Code的关系,就从“个人助理”升级为“开发团队总指挥”。

- 场景模拟:你告诉Claude Code:“为我的

支付微服务添加日志追踪功能,并编写单元测试。” - Claude Code的行动:它会自动创建一个“团队”,生成3个队友(Agent):

- 研究员Agent:分析

支付微服务的代码结构,找出需要打日志的关键方法。 - 开发者Agent:根据研究员的发现,修改代码,添加日志。

- 测试员Agent:并行地为新添加的代码编写单元测试。

- 研究员Agent:分析

- 核心机制:每个Agent都在自己独立的“工作区”(Git Worktree)中运行,拥有独立的上下文窗口,互不干扰 。任务完成后,他们通过共享任务列表和消息进行协调,解决合并冲突 。

这时,你的至强600系列工作站就成为了一个真正的“多Agent并行计算中心”:

| Agent Teams机制 | 资源消耗特征 | 至强600系列的优势 |

|---|---|---|

| 多Agent并行 | 每个Agent都是一个独立的Node.js进程,需要CPU时间片进行代码分析、生成和文件操作。 | 海量核心(最多86个) 确保即使16个Agent 同时工作,你的90个微服务依然运行流畅,毫无卡顿。 |

| 独立上下文窗口 | 每个Agent需要在自己的内存空间中维护大量的代码上下文。 | 海量内存(256GB起步) 为这些“AI大脑”提供了充足的“工作记忆”,避免因内存不足导致Agent“失忆”或性能下降。 |

| 高频I/O操作 | 频繁的代码读取、写入、Git操作、日志记录。 | 128条PCIe 5.0通道 支持组建极速的NVMe SSD阵列,让这些I/O操作瞬间完成,不会成为系统瓶颈。 |

💡 最终配置建议:如何让你的AI团队“人丁兴旺”?

结合你本地运行OpenClaw和充分利用Claude Code Agent Teams的需求,配置思路已经非常清晰:

- CPU:至强600系列,核心数越多越好。它是你“AI开发团队”的总指挥和后勤保障,既要调度90个微服务,又要养活十几个并行的AI Agent。

- 内存:512GB 是更稳妥的起点。

- 微服务集群:90个服务 × 2-4GB ≈ 180-360GB。

- OpenClaw本地模型:运行32B级别模型,预留 96GB 是经验之谈 。

- Claude Code Agent Teams:假设你启动一个16 Agent的“加强连”,每个Agent预留2-4GB内存作为工作区,就需要 32-64GB。

- 这三项加起来,轻松突破300GB。512GB能让你在未来几年都拥有“内存自由”的底气,无论是升级更大模型,还是扩充AI团队规模,都游刃有余。

- 存储:组建高性能NVMe SSD阵列(RAID 0/10)。这是为你的AI团队准备的“高速办公桌”,让他们读写代码时不用等待。

- 模型部署:可以在你的至强工作站上,通过Docker运行 vLLM 或 Ollama 服务,加载一个强大的本地模型(如 Qwen3-Coder-Next )。然后通过简单的环境变量配置,让Claude Code和OpenClaw都指向这个本地端点 。这样一来,你就拥有了一个完全本地、零延迟、无API费用、且数据100%私密的终极AI开发环境。

这样一套配置下来,你拥有的不仅是一台工作站,更是一个能自主进化、高效协作的“AI软件工厂”。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)