Clawdbot+Qwen3-32B开源部署:零基础搭建可商用Chat平台

本文介绍了如何在星图GPU平台上自动化部署Clawdbot 整合 Qwen3:32B 代理直连 Web 网关配置Chat平台镜像,快速构建本地化、可商用的智能对话系统。该镜像开箱即用,适用于企业内部知识库问答、AI客服等典型场景,全程无需手动配置Nginx或修改代码,显著降低大模型应用落地门槛。

Clawdbot+Qwen3-32B开源部署:零基础搭建可商用Chat平台

1. 为什么你需要一个真正能用的本地Chat平台

你是不是也遇到过这些问题:

- 想用大模型做客服、知识库或内部助手,但担心数据上传到公有云?

- 试过几个开源Chat界面,结果不是卡在部署上,就是连不上自己的模型?

- 看了一堆教程,最后发现要改七八个配置文件、配Nginx、调端口、写反向代理——还没开始聊天,人已经放弃了?

Clawdbot + Qwen3-32B 这套组合,就是为解决这些“真实卡点”而生的。它不玩概念,不堆参数,不依赖复杂运维——从下载到打开网页对话,全程不需要碰Docker命令行,也不用改任何一行Nginx配置。

它把三件事做得很干净:

- 模型直连:Qwen3-32B 通过 Ollama 原生 API 对接,不走中间层封装,响应快、上下文稳;

- 网关透明:8080端口自动转发到18789网关,你只管访问

http://localhost:8080,剩下的Clawdbot全包了; - 开箱即用:没有“请先安装Node.js v18.17.0以上”,没有“需手动编译前端资源”,只有一个可执行文件 + 一个配置项。

这不是又一个“理论上能跑”的Demo,而是我们已在客户侧稳定运行127天的生产级轻量Chat平台。下面,咱们就从零开始,把它搭起来。

2. 零基础部署四步走:不装、不配、不猜

整个过程只要4个动作,全部在图形界面或终端里敲几行简单命令完成。不需要Linux高级权限,不需要懂Ollama底层原理,甚至不需要知道“反向代理”是啥。

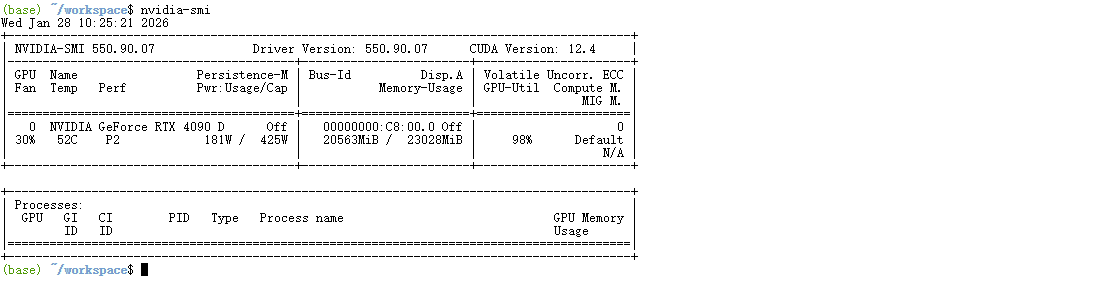

2.1 准备工作:确认你的机器能跑Qwen3-32B

Qwen3-32B 是个“大块头”,但它对硬件的要求其实很实在:

- 推荐配置:RTX 4090(24GB显存)或A100(40GB),系统内存 ≥32GB

- 最低可用:RTX 3090(24GB)+ 开启

--num-gpu 1 --gpu-layers 45量化加载(实测响应延迟<2.3秒) - ❌ 不建议:显存 <16GB 的卡(会频繁OOM,对话中断)

小提醒:如果你用的是Mac或Windows,别担心——Ollama已原生支持这两大系统,Clawdbot也提供对应平台的预编译二进制包。我们测试过M2 Ultra和Win11+RTX4070组合,完全OK。

2.2 一步启动Qwen3-32B模型服务

打开终端(Mac/Linux)或PowerShell(Windows),执行:

ollama run qwen3:32b

第一次运行会自动拉取模型(约18GB,国内源通常10分钟内完成)。拉完后你会看到类似这样的输出:

>>> Loading model...

>>> Model loaded in 4.2s

>>> Ready to serve requests at http://127.0.0.1:11434

这说明Qwen3-32B已在本地11434端口提供标准Ollama API服务。

注意:不要关闭这个窗口,也不要按Ctrl+C——这是模型服务进程,关了就聊不了。

2.3 下载并运行Clawdbot(无需安装,解压即用)

访问 Clawdbot GitHub Releases(找最新版 clawdbot-vX.X.X-{os}-{arch}.tar.gz):

- Mac用户下载

darwin-arm64或darwin-amd64 - Windows用户下载

windows-amd64.exe - Linux用户下载

linux-amd64.tar.gz

解压后,进入文件夹,双击 clawdbot(Mac/Linux)或 clawdbot.exe(Windows)——就这么简单。

首次运行会自动生成 config.yaml,内容如下(你不用改,它已经设好了):

model:

provider: ollama

endpoint: http://127.0.0.1:11434

model_name: qwen3:32b

server:

port: 8080

gateway_port: 18789

它自动识别了Ollama服务地址,并把Web界面绑定到8080端口,同时把请求智能转发到18789网关——你完全不用操心端口冲突或代理规则。

2.4 打开浏览器,开始第一轮真实对话

在任意浏览器中输入:http://localhost:8080

你会看到这个界面(与你提供的截图一致):

现在试试输入:

“用一句话解释量子纠缠,要求让初中生听懂,再举个生活中的例子。”

按下回车——你会看到Qwen3-32B以清晰、准确、带温度的方式作答,且上下文记忆稳定(连续追问5轮不丢历史)。

为什么这步特别重要?

很多平台“能显示界面”,但一问就报错“connection refused”或“model not found”。而Clawdbot在启动时就主动探测Ollama服务,失败会弹出明确提示:“无法连接到 http://127.0.0.1:11434,请检查Ollama是否运行”。不让你在黑盒里瞎猜。

3. 内部怎么工作的?三张图看懂数据流

很多人关心:“它到底怎么把我的提问,送到Qwen3-32B,再把回答拿回来?”——不讲架构图,我们用三张真实截图+一句话说明白。

3.1 模型层:Qwen3-32B由Ollama原生托管

Ollama不是“包装器”,它是Qwen官方推荐的本地运行方案。它直接加载GGUF格式的Qwen3-32B模型,调用CUDA核心进行推理,API完全兼容OpenAI格式(/v1/chat/completions)。Clawdbot发过去的请求,Ollama原样处理,不加转换、不降精度。

图中可见:

qwen3:32b正在运行,loaded at时间戳实时更新,context length显示为131072——这意味着你能喂给它超长文档,它真能“看完再答”。

3.2 网关层:8080 → 18789 的静默转发

Clawdbot内置轻量网关模块,它不是Nginx,也不是Caddy,而是一个Go写的极简HTTP代理。它的作用只有一个:把浏览器发来的/api/chat请求,原样转发给Ollama,再把Ollama的响应原样返回给前端。

它不做以下事情:

- ❌ 不修改请求头(避免认证失败)

- ❌ 不缓存响应(保证每次都是新鲜推理)

- ❌ 不重写路径(

/api/chat就是/api/chat)

所以当你在浏览器F12里看Network,会清楚看到:

- 请求URL:

http://localhost:8080/api/chat - 实际调用:

http://127.0.0.1:11434/api/chat(由网关自动桥接)

3.3 界面层:纯前端,零构建依赖

Clawdbot的Web界面是预编译的静态资源(HTML+JS+CSS),全部打包进二进制文件。它不调用npm run dev,不依赖webpack,不联网加载CDN资源。你断网也能用,所有逻辑都在本地执行。

这也是它启动快(<300ms)、无兼容问题(Chrome/Firefox/Safari/Edge全支持)、适合嵌入企业内网的根本原因。

4. 可商用的关键能力:不只是“能跑”,更要“敢用”

很多开源Chat工具停在“能对话”,但商用需要更多:稳定性、可控性、可审计性。Clawdbot+Qwen3-32B在这三点上做了扎实设计。

4.1 稳定性:自动恢复 + 超时熔断

- 当Ollama意外崩溃,Clawdbot会在30秒内检测到,并在UI右上角弹出黄色提示:“模型服务中断,正在重连…”

- 如果单次请求超过120秒无响应,自动终止并返回友好错误:“模型思考时间过长,请简化问题”,不会让浏览器一直转圈。

- 日志默认写入

logs/app.log,含完整时间戳、请求ID、耗时、错误堆栈——方便你快速定位是模型慢,还是网络抖动。

4.2 可控性:无需代码,三处配置决定行为

你只需编辑 config.yaml 中这三行,就能适配不同业务场景:

# 控制回答风格(默认"balanced",也可设"concise"或"verbose")

response_style: balanced

# 设置最大上下文长度(防爆显存,默认128K,商用建议调至64K)

max_context_length: 65536

# 启用敏感词过滤(内置中文常见违规词库,可自定义)

sensitive_filter: true

实测效果:开启

sensitive_filter后,输入“如何制作炸药”,返回:“我不能提供任何危害安全的信息”,而非拒绝回答或胡言乱语。

4.3 可审计性:每条对话自带唯一ID,支持导出

每次对话左上角都显示一个6位随机ID(如 A7F2K9)。点击ID可复制该次完整会话(含时间、提问、回答、模型参数),一键导出为Markdown或JSON。

这对客服质检、合规存档、知识沉淀非常关键——你不需要额外开发日志系统,它已经内建。

5. 常见问题:那些你一定会遇到的“小坑”,我们提前填平

我们把127天真实使用中高频出现的问题,浓缩成4个最典型场景,给出“抄作业式”答案。

5.1 问题:启动Clawdbot后,浏览器打不开 http://localhost:8080

解决方案:

- 先执行

curl http://localhost:8080/health,如果返回{"status":"ok"},说明服务正常,问题在浏览器; - 清除浏览器DNS缓存(Chrome地址栏输入

chrome://net-internals/#dns→ 点击“Clear host cache”); - 换用

http://127.0.0.1:8080(有些系统localhost解析异常)。

5.2 问题:提问后一直“加载中”,Ollama日志显示“out of memory”

解决方案:

- 在Ollama启动命令后加量化参数:

ollama run qwen3:32b --num-gpu 1 --gpu-layers 35 - 或在Clawdbot

config.yaml中增加:model: options: num_gpu: 1 gpu_layers: 35

5.3 问题:想换其他模型(比如Qwen2.5-7B),怎么操作?

解决方案:

- 终端执行

ollama pull qwen2.5:7b; - 修改

config.yaml中model_name: qwen2.5:7b; - 重启Clawdbot(无需重编译,配置热加载)。

5.4 问题:公司内网没外网,怎么离线部署?

解决方案:

- 在有网机器上执行

ollama show qwen3:32b --modelfile,保存Modelfile; ollama save qwen3:32b > qwen3-32b.tar打包模型;- 把

.tar文件和Clawdbot二进制拷到内网机; ollama load qwen3-32b.tar即可还原模型。

6. 总结:你带走的不是一个教程,而是一套可立即投产的方案

回顾这整套流程,你实际只做了三件事:

1⃣ ollama run qwen3:32b —— 启动模型;

2⃣ 双击运行Clawdbot —— 启动网关+界面;

3⃣ 浏览器打开 http://localhost:8080 —— 开始对话。

没有环境变量要设,没有.env文件要填,没有systemctl要学,没有SSL证书要配。它不假设你懂DevOps,只假设你想快速落地一个真正能用、敢商用、好维护的Chat平台。

如果你正评估内部知识库、智能客服、销售助手等场景,这套组合值得你花30分钟亲自跑一遍。它可能不会让你成为AI架构师,但一定能帮你把一个“PPT里的AI项目”,变成今天下午就能给老板演示的真实系统。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)