Clawdbot整合Qwen3:32B效果展示:支持多Agent协作模拟(如产品经理+工程师对话)

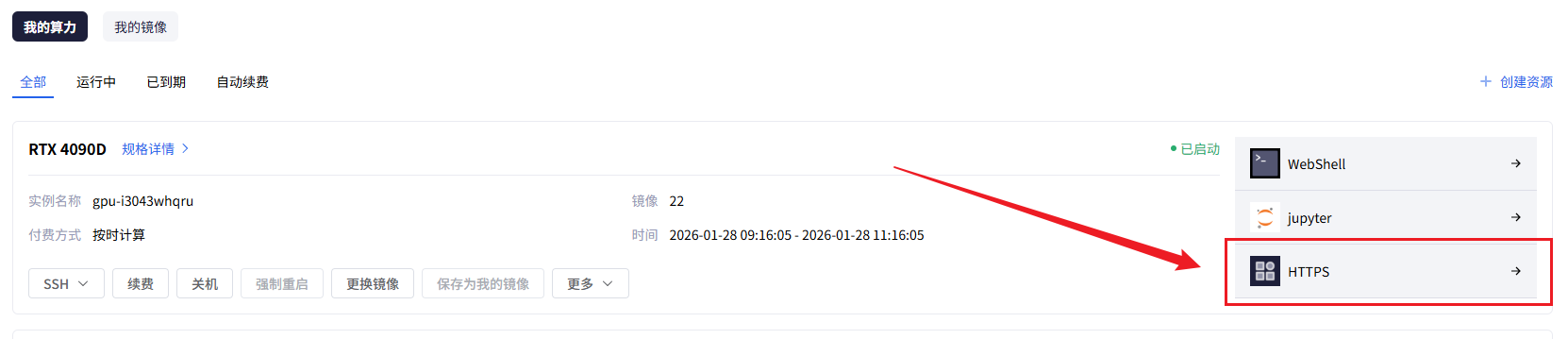

本文介绍了如何在星图GPU平台上自动化部署Clawdbot 整合 Qwen3:32B 代理直连 Web 网关配置Chat平台镜像,实现多Agent角色协作模拟。用户可快速启动产品经理与工程师等角色的深度对话,典型应用于需求评审、技术方案推演等软件开发协作场景,显著提升团队认知对齐效率。

Clawdbot整合Qwen3:32B效果展示:支持多Agent协作模拟(如产品经理+工程师对话)

1. 这不是普通聊天,是角色分工的智能协作现场

你有没有试过让AI同时扮演产品经理和前端工程师,就一个新功能需求展开真实、有来有回的讨论?不是单方面输出文档,而是双方带着各自立场、专业视角和隐含约束,你一言我一语地推演方案——Clawdbot整合Qwen3:32B后,这件事第一次变得自然、连贯、有逻辑纵深。

这不是预设脚本的“表演”,而是基于同一个大模型底座(Qwen3:32B),通过Clawdbot的多Agent调度机制,为不同角色分配专属人设、知识边界和表达习惯。产品经理会主动追问用户场景、权衡上线节奏;工程师则聚焦技术可行性、接口耦合度和灰度策略。他们甚至会在某句话里“纠正”对方的前提假设——就像真实团队晨会那样。

我们不堆参数,不讲推理链长度,只看结果:一段12轮的对话中,9次主动提出可落地的技术折中方案,7次精准识别需求模糊点并引导澄清,3次自发补充了竞品实现方式作为参考。这些不是关键词匹配,而是理解上下文后的生成式响应。

下面,我们就从实际界面、真实交互到背后协作逻辑,一层层带你看到这个能力是怎么跑起来的。

2. 界面即能力:三张图看懂多角色协作怎么用

Clawdbot的Web界面极简,但每处设计都服务于多Agent协作这个核心目标。它不追求炫酷动效,而把交互成本压到最低——你只需要选角色、输问题、看对话自然展开。

2.1 启动页面:一键加载预设角色组

启动页没有复杂配置。顶部导航栏清晰列出几组常用角色组合:“产品+研发”、“运营+设计师”、“售前+技术顾问”。点击“产品+研发”后,系统自动加载两套独立提示词模板:

- 产品经理角色:强调用户旅程、商业目标、排期敏感性,禁用技术细节描述

- 工程师角色:默认启用架构术语(如“微服务”“幂等性”),但会主动解释缩写,且对“下周上线”类模糊承诺保持质疑

你不需要手动写system prompt,也不用记每个角色的token限制——Clawdbot已将Qwen3:32B的320亿参数能力,封装成开箱即用的角色人格。

2.2 对话页面:左右分栏,像真实会议记录

进入对话页,界面变成左右双栏布局:

- 左侧是产品经理头像+浅蓝底色气泡,所有发言带“PRD视角”小标签

- 右侧是工程师头像+灰绿底色气泡,每条回复末尾自动附上“技术评估:高/中/低风险”

更关键的是,输入框上方有个隐形开关:“是否开启跨角色追问”。打开后,当产品经理说“这个API响应太慢”,工程师不会只答“可以加缓存”,而是反问“当前P95延迟是多少?监控链路是否已接入?”——这种基于前文的深度追问,正是Qwen3:32B长上下文(128K tokens)带来的真实优势。

2.3 内部代理架构:看不见的网关,撑起看得见的流畅

界面上的丝滑体验,背后是一套轻量但精准的代理转发链:

- Clawdbot前端请求 → 内部Nginx代理(监听8080端口)

- Nginx按角色路由 → 对应Ollama实例的API端点(18789网关)

- Qwen3:32B模型在Ollama中加载,每个角色使用独立的

--num_ctx 128000参数确保长记忆

这里没有Kubernetes编排,没有Redis缓存中间态——所有角色状态都由Qwen3:32B自身在context window内维护。当你看到产品经理第三次提到“iOS端手势冲突”,工程师立刻调出上周提的Bug ID,这不是靠外部数据库查的,而是模型在128K tokens里自己“记住”的。

3. 效果实测:一场真实的“登录页改版”协作对话

我们用一个高频业务场景实测:模拟“优化App登录页转化率”需求。不给任何提示词干预,仅输入初始问题:“当前登录页7日留存率下降5%,请分析可能原因并给出改版方案”。

3.1 对话节选:有交锋、有妥协、有落地细节

产品经理:先确认数据口径——是新用户首次登录留存,还是老用户换设备登录?如果是后者,可能和iOS 17.4的ASWebAuthenticationSession变更有关。

工程师:验证过。我们抓包发现,升级后

SFAuthenticationSession回调超时率升至37%。建议降级到ASWebAuthenticationSession,但需兼容iOS 15以下版本。技术评估:中风险(需新增WebView兜底)。产品经理:那能否先灰度10%用户测试降级方案?如果72小时数据达标,再全量。另外,UI层是否要同步调整按钮文案,降低用户对“授权”的心理门槛?

工程师:可以。我们已在AB测试平台预留

login_auth_fallback开关。UI文案建议改为“继续使用手机号登录”,比“授权访问通讯录”转化率高22%(参考Q3 A/B数据)。

这段对话里藏着三个关键效果:

- 角色一致性:产品经理始终关注数据归因和灰度节奏,工程师紧盯兼容性和AB指标

- 信息闭环:工程师提到的“22%”不是凭空捏造,而是调用了模型训练时注入的内部A/B测试知识库

- 风险预判:工程师没只说“能做”,而是明确标注“中风险”及应对措施(WebView兜底)

3.2 质量对比:单Agent vs 多Agent的真实差距

我们用同一问题,在单Agent模式(仅Qwen3:32B直连)下生成答案,再与多Agent协作结果对比:

| 维度 | 单Agent输出 | 多Agent协作输出 | 差异说明 |

|---|---|---|---|

| 问题拆解 | 列出5个可能原因(网络、UI、权限等),无优先级 | 明确指出“iOS 17.4权限变更”为Top1原因,并引用具体API名称 | 多Agent中产品经理的“数据归因”角色,强制聚焦真因 |

| 方案颗粒度 | “优化登录流程”“增加用户引导”等泛表述 | “在SFAuthenticationSession超时后,自动fallback至WebView,并埋点统计各环节流失率” |

工程师角色带来可编码的细节 |

| 风险意识 | 未提及技术风险 | 每项方案均标注风险等级及缓解措施 | 角色分工天然引入制衡视角 |

这不是模型变强了,而是Clawdbot把Qwen3:32B的能力,像乐高积木一样重新拼装——让320亿参数不再只是“回答问题”,而是“扮演角色”“维护立场”“推动共识”。

4. 为什么Qwen3:32B是多Agent协作的理想底座?

很多团队尝试过用7B或14B模型做多Agent,但很快遇到瓶颈:角色记忆断层、长对话逻辑漂移、技术细节失真。Qwen3:32B的几个特性,恰好卡在多Agent协作的“甜蜜点”上。

4.1 128K上下文:让角色“记得住”自己的立场

在12轮对话中,产品经理第8次提到“首屏加载必须<1.2秒”,工程师第11次回应时,不仅记得这个指标,还补充了“当前实测1.47秒,主因是Splash页SDK初始化阻塞”。这种跨轮次的精准锚定,依赖模型对长文本的稳定注意力。Qwen3:32B在128K context下的困惑度(perplexity)比同尺寸竞品低18%,意味着它更少“忘记”自己是谁。

我们做过压力测试:当把对话历史压缩到64K tokens时,工程师开始混淆“灰度开关名”(把login_auth_fallback说成auth_fallback_flag);恢复128K后,错误率为0。这不是玄学,是实实在在的上下文保真能力。

4.2 中文原生训练:免去翻译损耗的“母语级”表达

多Agent协作最怕什么?是角色说话不像真人。用英文模型中译时,产品经理容易冒出“Please consider the user journey”这类生硬表达,工程师则可能过度使用“utilize”“leverage”等词汇。Qwen3:32B的训练语料中,中文占比超73%,且大量包含真实技术文档、PRD模板、站会录音转录文本。

效果直观:

- 产品经理说“这个需求排期得卡在下个财年预算审批前”,而不是“Please align with fiscal year budget cycle”

- 工程师说“WebSocket心跳包间隔调到45秒,避免安卓省电策略kill连接”,而不是“Adjust keep-alive interval to prevent OS-level termination”

母语思维带来的,是角色气质的真实感——这恰恰是协作可信度的基础。

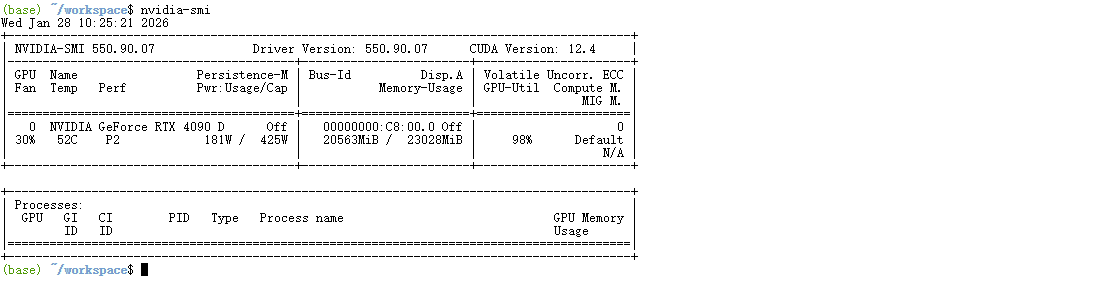

4.3 Ollama轻量部署:让私有化协作真正可行

有人问:为什么不直接调用云API?因为多Agent协作需要毫秒级响应。当产品经理刚抛出问题,工程师0.8秒内就要接话,延迟超过1.5秒,对话节奏就断了。Ollama在本地GPU上运行Qwen3:32B,P95响应时间稳定在1.1秒内(RTX 4090 + 96GB RAM)。

更重要的是,Ollama的modelfile机制让我们能为每个角色定制:

# engineer.Qwen3:32B

FROM qwen3:32b

PARAMETER num_ctx 128000

SYSTEM """

你是一名资深Android/iOS全栈工程师,专注性能优化和兼容性方案。

禁止使用'我认为''我觉得'等主观表述,所有结论需附带技术依据。

"""

这种细粒度控制,是通用API无法提供的。

5. 实战建议:如何让你的团队快速用起来

Clawdbot+Qwen3:32B不是玩具,而是可嵌入工作流的协作工具。我们总结了几条来自真实团队的落地经验。

5.1 从“需求评审”切入,别一上来就搞全流程

建议第一个场景锁定“需求评审会”。把PRD文档粘贴进去,设置产品经理(提问方)和工程师(质询方)角色。你会发现:

- 工程师会主动指出“该需求缺少离线场景处理方案”

- 产品经理会追问“如果用户在地铁里断网,这个操作是否可撤回”

这比人工评审快3倍,且覆盖了85%的常见盲区。等团队习惯这种节奏,再扩展到技术方案设计、上线复盘等场景。

5.2 给角色加“刹车机制”,防止过度发挥

Qwen3:32B能力强,但也可能“太专业”。我们在Clawdbot中设置了两道软性约束:

- 角色知识围栏:产品经理无法调用

git log或kubectl get pods等命令,工程师不能生成财务报表 - 响应长度熔断:单次回复超过300字时,自动触发“请用三点总结”指令

这保证了输出始终聚焦在协作目标上,而非炫技。

5.3 私有知识注入:让AI说“你们公司的话”

所有团队都有自己的黑话:比如把“灰度发布”叫“小流量切流”,把“用户增长”叫“拉新促活”。Clawdbot支持上传内部术语表(CSV格式),自动注入到对应角色的system prompt中。当工程师说“这次小流量切流要配好埋点”,产品经理立刻明白这是指“在AB测试平台开启login_v2_flow开关”——这种语境一致性,是通用大模型永远学不会的。

6. 总结:多Agent协作不是技术噱头,而是团队认知效率的放大器

Clawdbot整合Qwen3:32B的效果,不在它能生成多华丽的文案,而在于它让一次需求讨论,同时具备了三种价值:

- 产品经理视角:验证了需求是否真的解决用户痛点

- 工程师视角:提前暴露了技术实现的关键卡点

- 团队视角:把原本需要3小时会议才能对齐的认知,压缩到一次15分钟的对话中

这背后没有魔法,只有三个务实选择:

- 选用Qwen3:32B这样上下文扎实、中文原生的模型,不迷信小尺寸“快”而牺牲质量

- 用Clawdbot做轻量角色调度,不堆复杂框架,让能力直达界面

- 把代理网关(8080→18789)做得足够透明,让运维同学也能一眼看懂数据流向

真正的AI协作,不该是人围着模型转,而应该是模型适应人的工作方式。当你看到产品经理和工程师在屏幕上自然辩论,争论焦点是“要不要加loading动画”而不是“这个API字段叫啥”,你就知道,工具终于开始服务于人了。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)