本地部署openclaw+大模型

本文详细介绍了使用Ollama和OpenClaw部署本地大模型的完整流程。首先下载安装Ollama,然后部署量化版Qwen3.5 27B模型。接着通过npm安装OpenClaw,并完成手动配置向导,设置本地网关、模型参数和API端点等关键选项。配置过程中选择OpenAI兼容格式,指定量化模型ID,设置网关端口和认证令牌。最后启动OpenClaw与Qwen3.5模型的集成,为后续配置功能插件(ski

前言

目录

本地部署openclaw+大模型-skill的安装-CSDN博客

1.ollama下载

ollama的安装可以去官网下载(逛网下载较慢),下载地址:https://ollama.com/download

也可以使用我提供的连接下载,太大本地资源无法上传只能上传网盘。

通过网盘分享的文件:OllamaSetup(1).exe

链接: https://pan.baidu.com/s/1fJx66Uhk_GeL_ph3SbA5UA 提取码: j3ii

2.安装ollama

找到下载的ollama,右键以管理员运行指导安装成功,弹出ollama的界面,如下:

显示该界面是,说明ollama以安装成功;

以管理员运行cmd;

执行:ollama -v

接下来可以安装部署本地大模型,

3.本地部署大模型:

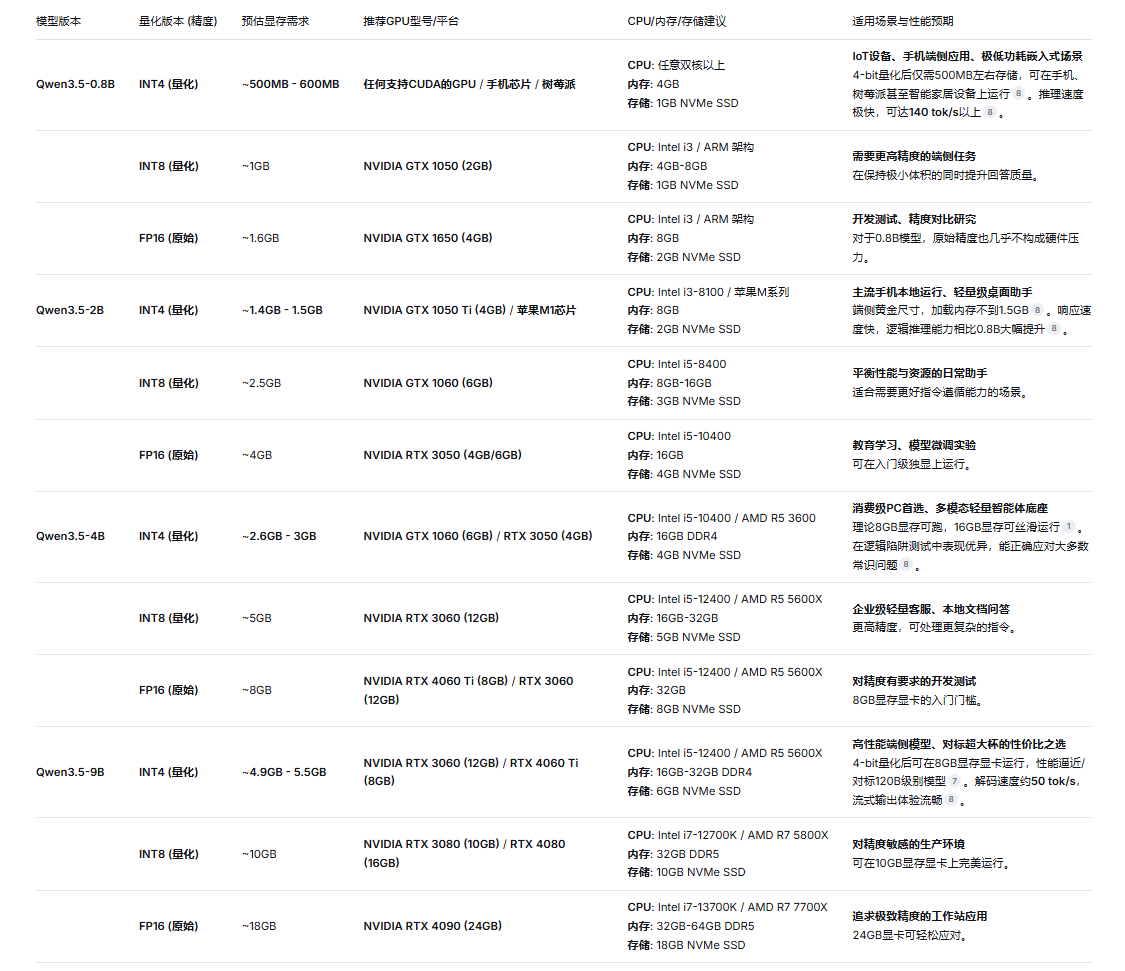

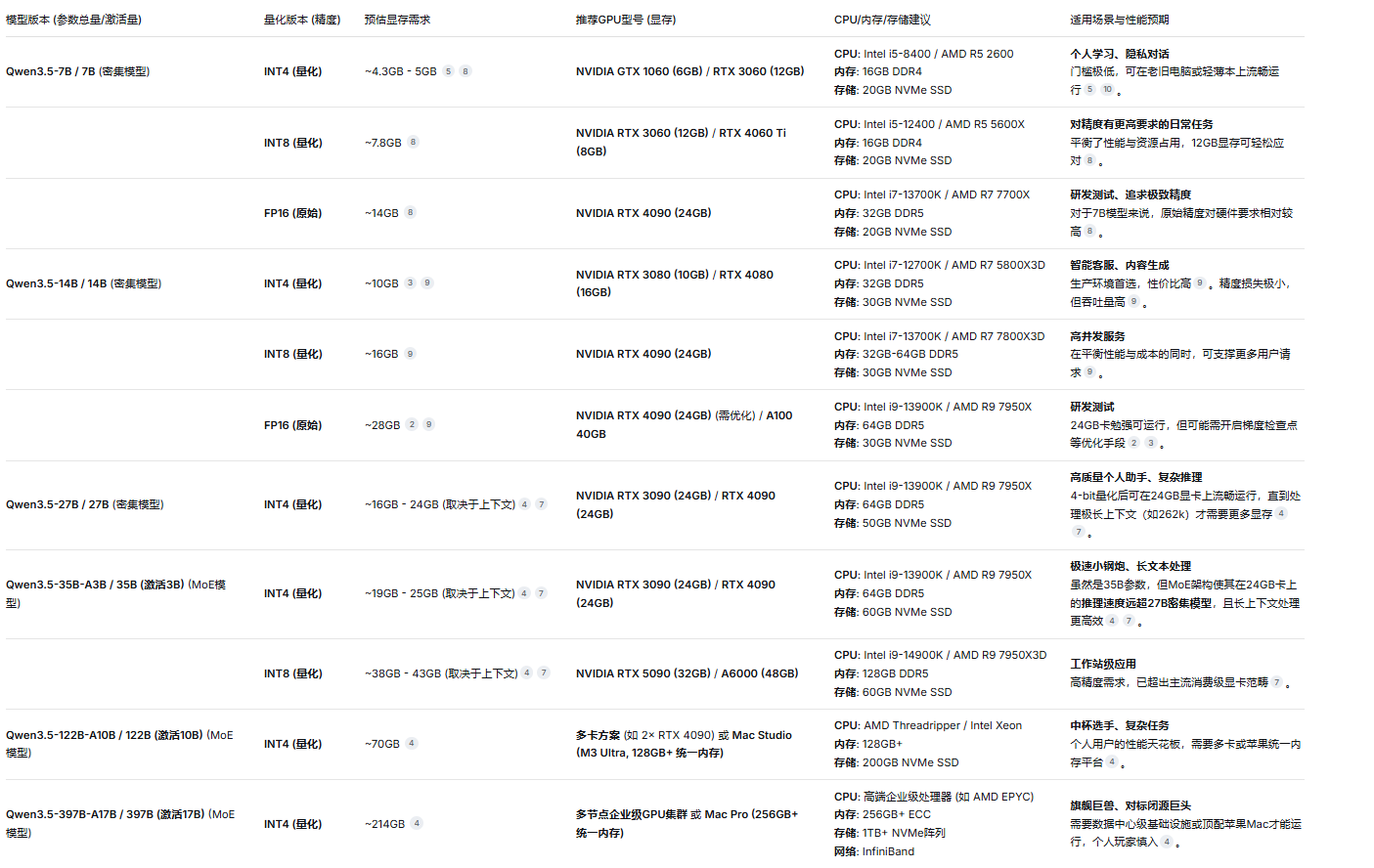

在ollama官网上找到要安装的大模型以及版本,通常情况需要看自己的电脑配置,有没有独显,集体可参考如下:

轻量型模型

其他高板模型

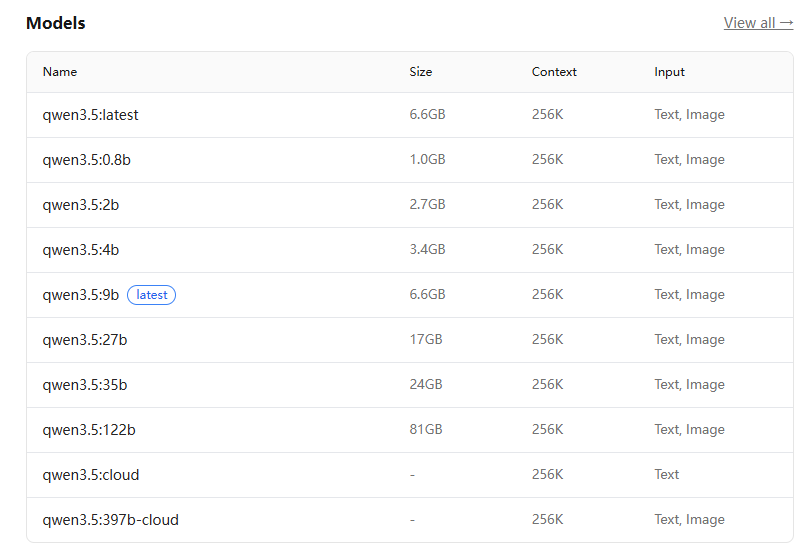

需要更大模型的自行去查一下需要的电脑配置,因本地GPU资源有限,因此安装量化版本,以下以qwen3.5:27b的量化模型记性演示;

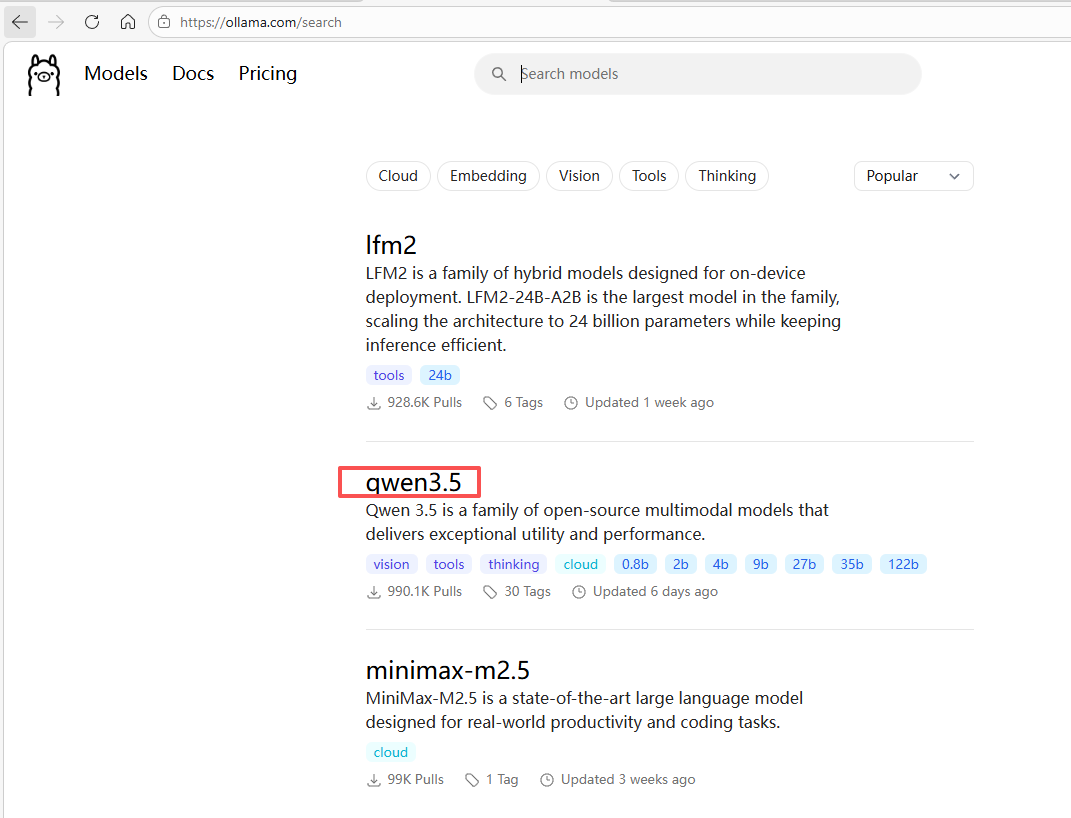

ollama网站:Ollama 参看需要安装的模型的相关的指令;

选择qwen3.5:27B

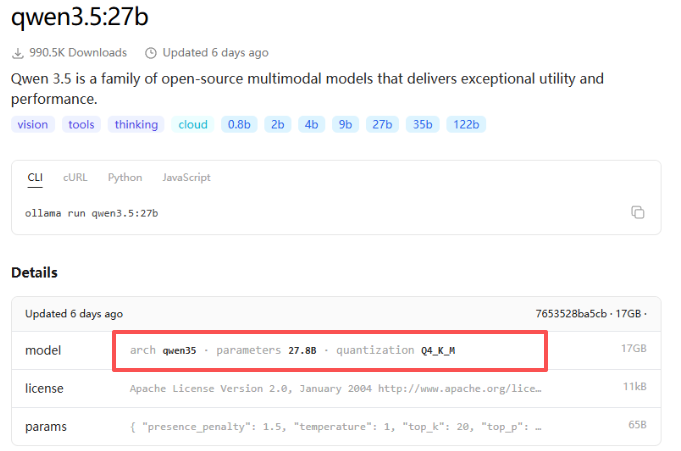

选择量化模型

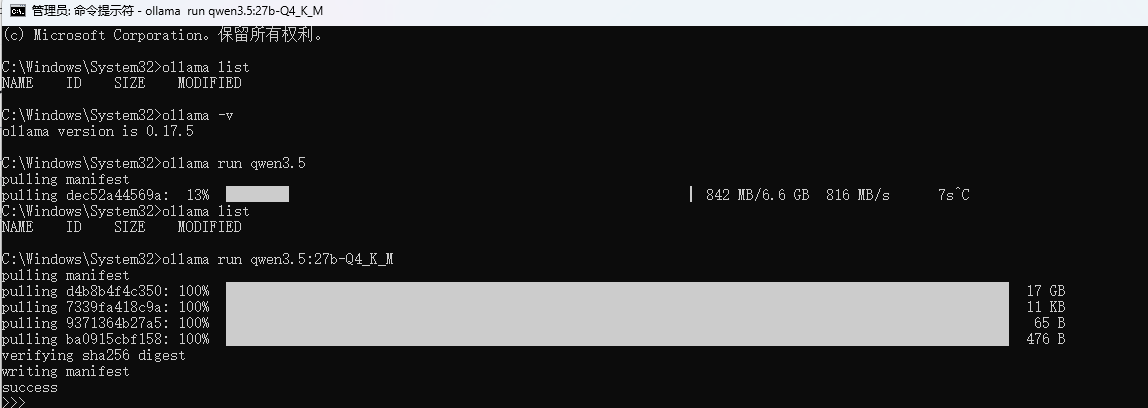

安装qwen3.5执行指令:ollama run qwen3.5:27b-Q4_K_M

开始安装

等待安装完成

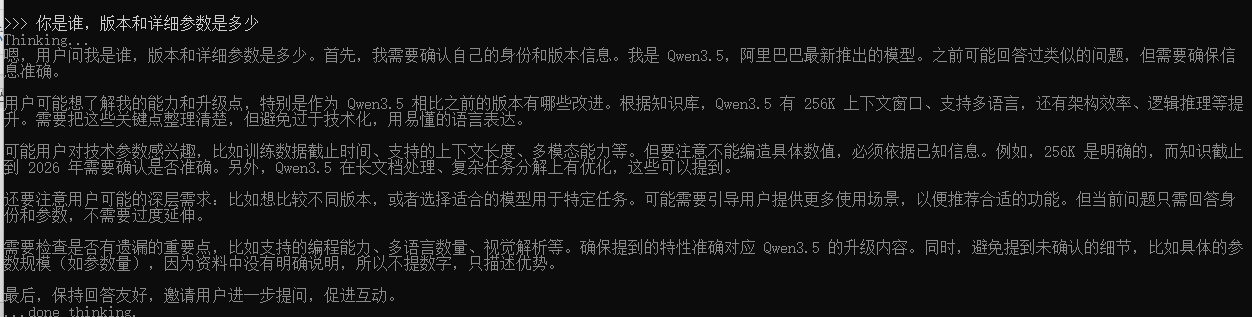

安装完成可以直接输出问题进行测试

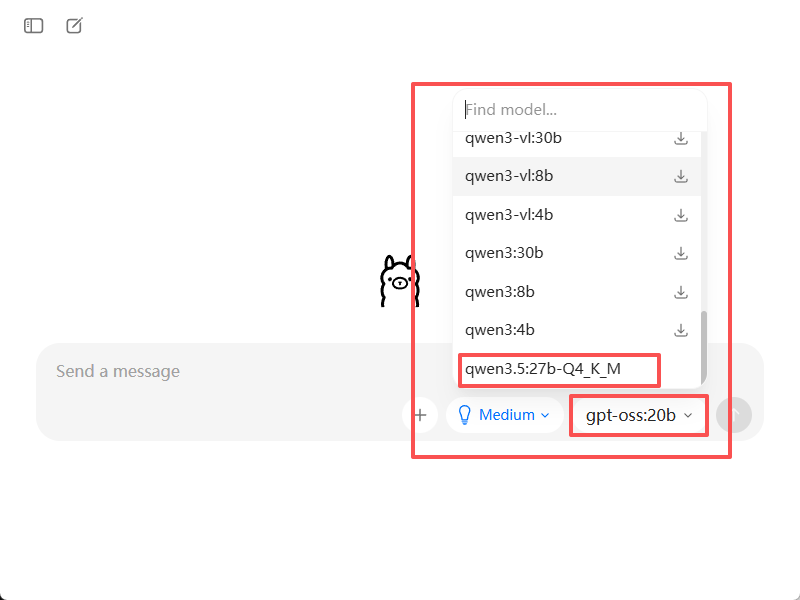

安装完成;此时可以在ollama中切换大模型了;

4.安装openclaw

使用管理员权限打开cmd

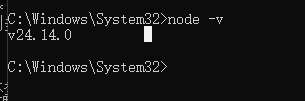

本次安装使用npm,先检查node环境,node的版本需要在24以上:node -v

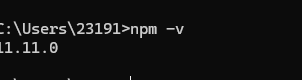

检查环境:npm –v

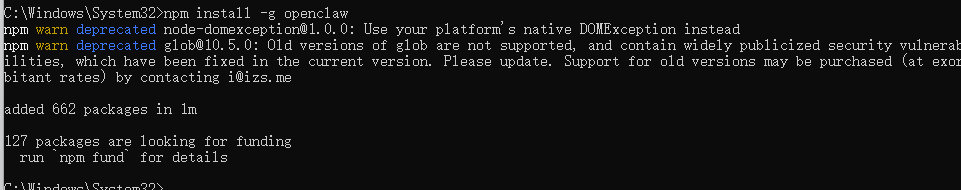

安装openclaw,执行指令:npm install -g openclaw

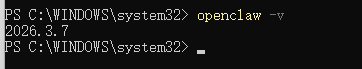

检查安装:openclaw -v

另外一种安装方式,官网推荐的:

管理员运行:powershell

执行:iwr -useb https://openclaw.ai/install.ps1 | iex

此处不在尝试;

5.打开openclaw向导

执行指令:openclaw onboard,启动openclaw配置向导,以下是向导的每一步选择:

| 选择项 | 你的选择 | 功能说明 |

|---|---|---|

| Onboarding mode | Manual | 手动配置模式,让你自定义端口、网络、Tailscale和认证选项 |

| Config handling | Update values | 更新现有配置,而不是从头创建新配置 |

| What to set up | Local gateway | 在本机设置网关,检测到已有服务在 ws://127.0.0.1:18789 |

| Workspace directory | C:\Users\23191\.openclaw\workspace |

工作区目录,存储配置、缓存和插件数据 |

| Model/auth provider | Custom Provider | 使用自定义的API提供商(兼容OpenAI/Anthropic) |

| API Base URL | http://127.0.0.1:11434/v1 |

关键配置:指向本地 Ollama 服务(默认端口11434) |

| API Key 提供方式 | Paste API key now | 手动输入API密钥 |

| API Key | [空] |

本地模型无需API密钥,直接回车跳过即可 |

| Endpoint compatibility | OpenAI-compatible | 使用OpenAI兼容的API格式(/chat/completions接口) |

| Model ID | qwen3.5:27b-Q4_K_M |

你选择的模型:Qwen3.5 27B 的 Q4_K_M 量化版本 |

| Endpoint ID | custom-127-0-0-1-11434 |

端点标识符,用于在配置中区分多个端点 |

| Gateway port | 18789 | 网关服务监听的本地端口 |

| Gateway bind | Loopback (127.0.0.1) | 仅绑定到本地回环地址(只能本机访问,更安全) |

| Gateway auth | Token | 使用令牌进行认证(本地+远程的推荐默认值) |

| Tailscale exposure | Off | 不通过Tailscale暴露服务(保持本地访问) |

| Gateway token 提供方式 | Generate/store plaintext token | 生成/存储明文令牌(默认方式) |

| Gateway token | ollama |

你设置的网关认证令牌 |

| Configure chat channels | No | 暂时不配置聊天频道 |

| Search provider | Skip for now | 暂时跳过搜索引擎配置 |

| Configure skills | Yes | 配置技能(插件/扩展功能) |

| Install missing skill dependencies | Skip for now | 暂时不安装缺失的技能依赖 |

| GOOGLE_PLACES_API_KEY | No | 不配置Google Places API(用于地点查询技能) |

| GEMINI_API_KEY | No | 不配置Gemini API(用于nano-banana-pro技能) |

| NOTION_API_KEY | No | 不配置Notion API(用于notion集成技能) |

| OPENAI_API_KEY | No | 不配置OpenAI API(用于图像生成技能) |

| OPENAI_API_KEY (第二次) | No | 不配置OpenAI API(用于Whisper语音转文字技能) |

| ELEVENLABS_API_KEY | No | 不配置ElevenLabs API(用于语音合成技能) |

| Enable hooks | Skip for now | 暂时不启用钩子(自动化脚本功能) |

| Install Gateway service | Yes | 安装网关服务(作为系统服务运行) |

| Gateway service runtime | Node | 使用Node.js运行时运行网关(推荐) |

| Gateway service already installed | Restart | 服务已存在,选择重启 |

| How to hatch your bot | Open the Web UI | 完成配置后自动打开Web界面 |

| Enable zsh shell completion | No | 不启用zsh命令行补全功能 |

可以看到网页版窗口已打开;至此openclaw已配置完成,

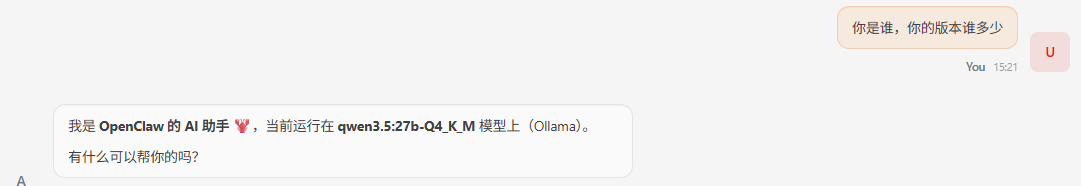

# 启动 openclaw +qwen3.5:27b-Q4_K_M

指令:ollama launch openclaw --model qwen3.5:27b-Q4_K_M

以上基本openclaw+本地模型以配置完成,接下来配置最重要的skills,下一篇讲解常规skill的配置和常用的skill说明,以及实操。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)