如何选取Bert输出层的维度

bert

TensorFlow code and pre-trained models for BERT

项目地址:https://gitcode.com/gh_mirrors/be/bert

·

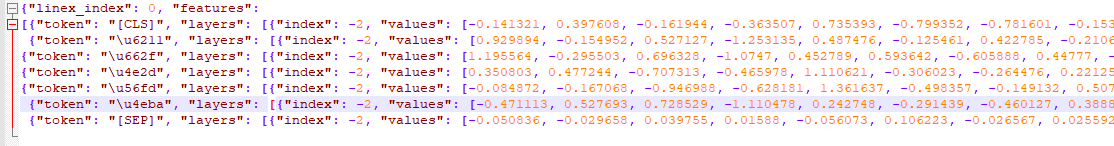

尝试了bert的-2层每个sentence被转化为128768 = 98304维的向量;-1层,每个sentence 被转化为7 768维向量

尝试了后接轻量网络的维度设置 ,50维和10维

bert

TensorFlow code and pre-trained models for BERT

项目地址:https://gitcode.com/gh_mirrors/be/bert

TensorFlow code and pre-trained models for BERT

最近提交(Master分支:7 个月前 )

eedf5716

Add links to 24 smaller BERT models. 5 年前

8028c045 - 5 年前

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)