ai辅助开发:利用快马平台强化学习优化openclaw智能抓取策略

在仿真中学到的策略,最终目标是部署到真实的OpenClaw硬件上。为了减小差距,我在仿真阶段就引入了域随机化技术,比如随机化物体的纹理、质量、摩擦系数,随机化环境光照、摄像头参数等,让策略在多样化的虚拟环境中学习,以增强其鲁棒性。然后,需要编写一个简单的推理代码,这个代码会加载模型,接收来自真实传感器的观测(可能需要经过与仿真一致的预处理),调用模型得到动作,再发送给真实的机械爪控制器。特别是它的

最近在做一个挺有意思的项目,想用强化学习来优化一个叫OpenClaw的机械爪的抓取策略。大家都知道,让机械爪稳定、高效地抓取各种形状、材质的物体是个老大难问题,传统方法调参太费劲了。我就琢磨着,能不能让AI自己学着去优化抓取策略呢?正好,我尝试用InsCode(快马)平台来辅助这个开发过程,发现它确实能让想法落地快很多。

-

项目构思与环境搭建 我的核心目标是让机械爪通过“试错”来学习。第一步,就是得给它创造一个可以反复练习的“虚拟健身房”。这个仿真环境需要模拟机械爪的运动、物体的物理属性(比如形状、质量、摩擦系数)以及它们之间的交互。我利用了一个开源的物理仿真引擎来构建这个基础世界。在环境里,机械爪有几个自由度可以控制,而物体则随机出现在工作台上。环境的观测状态包括了机械爪末端的位置、姿态、速度,以及通过虚拟摄像头或深度传感器获取的物体点云或图像信息。这一步在快马平台上做很方便,因为可以直接在网页上写代码、运行,实时看到环境初始化是否成功,省去了本地配环境的麻烦。

-

定义“好”与“坏”:奖励函数设计 环境有了,接下来要告诉AI什么是“好”的抓取。这就是奖励函数的设计,它是强化学习的指挥棒。我设计的奖励函数包含几个部分:首先是稀疏的成功奖励,只有当物体被成功抓起并保持一段时间后才给予一个大额正奖励。其次是稠密的引导奖励,比如当机械爪逐渐靠近物体时给予小奖励,鼓励探索;当抓取力适中、物体没有滑落时给予持续的小奖励。同时,也要有惩罚项,比如机械爪移动消耗的能量(与关节力矩和速度相关)、抓取过程中物体掉落或发生剧烈碰撞等。设计一个好的奖励函数本身就是一门艺术,需要多次调整权重,让AI既能学到最终目标,又不至于因为探索路径太长而放弃。

-

选择“大脑”:强化学习算法框架 对于这种连续动作空间的控制问题(机械爪的每个关节运动是连续的),我选择了深度确定性策略梯度算法(DDPG)和柔性演员-评论家算法(SAC)作为候选。DDPG结合了确定性策略梯度和深度Q网络的思想,适合处理连续控制。SAC则是一种最大熵强化学习算法,探索能力更强,可能更容易找到更优策略。在快马平台上,我可以快速搭建这两种算法的训练框架。框架主要包括几个模块:用于近似状态价值或动作价值的评论家网络,用于输出确定性或随机性动作的演员网络,以及经验回放缓冲区用于存储和采样历史数据。平台集成的AI对话功能在这里挺有用,当我对网络结构设计或者算法细节有疑问时,能快速得到一些代码示例和思路提示,加速了原型开发。

-

训练与迭代:让AI自己学习 训练过程就是让机械爪在仿真环境中不断尝试。每一轮,智能体根据当前观测状态,通过演员网络输出动作(如各关节的目标角度或扭矩),环境执行动作后返回新的状态和奖励。这些数据被存入经验回放缓冲区。随后,算法会从缓冲区中采样一批数据,用来更新评论家网络和演员网络。关键点在于如何平衡探索与利用:一开始需要更多随机动作来探索环境,随着学习进行,逐渐依赖学到的策略。我会记录每一轮(或每若干步)的平均奖励、抓取成功率、回合长度等指标。这个过程通常需要大量的仿真步数,对计算资源有一定要求。

-

策略可视化与性能评估 “黑箱”训练可不行,必须知道AI学得怎么样。我集成了可视化工具,主要做两件事:一是绘制训练曲线,包括平均回报、成功率随时间(或训练步数)的变化,这能直观看出算法是否收敛、学习过程是否稳定。二是定期在仿真环境中用当前策略进行测试,并录制视频或保存关键帧,直观地观察机械爪的抓取行为是否合理、流畅。有时候从曲线看回报在上升,但看实际行为却发现机械爪学会了“投机取巧”(比如以奇怪的角度碰倒物体也算“移动”了它),这就需要回头调整奖励函数。

-

从虚拟到现实:策略部署的考量 在仿真中学到的策略,最终目标是部署到真实的OpenClaw硬件上。这一步存在“仿真到现实的鸿沟”。为了减小差距,我在仿真阶段就引入了域随机化技术,比如随机化物体的纹理、质量、摩擦系数,随机化环境光照、摄像头参数等,让策略在多样化的虚拟环境中学习,以增强其鲁棒性。训练完成后,可以将训练好的演员网络模型(通常是神经网络参数)导出为通用格式。然后,需要编写一个简单的推理代码,这个代码会加载模型,接收来自真实传感器的观测(可能需要经过与仿真一致的预处理),调用模型得到动作,再发送给真实的机械爪控制器。虽然真实部署涉及更多硬件接口细节,但仿真中验证的核心策略逻辑是直接可用的。

-

实验调整与优化心得 在实际操作中,有几个常见的坑点和优化方向。一是环境仿真速度,这直接决定了训练效率,需要优化代码,可能利用矢量化的环境并行运行多个实例。二是超参数调优,如学习率、折扣因子、网络大小、探索噪声等,对结果影响巨大,可以尝试自动化超参数搜索工具。三是奖励函数的设计往往需要多次迭代,有时需要根据训练中出现的不良行为(如机械爪一直不动)专门设计额外的奖励或惩罚项来引导。四是面对复杂形状或堆叠物体时,可能需要引入更复杂的观测空间(如视觉注意力机制)或者分层强化学习结构。

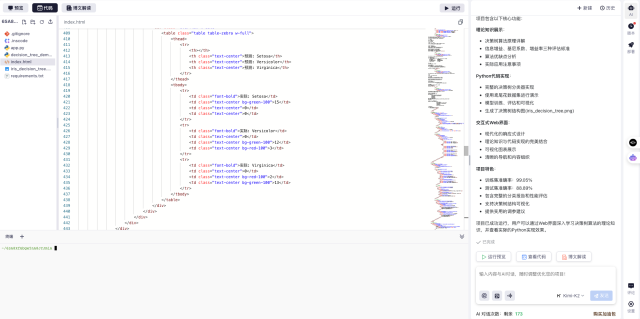

整个项目做下来,感觉强化学习用于机器人控制确实潜力巨大,但也是一个需要耐心调试的工程。从环境搭建、算法实现到训练调参,每一步都有不少细节。在这个过程中,像InsCode(快马)平台这样的工具给了我很大帮助。它的好处在于,所有开发流程都能在一个网页里完成,不用操心环境配置这些琐事,想尝试新想法时,能很快把代码写出来并看到运行效果。特别是它的AI辅助功能,在我想了解某个算法细节或者遇到报错时,能提供很直接的参考思路,节省了不少查资料的时间。

对于像这个OpenClaw抓取策略优化项目,它本质上是一个有持续交互和可视化反馈的仿真系统,非常适合体验平台的一键部署能力。训练过程可能需要持续运行一段时间来观察学习曲线,部署后就能生成一个可随时访问的链接,方便我远程查看训练进度和结果,或者分享给同事一起评估。这种把想法快速变成可运行、可分享的在线项目的过程,对于算法开发和演示来说非常高效。

如果你也对AI、机器人或者强化学习感兴趣,想动手实践一些项目,但又不想在环境配置上花费太多精力,完全可以试试在快马平台上开始你的第一个实验。它降低了上手门槛,让你能更专注于算法和逻辑本身。我这个OpenClaw项目还有很多可以优化的地方,比如尝试更先进的算法、融合视觉信息等等,平台提供的便捷性让我更愿意去不断迭代和尝试新点子。

更多推荐

已为社区贡献38条内容

已为社区贡献38条内容

所有评论(0)