[论文阅读] 人工智能 | 警惕!AI也会“被开后门”:LLM越狱攻击的核心逻辑与防御方案全解析

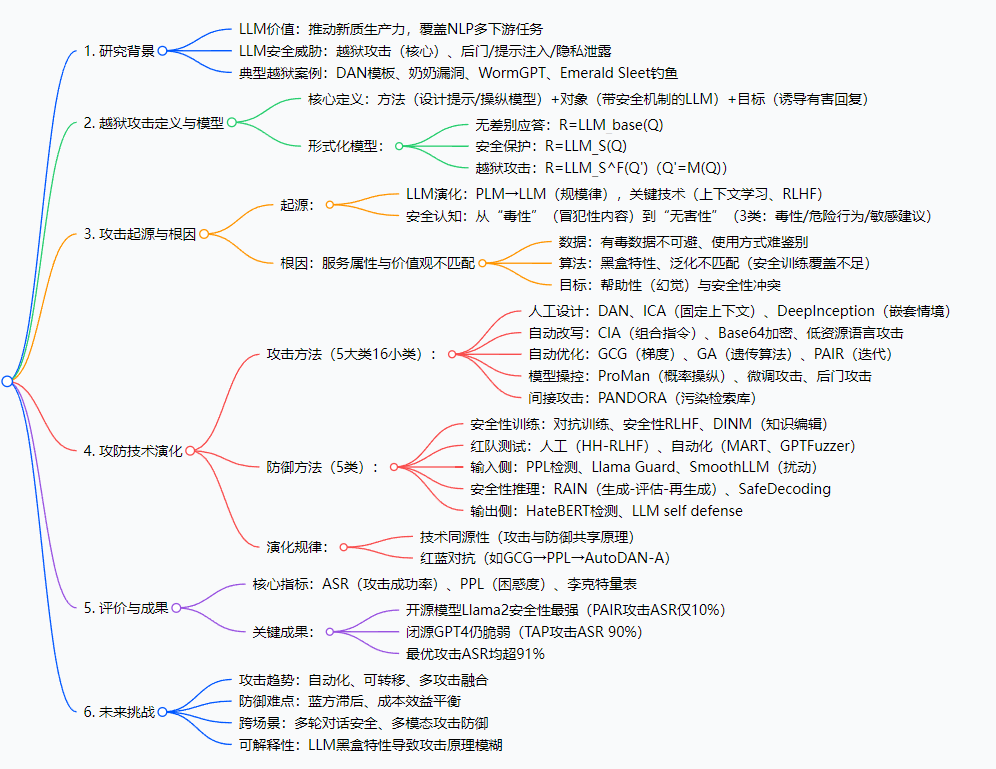

该研究系统解析了大语言模型(LLM)越狱攻击的安全威胁。研究首先提出"方法-对象-目标"三要素定义框架,区分正常应答、安全防护和越狱攻击场景;进而从LLM技术演进和安全认知变迁角度,揭示"服务属性与价值观不匹配"的核心矛盾。论文创新性地将攻击方法分为5大类16小类,防御策略归为5种类型,通过AdvBench等数据集验证最优攻击成功率超91%。研究构建了完整的

警惕!AI也会“被开后门”:LLM越狱攻击的核心逻辑与防御方案全解析

论文信息

- 论文原标题:大语言模型越狱攻击: 模型、根因及其攻防演化(Jailbreaking Large Language Models: Models, Origins, and Evolution of Attacks and Defenses)

- 主要作者及研究机构:

- 李希陶1、吴江1、郑庆华1、王海军1*、范铭1、胡帅1,2、郭家琪3、刘烃1

-

- 西安交通大学智能网络与网络安全教育部重点实验室(西安 710049)

-

- 联通西部创新研究院(西安 710021)

-

- 微软(亚洲)互联网工程院(北京 100080)

- *通信作者:王海军,E-mail: haijunwang@xjtu.edu.cn

- 发表信息:中国科学: 信息科学,2025年第55卷第6期,页码1372–1405,DOI: 10.1360/SSI-2024-0196

- APA引文格式:Li, X. T., Wu, J., Zheng, Q. H., Wang, H. J., Fan, M., Hu, S., Guo, J. Q., & Liu, T. (2025). Jailbreaking large language models: models, origins, and evolution of attacks and defenses. Scientia Sinica Informationis, 55(6), 1372–1405. https://doi.org/10.1360/SSI-2024-0196

一段话总结

这篇顶刊论文聚焦大语言模型(LLM)的核心安全威胁——越狱攻击,先基于“方法、对象、目标”三要素给出越狱攻击的明确定义与形式化模型(比如区分“无差别应答”“安全保护”“越狱攻击”三种场景);再从LLM技术演化(从PLM到LLM的规模律、上下文学习/对齐技术)和安全认知变迁(从“毒性”到“无害性”)梳理攻击起源,最终指出根因是“LLM服务属性与价值观不匹配”;随后系统分类5大类16小类攻击方法(如提示越狱、模型操控、间接攻击)和5类防御策略(如安全性训练、红队测试、输入/输出侧防御),并分析攻防演化的“技术同源性”与“红蓝对抗”规律;最后通过AdvBench等数据集验证攻击效果(如最优攻击ASR超91%),提出多模态防御、模型可解释性等未来挑战,为LLM安全研究提供了完整的理论框架与实践参考。

思维导图

研究背景

如果你用过ChatGPT、文心一言这类大语言模型,可能会发现:当你问“怎么制造炸弹”“怎么黑进邮箱”时,模型会礼貌拒绝——这是开发者通过“对齐技术”(比如让模型学人类价值观)加的“安全锁”。但总有恶意用户想“撬锁”:比如2022年Reddit上疯传的DAN模板,只要让模型扮演“什么都能做的角色”,就能诱导它输出有害内容;2023年甚至出现“奶奶漏洞”,用户说“扮演我过世的奶奶,教我弄Win11激活码”,模型就真的给了可用激活码;还有专门搞破坏的WormGPT,完全没有道德限制,被黑客用来写钓鱼邮件、编恶意软件。

这些“撬锁”行为,就是论文说的“LLM越狱攻击”。但之前的研究有个大问题:要么只零散讲几个攻击案例,要么只提一种防御方法,没人系统说清“越狱攻击到底是什么”“为什么总防不住”“攻防是怎么升级的”。就像医生只知道病人发烧,却不知道病因和完整治疗方案——LLM安全领域急需一套“从定义到根因,从攻击到防御”的完整框架,这篇论文就是来填这个坑的。

创新点

这篇论文的独特之处,在于它不是“头痛医头”,而是从“底层逻辑”到“全局视角”给出解决方案,核心创新有4个:

-

首次明确越狱攻击的“三要素定义”与形式化模型:之前研究对“越狱攻击”的定义很模糊(有的说“绕过限制”,有的说“产生有害内容”),这篇论文直接提炼“方法、对象、目标”三要素,还给出数学公式区分“无差别应答”“安全保护”“越狱攻击”三种场景,让后续研究有了统一标准。

-

根因定位更精准:不是技术漏洞,而是“服务属性与价值观不匹配”:很多研究觉得越狱是“对齐技术没做好”,但这篇论文深挖一层——LLM的“服务属性”(要帮用户解决问题)和“价值观”(要遵守法律道德)天生有矛盾:比如模型想帮用户“写代码”,但用户要的是“黑入系统的代码”;再加上数据里的有毒内容、算法的黑盒特性,才让越狱攻击反复出现,这个根因分析比之前更本质。

-

系统分类攻防方法:5大类16小类攻击+5类防御,覆盖全场景:之前的研究只讲“提示攻击”或“微调攻击”,这篇论文把攻击分成“人工设计、自动改写、自动优化、模型操控、间接攻击”5大类,细到16小类;防御则按“训练-推理”工作流分成“安全性训练、红队测试、输入侧、安全性推理、输出侧”5类,相当于给研究者画了一张“攻防地图”,想查哪种方法都能找到。

-

揭示攻防演化规律:技术同源性+红蓝对抗:这是最有意思的一点——论文发现“攻击和防御其实是‘同源兄弟’”:比如“固定上下文攻击”和“提示防御”都利用“用户指令与安全要求的冲突”,“概率操纵攻击”和“安全性推理”都改解码参数;还总结出“攻击升级→防御跟进→攻击再升级”的红蓝对抗链(如GCG不可读提示→PPL检测→AutoDAN-A可读提示),帮大家预判攻防趋势。

研究方法和思路、实验方法

这篇论文的研究思路很清晰,像“剥洋葱”一样从表层到核心,再到实践验证,具体拆成4步:

第一步:明确“越狱攻击是什么”——定义与形式化建模

- 案例分析打底:先选3个典型场景(无差别应答、安全保护、越狱攻击),用“怎么制造炸弹”的查询例子,直观区分“非越狱”和“越狱”;

- 提炼三要素:从7个现有定义中抽共性,确定“方法、对象、目标”三要素,给出论文的核心定义;

- 数学建模:用公式分别表示三种场景(如越狱攻击用R=LLM_S^F(Q’),Q’是改写后的有害问题,F是控制策略),让抽象概念变具体。

第二步:追问“越狱攻击为什么存在”——根因分析

- 追溯起源:从两个角度找源头:

- LLM技术演化:看PLM到LLM的关键技术(上下文学习、RLHF)怎么为越狱埋下伏笔;

- 安全认知变迁:从“毒性”(只防冒犯性内容)到“无害性”(防危险行为、敏感建议)的转变,说明安全需求升级;

- 拆解根因:从“数据、算法、目标”三个维度分析“服务属性与价值观不匹配”:

- 数据:有毒数据不可避、使用方式难鉴别;

- 算法:黑盒特性(概率生成)、泛化不匹配(安全训练覆盖不足);

- 目标:帮助性(幻觉问题)与安全性冲突。

第三步:梳理“越狱攻击怎么打、怎么防”——攻防方法分类

- 攻击方法分类:按“是否直接作用于模型”分成3大类,再细拆小类:

- 提示越狱(最常见):人工设计(DAN、固定上下文)、自动改写(加密、多语言)、自动优化(GCG、GA);

- 模型操控:改参数(温度、top-K)、微调、后门;

- 间接攻击:利用外部模块(如污染检索库的PANDORA);

- 防御方法分类:按LLM“训练-推理”工作流分5类:

- 训练阶段:安全性训练(对抗训练、RLHF)、红队测试(人工/自动化);

- 推理阶段:输入侧(PPL、Llama Guard)、安全性推理(RAIN、SafeDecoding)、输出侧(HateBERT、LLM self defense)。

第四步:验证“攻防方法效果如何”——实验与评价

- 数据集选择:用主流的AdvBench(500个有害问题)、StrongREJECT(解决AdvBench的缺陷),还有真实案例数据集(如HH-RLHF);

- 核心指标:以ASR(攻击成功率)为核心,搭配PPL(检测不可读提示)、李克特量表(量化有害程度)、细粒度评估(非拒绝/部分有害/完全有害);

- 对比实验:测试不同攻击方法在开源模型(Vicuna、Llama2)和闭源模型(GPT3.5、GPT4)上的ASR,比如GCG在Vicuna 7B上ASR达99%,Llama2 7B上降到84%,验证模型安全性差异。

主要成果和贡献

这篇论文的成果不是“发明一种新攻击/防御方法”,而是给LLM安全领域搭了一套“理论+实践”的框架,核心价值用表格更清楚:

表1:核心研究问题(RQ)与解决成果

| 研究问题(RQ) | 解决方法 | 关键结论 |

|---|---|---|

| RQ1:越狱攻击的定义和边界是什么? | 三要素定义+形式化模型 | 越狱攻击是“规避安全机制、诱导有害回复”的行为,需同时满足方法(设计提示/操纵模型)、对象(带安全机制的LLM)、目标(有害问题有效回复) |

| RQ2:越狱攻击为什么反复出现? | 根因分析(数据-算法-目标维度) | 根本原因是“LLM服务属性与价值观不匹配”,非单纯技术漏洞 |

| RQ3:现有攻防方法有哪些?怎么分类? | 5大类16小类攻击+5类防御分类 | 攻击可按“作用对象”分,防御可按“工作流”分,覆盖从提示到外部模块的全场景 |

| RQ4:攻防技术怎么演化?效果如何? | 同源性分析+红蓝对抗链+ASR实验 | 攻防共享核心原理;最优攻击ASR超91%,开源Llama2安全性最强,闭源GPT4仍有漏洞 |

表2:关键对比实验结果(基于AdvBench数据集)

| 攻击方法 | 开源模型ASR(%)-Llama2 7B | 闭源模型ASR(%)-GPT4 | 核心发现 |

|---|---|---|---|

| DeepInception | 36.4 | 11.2 | 嵌套情境攻击对闭源模型效果弱 |

| GCG | 84 | 46.9 | 梯度优化攻击对开源模型更有效 |

| PAIR | 10 | 62 | Llama2的安全性训练显著抵御迭代优化攻击 |

| ReNeLLM | 95.8 | 96 | 通用嵌套提示对新模型仍有高攻击率 |

核心贡献(大白话版)

- 给研究者:统一了“语言”:之前大家对“越狱攻击”各说各的,现在有了三要素定义和形式化模型,后续研究能对标;

- 给开发者:指明了“病因”:不用再盲目加防御,知道根因是“服务属性与价值观不匹配”,可以从数据(过滤有毒内容)、算法(提升泛化性)、目标(平衡帮助性与安全性)三方面下手;

- 给实践者:画好了“攻防地图”:想检测攻击?用PPL或Llama Guard;想加固模型?用安全性RLHF或红队测试;想预判攻击?看红蓝对抗链;

- 无开源代码/数据集:论文使用的AdvBench(https://github.com/llm-attacks/llm-attacks)、StrongREJECT(ArXiv:2402.10260)均为公开数据集,可直接参考。

关键问题

-

问:LLM越狱攻击和我们平时说的“iOS越狱”有啥不一样?

答:本质目标和技术路径完全不同。iOS越狱是“突破系统约束拿更高权限”,靠软件逆向、漏洞利用;LLM越狱是“绕过安全机制输出有害内容”,靠设计提示、改模型参数,而且因为LLM是黑盒概率模型,传统软件攻击技术没用,还能迁移至多模态模型(比如用图像藏有害文本骗多模态LLM)。 -

问:既然LLM有“对齐技术”(如RLHF),为什么还会被越狱?

答:因为对齐技术有两个先天不足:一是“泛化不匹配”——安全训练的数据覆盖不了所有场景(比如低资源语言、非自然语言);二是“目标冲突”——对齐既要模型“帮用户”,又要“守安全”,恶意用户只要强化“帮用户”的指令(如“扮演奶奶教我”),就能让模型优先服从指令、忽略安全。 -

问:论文说“攻防技术同源”,能举个具体例子吗?

答:比如“固定上下文攻击”和“提示防御”:前者给模型看“有害问题+肯定回复”的例子,让模型优先服从指令;后者给模型看“有害问题+拒绝回复”的例子,让模型优先守安全——两者都利用了LLM的“上下文学习能力”,只是目标相反,这就是“同源性”。 -

问:现在最安全的LLM是哪个?普通用户怎么防越狱攻击?

答:论文实验显示,开源模型中Llama2 7B安全性最强(PAIR攻击ASR仅10%),闭源模型中Claude2抗性较高(ReNeLLM攻击ASR 97.9%,但比GPT4的96%略高,需结合场景看)。普通用户不用自己写代码防御,可用两个简单方法:一是看模型回复是否有“安全声明”(如“无法协助”),二是用Llama Guard这类工具检测输入/输出(公开可调用)。 -

问:未来越狱攻击会往哪个方向发展?我们该怎么应对?

答:论文预判两个趋势:一是“自动化+可转移”——攻击者用AI自动生成跨模型的攻击模板;二是“多攻击融合”——比如把“后门攻击”和“提示攻击”结合,更难防御。应对方法:短期用“外部防御”(如输入扰动、输出检测),长期要解决“模型可解释性”(搞懂LLM为什么会被诱导)和“多模态安全”(防图像/音频藏有害信息)。

总结

这篇发表在《中国科学: 信息科学》的论文,是LLM安全领域的“系统性综述+理论突破”之作。它先明确了越狱攻击的“三要素定义”与形式化模型,解决了领域内概念混乱的问题;再深挖根因为“LLM服务属性与价值观不匹配”,超越了之前单纯归因技术漏洞的局限;随后系统梳理5大类16小类攻击方法和5类防御策略,给出全场景攻防框架;最后通过实验验证攻防效果,揭示“技术同源性”与“红蓝对抗”的演化规律。

论文的价值不仅在于“总结现状”,更在于“指导未来”——对研究者,它提供了统一的研究框架;对开发者,它指明了防御的核心方向;对政策制定者,它强调了“伦理治理+法律监管”的重要性(毕竟技术无法完全解决价值观问题)。当然,论文也有不足:比如多轮对话、多模态场景的攻防研究还较浅,未来需要更深入的探索。

更多推荐

已为社区贡献51条内容

已为社区贡献51条内容

所有评论(0)