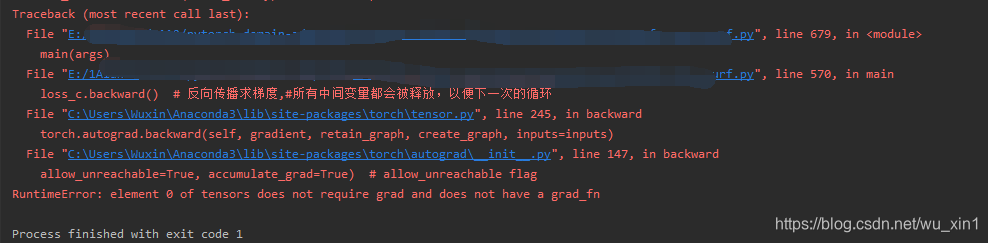

RuntimeError: element 0 of tensors does not require grad and does not have a grad_fn

RuntimeError: element 0 of tensors does not require grad and does not have a grad_fn出错位置:loss = loss1 + loss2........loss.backward()原因: 这里的loss默认的requires_grad是False,因此在backward()处不会计算梯度,导致出错方法:将loss的

一键AI生成摘要,助你高效阅读

问答

·

RuntimeError: element 0 of tensors does not require grad and does not have a grad_fn

出错位置:

loss = loss1 + loss2

........

loss.backward()

原因: 这里的loss默认的requires_grad是False,因此在backward()处不会计算梯度,导致出错

方法:将loss的requires_grad属性设为True,如下所示:

loss = loss1 + loss2

loss.requires_grad_(True) #加入此句就行了

........

loss.backward()

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)