yolo入门之一----yolo的使用

主要参考了此链接,对此博主表示感谢~!!https://blog.csdn.net/u012746060/article/details/81183006但其中有一些不同之处,在这里从头到尾走一遍流程二、快速使用1、下载yolov3代码:https://github.com/qqwweee/keras-yolo3 ,并解压缩之后用pycharm打开。2、下载权重:https://pjre...

主要参考了此链接,对此博主表示感谢~!!

https://blog.csdn.net/u012746060/article/details/81183006

但其中有一些不同之处,在这里从头到尾走一遍流程

二、快速使用

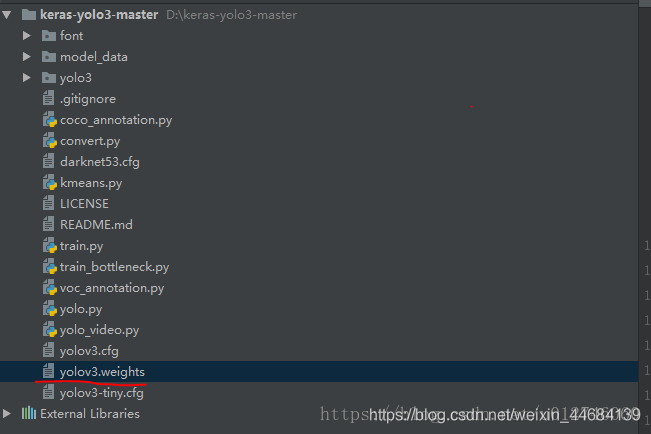

1、下载yolov3代码:https://github.com/qqwweee/keras-yolo3 ,并解压缩之后用pycharm打开。

2、下载权重:https://pjreddie.com/media/files/yolov3.weights并将权重直接放在项目文件夹下

然后在命令行中activate tensorflow-gpu

cd 到项目文件夹

3、执行如下命令将darknet下的yolov3配置文件转换成keras适用的h5文件。

python convert.py yolov3.cfg yolov3.weights model_data/yolo.h5

4、运行预测图像程序

python yolo.py

这时候发现没有效果,与原博主写本不一样,因此我们尝试输入

python yolo_video.py --image

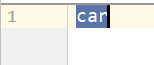

发现有效果,并且提示输入一张图片,我们输入准备好的项目文件夹下的test1.jpg

发现准确识别了,但是会受到原有像素影响,识别框不太清晰

如果想输入视频,也是cd到位以后输入:

python yolo_video.py --input C:\Users\MJY\PycharmProjects\yolo_test\test2.mp4

也就是–input后输入自己想输入的视频路径

那么如何使用yolo识别我们自己想要的东西呢?

接下来介绍详细步骤

由于原博主使用的是2007,我用的2012,没有关系是一样的,有些文件名大家对这看就行

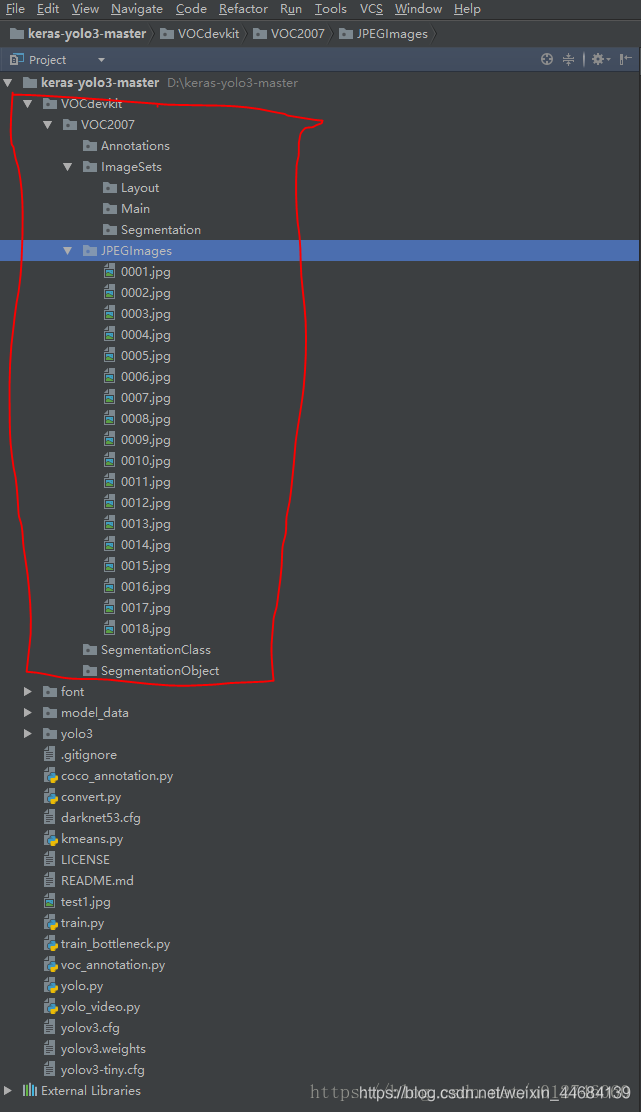

一、新建文件夹并放置数据集图片

在工程下新建一个文件夹VOCdevkit,目录结构为VOCdevkit/VOC2007/,在下面就是新建几个默认名字的文件夹 Annotation,ImageSet(该目录还有三个文件需要建立),JPEGImages(把你所有的图片都复制到该目录里面,如下图),SegmentationClass,SegmentationObject。

二、使用LabelImage创建标签进行标注

按照这篇文章下载好LabelImage

https://blog.csdn.net/u012746060/article/details/81016993

下载好LabelImage后会有一个文件夹叫做labelImg-master,将其放置在项目文件夹下

然后打开cmd,cd到项目文件夹目录(也就是含有labelImg-master的目录)

接下来在命令行输入activate tensorflow-gpu

当然了,前面那几个包你装在什么环境下你就激活什么环境

接下来在命令行输入pyrcc5 -o resources.py resources.qrc 回车

再输入python labelImg.py回车

即可打开labelImg软件窗口如下

在左侧先修改Change Save Dir 为C:\Users\MJY\PycharmProjects\yolo_10.01\VOCdevkit\VOC2012\Annotations

再修改Open dir为 你数据集所在位置

C:\Users\MJY\PycharmProjects\yolo_10.01\VOCdevkit\VOC2012\JPEGImages

然后你会发现打开了第一张图片(如图所示)

然后再设定标签 因为我这里只训练了一类,先快速训练玩一玩

所以我在右侧 Use default label 中输入了people

接下来就可以进行数据集的标注了

点击左侧Create\nRectBox(或按W键),然后在上面框出检测对象即可,再点击Save(或ctrl+s)

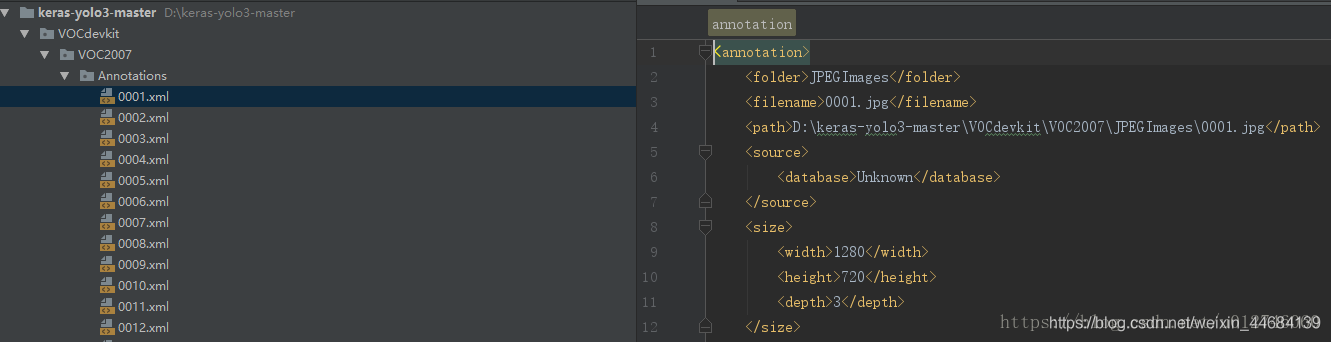

然后你会发现在

C:\Users\MJY\PycharmProjects\yolo_10.01\VOCdevkit\VOC2012\Annotations

路径下 多了很多xml文件,这就是你的标签文件,如下图

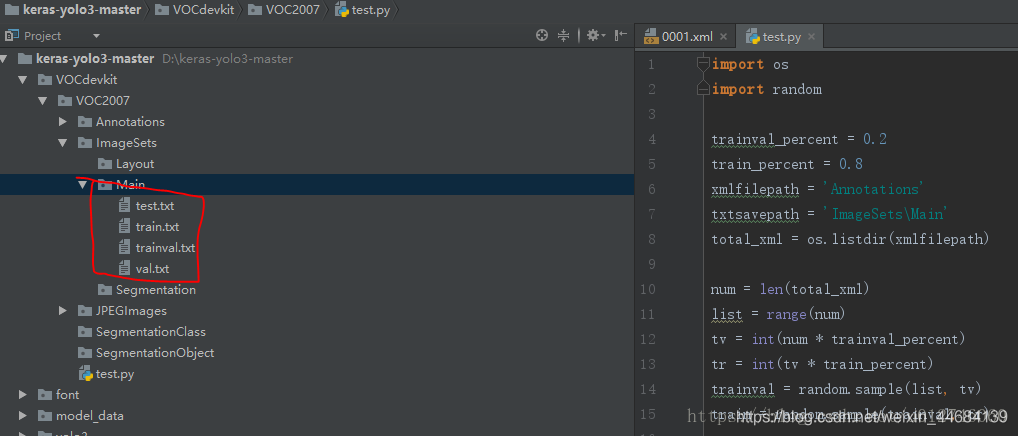

三、生成数据集

然后在C:\Users\MJY\PycharmProjects\yolo_10.01\VOCdevkit\VOC2012

目录下新建一个.py文件,代码如下:

import os

import random

trainval_percent = 0.1

train_percent = 0.9

xmlfilepath = 'Annotations'

txtsavepath = 'ImageSets\Main'

total_xml = os.listdir(xmlfilepath)

num = len(total_xml)

list = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list, tv)

train = random.sample(trainval, tr)

ftrainval = open('ImageSets/Main/trainval.txt', 'w')

ftest = open('ImageSets/Main/test.txt', 'w')

ftrain = open('ImageSets/Main/train.txt', 'w')

fval = open('ImageSets/Main/val.txt', 'w')

for i in list:

name = total_xml[i][:-4] + '\n'

if i in trainval:

ftrainval.write(name)

if i in train:

ftest.write(name)

else:

fval.write(name)

else:

ftrain.write(name)

ftrainval.close()

ftrain.close()

fval.close()

ftest.close()

然后运行,你会发现在C:\Users\MJY\PycharmProjects\yolo_10.01\VOCdevkit\VOC2012\ImageSets\Main

目录下产生了四个txt文件夹

但是这四个txt并不能为yolo所用

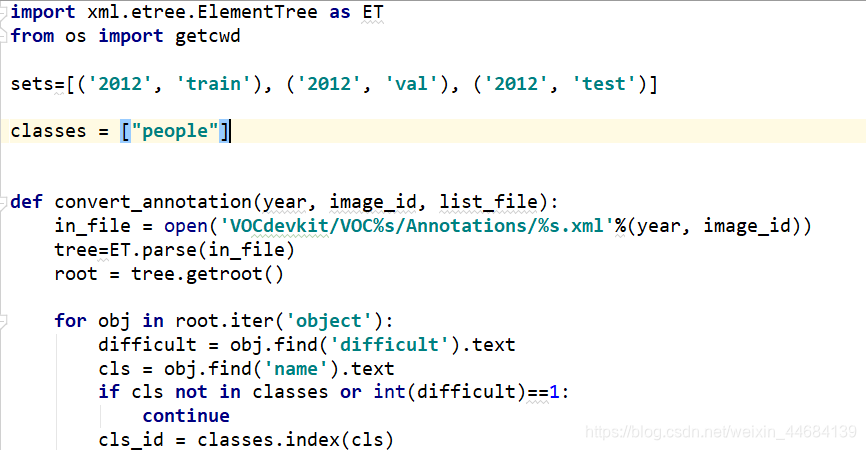

需要修改并运行voc_annotation.py 。首先是classes这里,本例只有一种people。

展示给大家 在voc_annotation.py需要修改的地方:

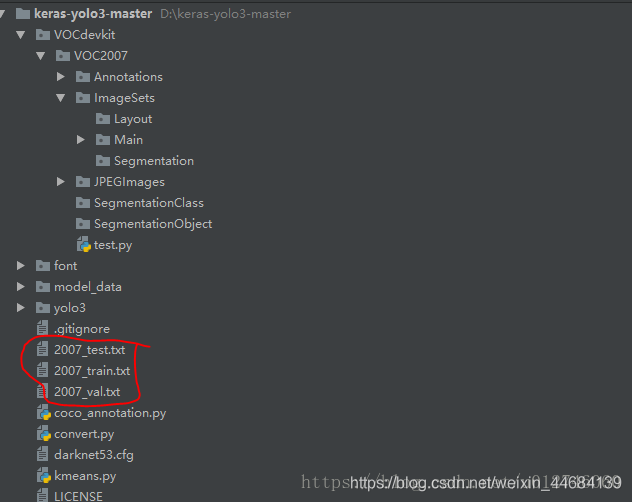

然后运行,你会发现在最大的项目文件夹下产生了三个txt文件

四、更改yolov3配置

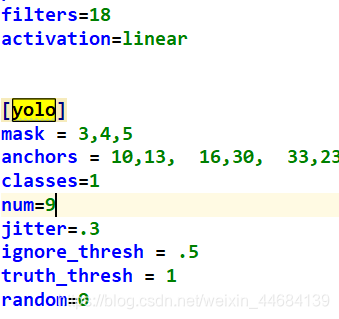

打开 yolo3.cfg 文件,ctrl + f 搜索yolo,发现共3次,每一次都要如下修改

① 先看最上面的filters

要将之改为 3 * (len(classes) + 1) 那么我这里只有一类,因此为3*6=18

②classes要改为自己的类别数,我这里是1

③random可以改小为0(如果电脑显存小的话)

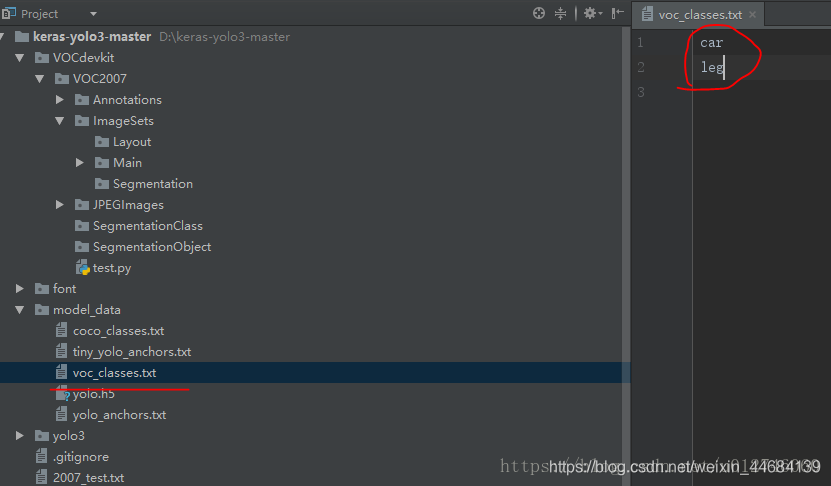

接下来修改model_data下的voc_classes.txt为自己训练的类别

我这里只有一类

如果是多类的话每一行是一类

我的是

五、修改train.py代码

先附上代码:

"""

Retrain the YOLO model for your own dataset.

"""

import numpy as np

import keras.backend as K

from keras.layers import Input, Lambda

from keras.models import Model

from keras.callbacks import TensorBoard, ModelCheckpoint, EarlyStopping

from yolo3.model import preprocess_true_boxes, yolo_body, tiny_yolo_body, yolo_loss

from yolo3.utils import get_random_data

import tensorflow as tf

import keras.backend.tensorflow_backend as KTF

def _main():

annotation_path = '2012_train.txt'

log_dir = 'logs/000/'

classes_path = 'model_data/voc_classes.txt'

anchors_path = 'model_data/yolo_anchors.txt'

class_names = get_classes(classes_path)

anchors = get_anchors(anchors_path)

input_shape = (416, 416) # multiple of 32, hw

model = create_model(input_shape, anchors, len(class_names) )

train(model, annotation_path, input_shape, anchors, len(class_names), log_dir=log_dir)

def train(model, annotation_path, input_shape, anchors, num_classes, log_dir='logs/'):

model.compile(optimizer='adam', loss={

'yolo_loss': lambda y_true, y_pred: y_pred})

logging = TensorBoard(log_dir=log_dir)

checkpoint = ModelCheckpoint(log_dir + "ep{epoch:03d}-loss{loss:.3f}-val_loss{val_loss:.3f}.h5",

monitor='val_loss', save_weights_only=True, save_best_only=True, period=1)

batch_size = 3

val_split = 0.1

with open(annotation_path) as f:

lines = f.readlines()

np.random.shuffle(lines)

num_val = int(len(lines)*val_split)

num_train = len(lines) - num_val

print('Train on {} samples, val on {} samples, with batch size {}.'.format(num_train, num_val, batch_size))

model.fit_generator(data_generator_wrap(lines[:num_train], batch_size, input_shape, anchors, num_classes),

steps_per_epoch=max(1, num_train//batch_size),

validation_data=data_generator_wrap(lines[num_train:], batch_size, input_shape, anchors, num_classes),

validation_steps=max(1, num_val//batch_size),

epochs=150, # 500 有点多了

initial_epoch=0)

model.save_weights(log_dir + 'trained_weights.h5')

def get_classes(classes_path):

with open(classes_path) as f:

class_names = f.readlines()

class_names = [c.strip() for c in class_names]

return class_names

def get_anchors(anchors_path):

with open(anchors_path) as f:

anchors = f.readline()

anchors = [float(x) for x in anchors.split(',')]

return np.array(anchors).reshape(-1, 2)

def create_model(input_shape, anchors, num_classes, load_pretrained=False, freeze_body=False,

weights_path='model_data/yolo_weights.h5'):

K.clear_session() # get a new session

image_input = Input(shape=(None, None, 3))

h, w = input_shape

num_anchors = len(anchors)

y_true = [Input(shape=(h//{0:32, 1:16, 2:8}[l], w//{0:32, 1:16, 2:8}[l], \

num_anchors//3, num_classes+5)) for l in range(3)]

model_body = yolo_body(image_input, num_anchors//3, num_classes)

print('Create YOLOv3 model with {} anchors and {} classes.'.format(num_anchors, num_classes))

if load_pretrained:

model_body.load_weights(weights_path, by_name=True, skip_mismatch=True)

print('Load weights {}.'.format(weights_path))

if freeze_body:

# Do not freeze 3 output layers.

num = len(model_body.layers)-7

for i in range(num): model_body.layers[i].trainable = False

print('Freeze the first {} layers of total {} layers.'.format(num, len(model_body.layers)))

model_loss = Lambda(yolo_loss, output_shape=(1,), name='yolo_loss',

arguments={'anchors': anchors, 'num_classes': num_classes, 'ignore_thresh': 0.5})(

[*model_body.output, *y_true])

model = Model([model_body.input, *y_true], model_loss)

return model

def data_generator(annotation_lines, batch_size, input_shape, anchors, num_classes):

n = len(annotation_lines)

np.random.shuffle(annotation_lines)

i = 0

while True:

image_data = []

box_data = []

for b in range(batch_size):

i %= n

image, box = get_random_data(annotation_lines[i], input_shape, random=True)

image_data.append(image)

box_data.append(box)

i += 1

image_data = np.array(image_data)

box_data = np.array(box_data)

y_true = preprocess_true_boxes(box_data, input_shape, anchors, num_classes)

yield [image_data, *y_true], np.zeros(batch_size)

def data_generator_wrap(annotation_lines, batch_size, input_shape, anchors, num_classes):

n = len(annotation_lines)

if n==0 or batch_size<=0: return None

return data_generator(annotation_lines, batch_size, input_shape, anchors, num_classes)

if __name__ == '__main__':

config = tf.ConfigProto()

config.gpu_options.allow_growth = True # 不全部占满显存, 按需分配

sess = tf.Session(config=config)

KTF.set_session(sess)

_main()

需要更改的地方有:

① log_dir = ‘logs/000/’ 意味着模型权重保存在这里,因此需要在项目文件夹下创建

logs文件夹,它下面再创建000文件夹,否则你训练很长时间,模型没保存下载,没地方让你哭去

② input_shape = (416, 416)

这里一定要更改为自己图片的大小,建议可以在训练前将自己数据集的图片resize一下,减小尺寸,以加速训练(当然你的电脑足够强悍是可以不用管的,我的就是一开始用了1000多像素的图片,后来训练的时候提示资源耗尽),更改尺寸的代码很简单,赋予此,不想写的话可以拿:

from PIL import Image

import os

# 要更改大小的图片的位置

list = os.listdir('VOCdevkit\\VOC2012\\JPEGImages')

print(list)

for fname in list:

root = os.path.join('C:\\Users\\MJY\\PycharmProjects\\yolo_10.01\VOCdevkit\\VOC2012\\JPEGImages', fname)

pic = Image.open(root)

pic = pic.resize((416, 416))

# 在项目文件夹下新建了一个new文件夹,resize后的照片均保存于此

pic.save(os.path.join('new', fname))

③ 第37行 batch_size = 3

可以根据电脑性能和数据集大小调整

因为本来只是标了五十张图片,因此不需要大的batch

④ 第50行epochs=150,可以根据训练难易进行调整

⑤ 第117行开始的显存按需分配

这样就把训练代码修改完成了,这时候一定再次强调!!

因为程序中有logs/000/目录,你需要创建这样一个目录!!!!

六、进行训练

运行train.py,进入漫长的等待

最后发现损失在15-16左右

七、测试自己的图片

测试之前,修改yolo.py文件,需要更改的有:

① 从24行开始的

一定要与你的模型保存路径、照片大小相对应

class YOLO(object):

_defaults = {

"model_path": 'logs/000/trained_weights.h5',

"anchors_path": 'model_data/yolo_anchors.txt',

"classes_path": 'model_data/voc_classes.txt',

"score" : 0.3,

"iou" : 0.45,

"model_image_size" : (416, 416),

"gpu_num" : 1,

}

②

直接用所有的数据集进行测试(我知道这句话真的很业余很幼稚hhhh)

C:\Users\MJY\PycharmProjects\yolo_10.01\VOCdevkit\VOC2012\JPEGImages\*.jpg

import glob

def detect_img(yolo):

path = "C:\\Users\\MJY\\PycharmProjects\\yolo_10.01\\VOCdevkit\\VOC2012\\JPEGImages\\*.jpg"

outdir = "C:\\Users\\MJY\\PycharmProjects\\yolo_10.01\\VOCdevkit\\VOC2012\\SegmentationClass"

for jpgfile in glob.glob(path):

img = Image.open(jpgfile)

img = yolo.detect_image(img)

img.save(os.path.join(outdir, os.path.basename(jpgfile)))

yolo.close_session()

if __name__ == '__main__':

detect_img(YOLO())

C:\Users\MJY\PycharmProjects\yolo_10.01\VOCdevkit\VOC2012\SegmentationClass

中就会保存有你测试后的图片

检测成功;)

那个car是因为我把voc_classes文件中内容改成car进行训练了。。。。。。不要在意细节

然后输入一张大小并非416的照片,发现也是可以的

那么如何检测视频呢?

感谢这位博主https://blog.csdn.net/a88770202/article/details/87108823

我们需要改的地方为:

第192行开始,括号里的那些东西,是因为cv2和PIL的图片格式不同,因此需要转换

while True:

return_value, frame = vid.read()

image = Image.fromarray(cv2.cvtColor(frame, cv2.COLOR_BGR2RGB))

image = yolo.detect_image(image)

result = cv2.cvtColor(np.asarray(image), cv2.COLOR_RGB2BGR)

然后将210行开始的代码注释掉

# if isOutput:

# out.write(result)

然后在最末尾

if __name__ == '__main__':

detect_video(YOLO(), input("Input video filename:\n"))

然后运行,输入视频路径和文件名即可

(直接在pycharm中找到相应的视频,右键点击Copy Relative Path即复制下来)

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)