简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

作者:吴业亮博客:http://blog.csdn.net/wylfengyujiancheng防火墙报错Jun 19 09:17:03 node1 polkitd[70705]: Registered Authentication Agent for unix-process:90316:4708272 (system bus name :1.380 [/usr/bin/pkttyagen...

作者:【吴业亮】博客:https://wuyeliang.blog.csdn.net/1、节点规划192.168.8.11 node1admin(启动mon、osd、mgr)192.168.8.12 node2node2(启动mon、osd)192.168.8.13 node3node3(启动mon、osd)2、配置/etc/hosts(各个节点)192.1...

在传统数据并行训练中,每个GPU都保存完整的模型副本(包括参数、梯度和优化器状态),这导致显存使用存在大量冗余。而ZeRO通过将训练状态精细分区,使每个GPU仅保存部分数据,仅在需要时通过集合通信获取其他分区的数据,从而大幅降低单卡显存需求。,只需训练极少参数(通常不足原模型的1%),却能达到接近全参数微调的效果。梯度累积则通过多次小批量计算后再更新权重,模拟大批次训练效果,这对于显存有限的设备尤

作者:吴业亮博客:wuyeliang.blog.csdn.net测试工具本文性能测试使用的是 HammerDB 内置的 TPC-C 基准测试负载。TPC-C 是一种典型的 OLTP 工作负载,其模拟了拥有多个仓库的商品批发销售公司为大量客户发货商品的场景,其中仓库数的调整在测试中能够体现数据库所能够支持的数据规模能力。HammerDB 下载地址HammerDB 使用手册HammerDB 内置 TP

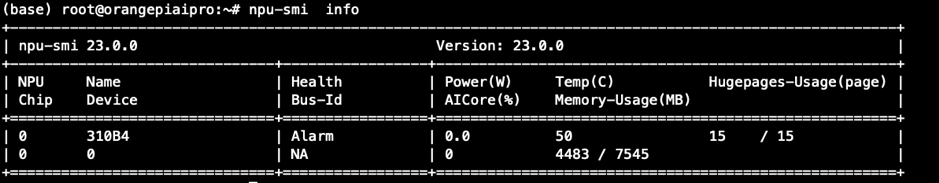

它允许家庭成员在云端存储、同步和分享照片、视频、文档等文件,方便快捷地访问和管理个人和家庭数据。通过Kodbox,用户可以轻松管理在线文档、实现在线办公等功能,确保数据的安全性和可访问性。其灵活性和定制性使其适用于各种规模和类型的组织,为其提供了高效的文档管理和团队协作的平台。香橙派一个,4核8G的那个配置。具体链接:http://www.orangepi.cn/html/hardWare/com

作者:【吴业亮】博客:https://wuyeliang.blog.csdn.net/源代码https://github.com/gluster/gluster-containers下载代码# git clone git@github.com:gluster/gluster-containers.git# git checkout branch分支切换目录cd glust...

作者:【吴业亮】博客:http://blog.csdn.net/wylfengyujiancheng几个常用场景下的安全控制一、限制用户在特定时间访问特定服务器的权限某公司通过sw4实现各部门之间的互连。公司要求禁止研发部门和市场部门在上班时间(8:00至17:30)访问工资查询服务器(IP地址为10.10.13.10/24),总裁办公室不受限制,可以随时访问。(一)、配置全网互通配置交换机

作者:【吴业亮】云计算开发工程师博客:http://blog.csdn.net/wylfengyujiancheng1、安装软件包[root@dlp ~]# yum -y install cockpit[root@dlp ~]# systemctl start cockpit[root@dlp ~]# systemctl enable cockpit.socket2、登录:

作者:【吴业亮】云计算开发工程师博客:http://blog.csdn.net/wylfengyujianchengLynis是针对Unix/Linux的安全检查工具,可以发现潜在的安全威胁。这个工具覆盖可疑文件监测、漏洞、恶意程序扫描、配置错误等。A.检查项举例:B.系统允许的登陆操作C.失效的SSL证书D.不需要密码的账户E.未授权的文件F.配置

作者:【吴业亮】博客:http://blog.csdn.net/wylfengyujiancheng网络需求:1、不同的外网企业用户访问虚拟机时,相互之间不能影响,业务必须隔离。同时,每个虚拟机业务可使用的带宽资源也要限制在一定范围内,避免占用大量资源。2、内部网络中的虚拟机和Portal系统都配置私网地址,要求对外发布两者的公网地址,使外网企业用户能够通过公网地址访问虚拟机和Portal系统。3