简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Qwen-VL系列模型在多模态领域持续创新,其演进路径涵盖视觉编码器优化、位置编码统一、训练范式改进等关键技术。Qwen2-VL引入M-RoPE统一处理文本/图像/视频位置编码,采用三阶段训练(预训练+多任务+指令微调)。Qwen2.5-VL通过绝对坐标提升检测精度,动态FPS采样增强视频理解,并融合SFT与DPO优化。Qwen3-VL进一步创新,提出MRoPE-Interleave和DeepSt

近期AI领域迎来多项重要更新:百度发布文心5.1大模型,参数效率显著提升;HiDream开源8B图像生成模型HiDream-O1-Image;Thinking Machines推出实时交互模型TML-Interaction-Small;OpenBMB开源端侧多模态模型MiniCPM-V 4.6。此外,Claude Opus 4.7快速模式上线API,Jina AI发布四模态嵌入模型,Percept

近期AI领域迎来多项重要更新:百度发布文心5.1大模型,参数效率显著提升;HiDream开源8B图像生成模型HiDream-O1-Image;Thinking Machines推出实时交互模型TML-Interaction-Small;OpenBMB开源端侧多模态模型MiniCPM-V 4.6。此外,Claude Opus 4.7快速模式上线API,Jina AI发布四模态嵌入模型,Percept

2026年AI领域迎来重大技术突破,多家科技公司发布创新模型与产品。Cursor推出高效编程模型Composer 2.5,并与SpaceXAI合作训练超大新模型;字节跳动开源统一多模态模型Lance;Odyssey发布实时音视频模型Starchild-1和多智能体交互模型Agora-1。NVIDIA开源三模式解码生成模型系列,阿里千问推出旗舰模型Qwen3.7-Max和实时翻译模型Qwen3.5-

2026年AI领域迎来重大技术突破,多家科技公司发布创新模型与产品。Cursor推出高效编程模型Composer 2.5,并与SpaceXAI合作训练超大新模型;字节跳动开源统一多模态模型Lance;Odyssey发布实时音视频模型Starchild-1和多智能体交互模型Agora-1。NVIDIA开源三模式解码生成模型系列,阿里千问推出旗舰模型Qwen3.7-Max和实时翻译模型Qwen3.5-

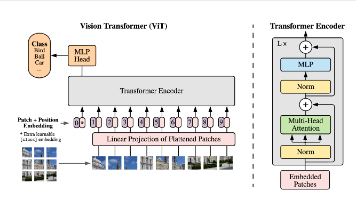

ViT论文摘要: 本文提出Vision Transformer(ViT),首次将纯Transformer架构成功应用于大规模图像识别任务。传统CNN依赖局部卷积操作,难以建模图像全局依赖关系且计算效率受限。ViT创新性地将图像分割为16×16的块(Patch),线性映射为序列化Token后输入标准Transformer编码器。通过引入可学习的[CLS] Token和位置编码,ViT在ImageNe

近期AI领域迎来密集创新,多家科技公司发布最新研究成果。阿里推出编程强化学习模型Qwen-Coder-Qoder,显著提升代码留存率;Kimi与南大合作发布SimpleSeg图像分割技术;阶跃星辰开源高性能Step 3.5 Flash模型,支持复杂Agent任务;智谱发布轻量级OCR模型GLM-OCR,在文档识别领域表现优异。xAI推出Grok Imagine 1.0视频生成模型,字节跳动发布Co

本文梳理了2026年十大核心LLM训练数据集,涵盖网络语料、知识库、指令集等类型。重点数据集包括:Common Crawl(多PB级原始网络数据)、C4(750GB清洗英文语料)、RedPajama(1000亿词元复现LLaMA数据)、RefinedWeb(6000亿词元高质量网络文本)和The Pile(825GB多样化综合语料)。这些数据集支持从基础预训练到指令微调的全流程,多数采用开源许可,

2026年小型LLM训练项目指南精选了14个适合不同学习阶段的模型,从入门级的26M参数MiniMind(仅需3元成本)到实用的1B级别模型。推荐学习路径:先通过nanoGPT理解基础架构,再用MiniMind体验全流程训练,最后进阶到TinyLlama等更大模型。特别推荐中文专用方案如baby-llama2-chinese,并提供了项目对比表帮助选择。这些小型LLM训练成本低、速度快,是掌握大模

Qwen-VL系列模型在多模态领域持续创新,其演进路径涵盖视觉编码器优化、位置编码统一、训练范式改进等关键技术。Qwen2-VL引入M-RoPE统一处理文本/图像/视频位置编码,采用三阶段训练(预训练+多任务+指令微调)。Qwen2.5-VL通过绝对坐标提升检测精度,动态FPS采样增强视频理解,并融合SFT与DPO优化。Qwen3-VL进一步创新,提出MRoPE-Interleave和DeepSt