简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

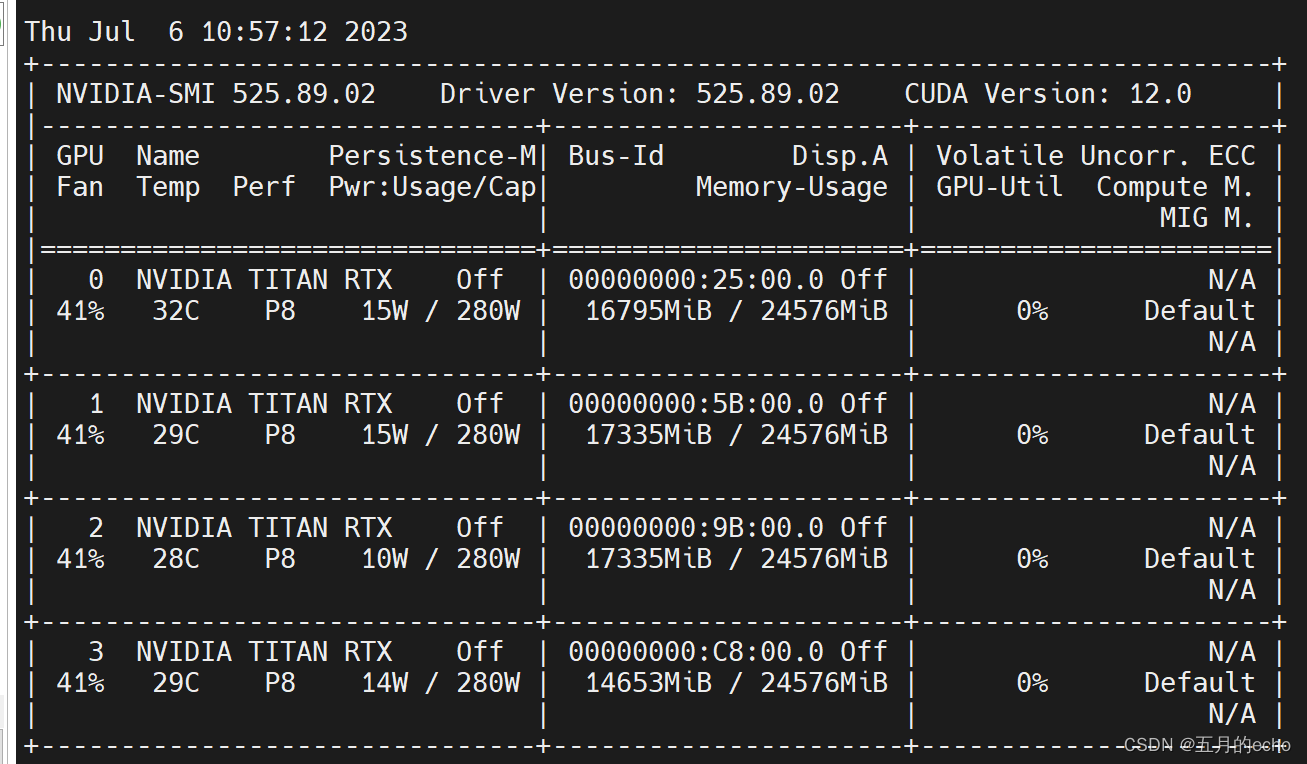

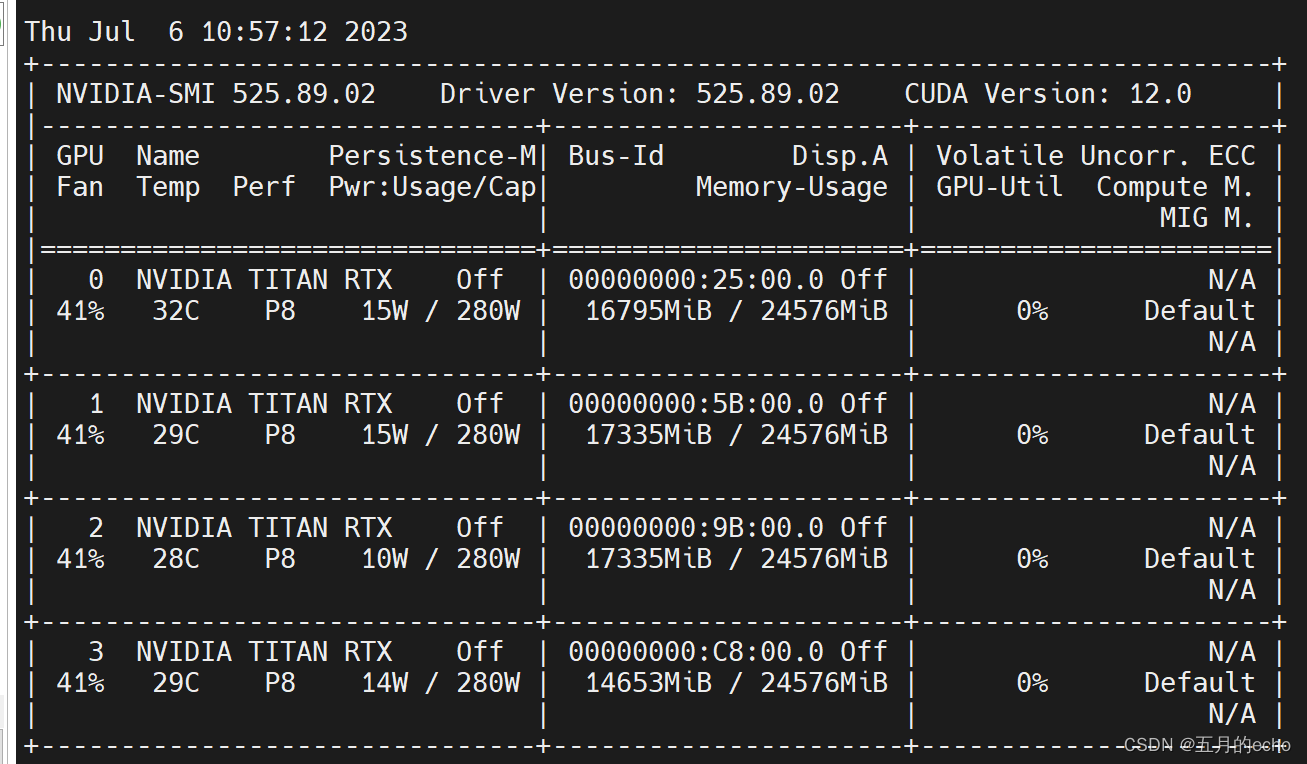

是不是苦于没有ChatGPT的API key或者免费的token而无法愉快地和它玩耍?想不想在有限的计算资源上部署大模型并调戏大模型??想不想解锁大模型的除了对话之外的其它功能???几行代码教你搞定如何在有限的计算资源下部署超大模型并实现推理。

目录1. Model2. Encoder2.1 Position encoding2.2 Multi-Head AttentionAdd&NormFeed forwardDecoder参考1. Model在此之前,假定你已经了解了:RNN(LSTM),Sequence2Sequence模型以及注意力机制。Transformer通过大量使用Attention代替了Seq2seq中的RNN结构

文章目录1. A Unified Generative Framework for Various NER SubtasksMethod1. A Unified Generative Framework for Various NER Subtasks第一篇来看看复旦大学邱锡鹏老师团队做的能够解决多种NER任务的统一框架。熟悉NER的小伙伴都知道,Flat NER可以转化为序列标注的任务,但是一些

最近有需要在新的领域进一步训练BERT,因此参照了hugging face官方文档写了相应的代码。本文采用的是hugging face提供的checkpoint,并在相应的task special领域进行了微调。由于项目的保密协议代码数据不便全部公开,下面只给出关键的部分。BERT MLM重新训练BERT主要是在自己的数据集上实现Masked Language Model的预测任务。我忘记了在哪篇

是不是苦于没有ChatGPT的API key或者免费的token而无法愉快地和它玩耍?想不想在有限的计算资源上部署大模型并调戏大模型??想不想解锁大模型的除了对话之外的其它功能???几行代码教你搞定如何在有限的计算资源下部署超大模型并实现推理。

最近有需要在新的领域进一步训练BERT,因此参照了hugging face官方文档写了相应的代码。本文采用的是hugging face提供的checkpoint,并在相应的task special领域进行了微调。由于项目的保密协议代码数据不便全部公开,下面只给出关键的部分。BERT MLM重新训练BERT主要是在自己的数据集上实现Masked Language Model的预测任务。我忘记了在哪篇

目录1. Model2. Encoder2.1 Position encoding2.2 Multi-Head AttentionAdd&NormFeed forwardDecoder参考1. Model在此之前,假定你已经了解了:RNN(LSTM),Sequence2Sequence模型以及注意力机制。Transformer通过大量使用Attention代替了Seq2seq中的RNN结构

最近有需要在新的领域进一步训练BERT,因此参照了hugging face官方文档写了相应的代码。本文采用的是hugging face提供的checkpoint,并在相应的task special领域进行了微调。由于项目的保密协议代码数据不便全部公开,下面只给出关键的部分。BERT MLM重新训练BERT主要是在自己的数据集上实现Masked Language Model的预测任务。我忘记了在哪篇