AI智能棋盘集成Allwinner V851S支持视频流编码

Allwinner V851S芯片在AI智能棋盘中实现高效视频编码与边缘AI推理,支持H.265硬件编码和轻量级神经网络,兼顾低功耗、低成本与高性能,适用于长期运行的视觉类AIoT设备。

AI智能棋盘如何借力Allwinner V851S实现高效视频编码与边缘AI

在围棋教室里,一位老师正通过手机远程指导学生落子。画面上,棋盘的每一个细微动作都被清晰捕捉,黑白棋子的更替实时同步,延迟几乎难以察觉。而在设备背后,一块指甲盖大小的芯片正默默完成图像采集、AI识别和高清推流——这正是基于 Allwinner V851S 的AI智能棋盘所展现的能力。

这类设备早已不再是简单的摄像头+传输模块组合。它需要在低功耗、低成本的前提下,同时处理高质量视频编码与本地AI推理任务。而V851S恰好填补了这一技术空白:它不是性能怪兽,却能在“够用”与“省电”之间找到绝佳平衡点,尤其适合像智能棋盘这样长期运行、视觉感知密集但算力需求不过分极端的应用场景。

为什么是V851S?从实际工程痛点说起

传统方案中,许多厂商尝试用通用嵌入式平台(如树莓派)搭建智能棋盘原型。虽然开发便捷,但很快暴露出问题:软件编码H.264时CPU占用高达70%以上,发热严重,且无法稳定支持长时间推流;若将AI识别也放在同一主控上运行,系统极易卡顿。

于是设计者开始寻找具备硬件视频编码能力、并能加速轻量级神经网络的SoC。这时,全志科技推出的 V851S 进入视野。这款面向AIoT视觉应用的处理器,集成了四核Cortex-A7、专用NPU、ISP以及H.264/H.265编码引擎,在典型工作状态下功耗低于2W,成为消费级AI视觉产品中的高性价比选择。

更重要的是,它的外设接口足够丰富——MIPI CSI-2接摄像头,SDIO连Wi-Fi模块,USB扩展存储或调试端口,再加上对Linux系统的良好支持,使得整个系统可以在单一芯片上完成从图像输入到网络输出的全流程处理。

视频编码:不只是“压缩”,而是体验的核心保障

对于远程对弈或直播教学来说, 低延迟、低带宽、高稳定性 是三大硬指标。如果码率过高,在4G网络下容易卡顿;若采用软件编码,不仅耗电还影响AI识别响应速度。

V851S内置的VEPU(Video Engine Processing Unit)支持最高1080p@30fps的H.265编码,相比传统的H.264,在相同画质下可节省约40%带宽。这意味着原本需要4Mbps才能流畅传输的画面,现在只需2.4Mbps即可实现,显著提升了窄带环境下的可用性。

实际部署中,我们可以通过FFmpeg直接调用其硬件编码模块:

ffmpeg -f v4l2 -video_size 1920x1080 -input_format yuyv422 -i /dev/video0 \

-c:v h265_v4l2m2m -b:v 2M -preset ultrafast \

-f flv rtmp://live.example.com/app/stream_key

这里的 h265_v4l2m2m 是关键——它利用了Linux内核中的V4L2 Memory-to-Memory编码驱动,真正意义上启用了硬件加速。实测表明,在输出2Mbps码率的H.265流时,CPU平均占用率仅12%左右,远低于纯软编的60%以上。

而对于需要更精细控制的场景,比如动态调整码率以适应网络波动,GStreamer提供了更大的灵活性:

gst-launch-1.0 v4l2src device=/dev/video0 ! \

videoconvert ! \

v4l2h265enc control-rate=1 bitrate=2048 ! \

h265parse ! \

flvmux ! \

rtmpsink location='rtmp://live.example.com/app/stream_key'

其中 control-rate=1 启用CBR(恒定码率)模式,确保推流过程平稳;结合Python脚本或gstd服务,还能实现按运动检测结果自动提升局部区域码率,进一步优化资源分配。

边缘AI:让棋盘“看懂”局势,而非仅仅“看到”

光有清晰画面还不够。真正的“智能”体现在能否自动识别当前棋局状态,并为用户提供分析建议。这就涉及到一个典型的边缘AI任务:在有限算力下完成实时目标分类。

V851S配备了一个独立的NPU协处理器,主频200MHz,支持INT8量化模型,理论算力达0.5TOPS。虽然无法运行大型Transformer结构,但对于MobileNetV2、Tiny-YOLOv3这类轻量CNN模型已绰绰有余。

具体到棋子识别流程,通常包括以下几个步骤:

- 摄像头固定于棋盘正上方,拍摄全局图像;

- 利用霍夫变换或模板匹配建立棋盘点坐标网格;

- 对每个交叉点裁剪出ROI区域(如64×64像素);

- 输入预训练的三分类模型判断该位置为空、黑子或白子;

- 将识别结果封装后通过WebSocket或MQTT同步至App端。

模型方面推荐使用TensorFlow Lite格式,经量化压缩后体积可控制在3MB以内,完全适配NPU内存限制。以下是一段典型的推理代码片段(C++):

#include "tensorflow/lite/c/c_api.h"

TfLiteModel* model = TfLiteModelCreate(model_data, model_size);

TfLiteInterpreterOptions* options = TfLiteInterpreterOptionsCreate();

TfLiteInterpreter* interpreter = TfLiteInterpreterCreate(model, options);

TfLiteTensor* input = TfLiteInterpreterGetInputTensor(interpreter, 0);

memcpy(input->data.f, processed_image, 64 * 64 * 3 * sizeof(float));

TfLiteInterpreterInvoke(interpreter);

TfLiteTensor* output = TfLiteInterpreterGetOutputTensor(interpreter, 0);

float* scores = output->data.f;

int pred_class = std::max_element(scores, scores + 3) - scores;

在V851S上实测,单帧推理时间约为60ms,配合抽帧策略(每秒处理5~10帧),整体延迟控制在200ms以内,满足绝大多数交互需求。更重要的是,由于识别在本地完成,避免了上传原始图像带来的隐私风险和云端通信延迟。

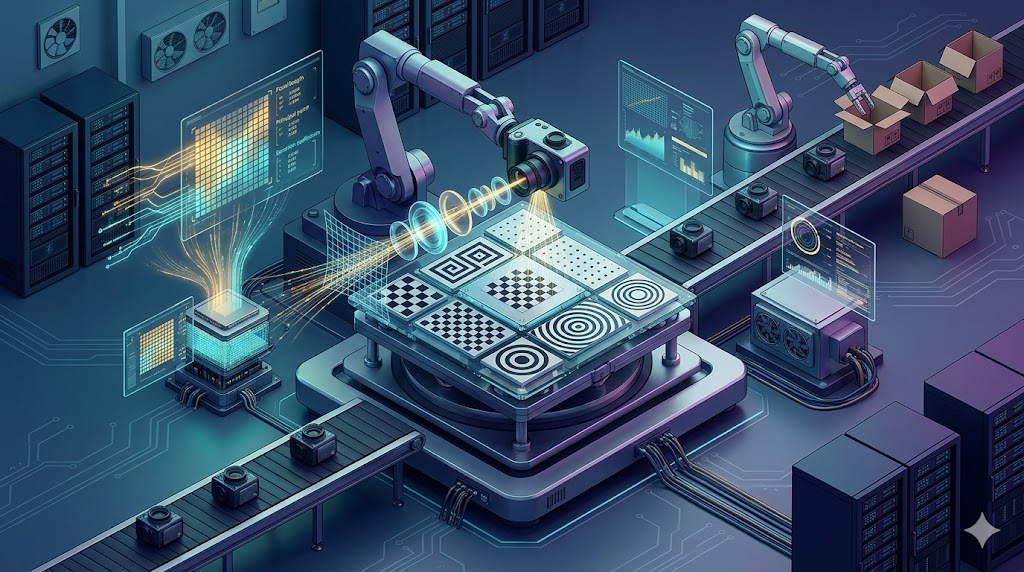

系统整合:如何让各个模块协同工作?

一个完整的AI智能棋盘系统,本质上是一个多任务并行的嵌入式架构:

[摄像头模组] → MIPI CSI-2 → [Allwinner V851S]

├─ ISP → 图像增强

├─ VEPU → H.265编码 → RTMP/WebRTC推流

├─ NPU → 棋子识别模型推理

├─ CPU → 控制逻辑、协议处理

└─ SDIO → 外接Wi-Fi模块联网

外围组件通常包括:

- OV5640或GC2053摄像头(500万像素,支持自动对焦)

- RTL8723BS Wi-Fi/BT二合一模块(用于无线连接与蓝牙遥控)

- TF卡槽(支持本地录像回放)

- GPIO接口(可接入磁性感应棋盘作为辅助输入)

启动后,系统加载嵌入式Linux(如Buildroot或Yocto定制镜像),初始化各驱动模块。摄像头持续输出YUV帧,一路送入硬件编码器生成直播流,另一路按需抽帧送至AI管道进行状态识别。

值得注意的是,ISP模块的作用常被低估。它提供的3A算法(自动曝光、自动白平衡、自动对焦)以及3D降噪功能,能有效应对教室环境中光照变化频繁的问题,减少误识别率。例如当侧窗阳光直射时,WDR(宽动态范围)技术可防止局部过曝导致棋子轮廓丢失。

工程细节决定成败:那些容易踩坑的地方

即便有了强大的SoC,实际开发中仍有不少“暗礁”。

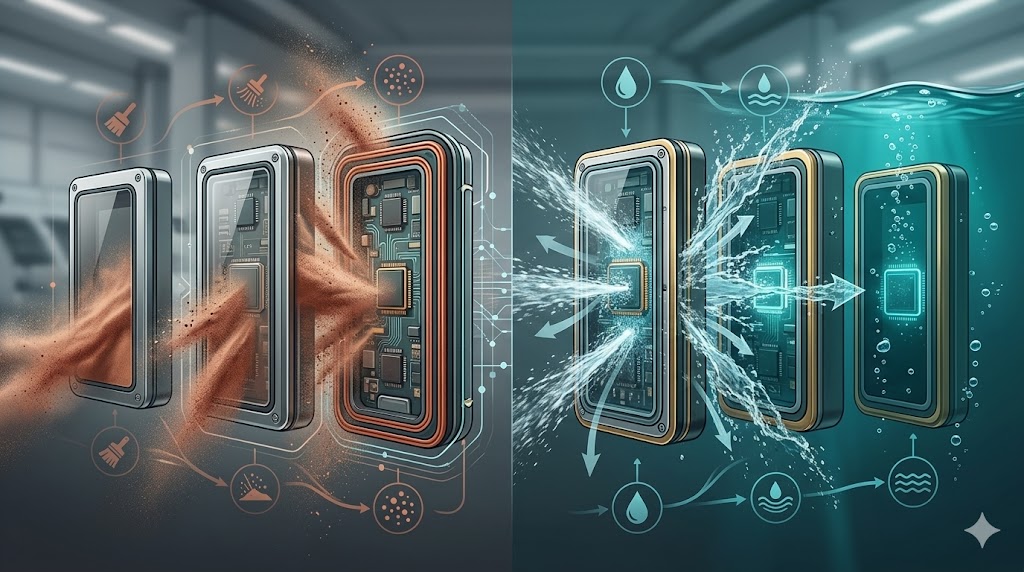

首先是散热问题。尽管V851S标称功耗小于2W,但在持续编码+AI推理负载下,裸板温度可能超过70°C,触发内部节流机制。建议至少加装小型铝制散热片,必要时可在外壳设计通风孔。

其次是电源设计。强烈推荐使用DC-DC降压方案(如SY8009),输入5V/2A供电,避免LDO线性稳压带来的效率损失和热量堆积。

安全方面也不容忽视。可通过启用Secure Boot防止非法刷机,保护设备固件完整性;AI模型权重文件建议加密存储,防止逆向提取。OTA升级路径应预留eMMC或SPI NAND接口,便于后期功能迭代。

最后是隐私合规。虽然本地处理降低了数据泄露风险,但仍建议默认开启RTMPS/TLS加密传输,不在设备端长期保存原始视频片段,符合GDPR等数据保护规范。

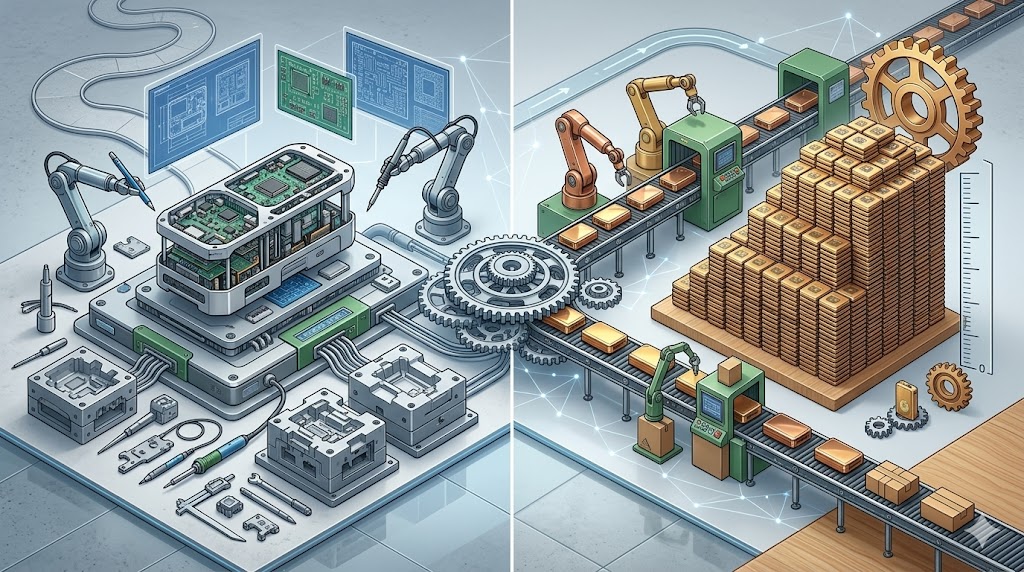

性价比背后的权衡:它适合谁?不适合谁?

毫无疑问,V851S的优势在于 集成度高、成本可控、生态成熟 。相比Rockchip RK3566等竞品,其BOM成本更低,特别适合单价敏感的消费类产品。

但它也有明确边界。比如不支持4K编码,难以胜任多摄像头拼接录制;NPU仅支持特定算子,复杂模型需大量裁剪与量化;DDR最大支持1GB LPDDR3,限制了更大缓存或后台服务的运行。

因此,它最适合的是:

- 单目视觉为主的AI设备(如智能棋盘、门铃、玩具机器人)

- 需要长期待机、低功耗运行的场景

- 开发周期紧、依赖开源工具链的产品原型

而不适用于:

- 多路高清视频分析系统

- 要求运行BERT类大模型的高级AI应用

- 实时性要求极高(<50ms端到端延迟)的专业级设备

结语:小芯片推动大变革

Allwinner V851S或许不会出现在旗舰手机或服务器机房里,但它正在悄悄改变我们身边那些“不起眼”的设备。在一个小小的AI棋盘中,它实现了高清视频压缩与边缘智能识别的融合,让传统文化器具焕发数字生命力。

这种高度集成的设计思路,正引领着智能硬件向更可靠、更高效的方向演进。未来随着V851系列后续型号的推出——比如支持更高分辨率编码或更强NPU算力的版本——我们甚至可以期待更多创新应用:多视角自动剪辑、手势落子交互、三维棋局重建……一切才刚刚开始。

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)